又一款国产开源模型出圈了。

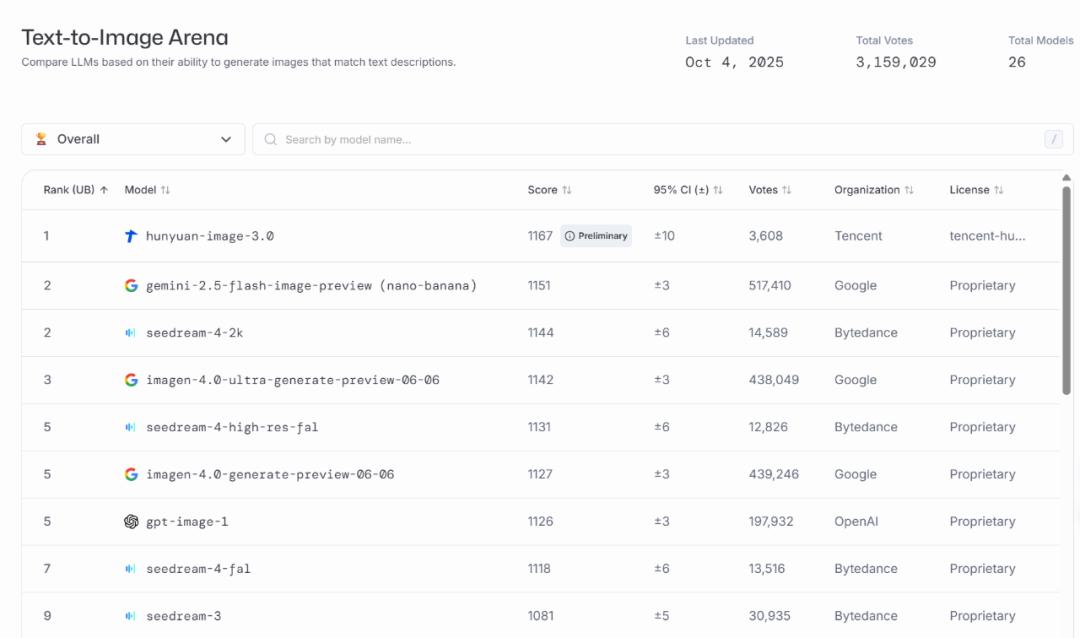

2025年10月4日,国际权威AI模型评测机构LMArena公布一份最新的文生图模型榜单,在这份榜单中,腾讯混元图像3.0模型以1167的总分(盲测总分)击败谷歌Nano-Banana,拿下全球文生图模型领域的“王座”。

值得一提的是,这份榜单的前10大模型分别来自腾讯、谷歌、字节跳动、OpenAI、阿里巴巴和BLACK FOREST。其中中国厂商占据6席,字节跳动一家公司就占据其中的4席,这十分令人吃惊。

混元图像3.0(HunyuanImage 3.0)是首个工业级原生多模态生图模型,它的参数规模为80B,激活参数为13B,它是目前测评效果最好、参数量最大的开源生图模型,效果可对标业界头部闭源模型。

混元图像3.0模型在2025年9月28日正式开源,是全球首个开源商用级原生多模态生图模型。混元图像3.0的语义理解能力和美学质感得到大幅提升,可以实现对用户指令的精确生成,包括图片中的小字和长文本生成都能较好地实现。

在实际例子上,混元图像3.0模型能够准确地把左侧博主的穿搭分解成右侧单独的衣物。

如果你也想体验混元图像3.0模型,可以直接在混元官网体验。体验网址:

https://hunyuan.tencent.com/image/