1月28日,宸境科技在浙江杭州正式发布具身智能新品牌“LooperRobotics”及全栈技术产品矩阵。

此次发布涵盖了Insight全自主空间智能相机、TinyNav高性能导航算法库,及RoboSpatial空间编辑工具链,标志着具身智能关键感知硬件、底层算法及应用工具链领域取得重要突破,为推动机器人成为继汽车、手机之后的物理任务基础设施提供了坚实支撑。

面向复杂物理世界,定义机器人“空间智能”基座

当前,人工智能正加速从数字世界向物理世界迈进,具身智能作为物理AI的典型代表,是连接数字与物理实体的桥梁,也是赋能制造业转型升级的关键抓手。然而,如何让机器人在复杂多变的真实物理环境中具备高精度的感知与决策能力,实现从实验室到车间、家庭的规模化落地,仍是行业面临的共性挑战。

此次宸境科技发布的“LooperRobotics”品牌体系,旨在通过软硬件一体化的自主创新,打造驱动通用机器人的标准化感知底座。

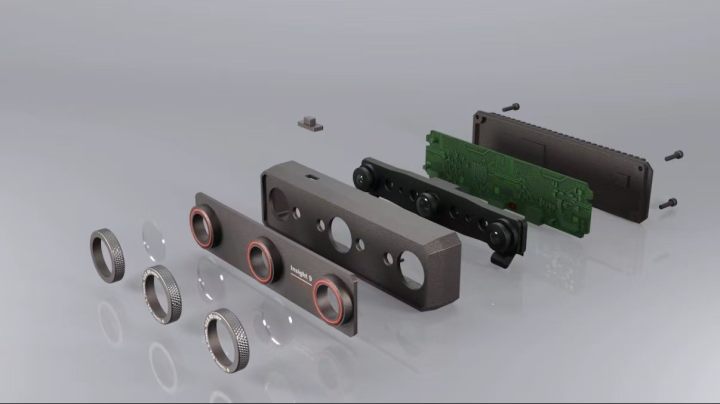

发布会上推出的Insight全自主空间智能相机,是本次发布的一大亮点。

作为具身智能的核心数据入口,Insight全自主空间智能相机凭借四大维度的技术跨越,重塑了行业的感知边界:

一是端侧算力内闭环:内置10TOPSNPU算力,在相机端即实现SLAM算法与AI双目测距协同,保障感知源头的数据处理效率。

二是全域纵向视场:采用188°超广角镜头与纵向增强布局,消除感知盲区,实现信息的全景覆盖。

三是毫秒级实时响应:依托边缘计算架构,AI推理实现毫秒级运行,赋予机器人类生物本能的快速避障反应。

四是工业级环境鲁棒:具备24g抗震能力与强光抑制,确保机器人在颠簸、复杂光照等极端工况下的位姿输出精度。

这种高性能、低功耗的集成方案,为具身智能提供了标准化的感知源头。

作为LooperRobotics的“导航灵魂”,TinyNav高性能导航算法库提供了一套开箱即用的机器人导航系统。TinyNav可直接输出控制信号,赋予各类构型机器人平台“即插即用”的智能移动能力。

在功能层面,TinyNav赋予机器人稳健的局部感知与自主定位能力,支持未知环境下的安全探索、实时建图及长时记忆管理,确保机器人在无监督条件下连续稳定运行。其技术核心在于一套面向机器人训练的生成式世界模型(GenerativeWorldModel),凭借少量真实场景数据即可生成无限量高保真合成数据,从根本上提升了机器人决策系统的泛化能力与鲁棒性。

RoboSpatial空间感知软件平台具备极强的软硬件兼容性,通过模块化设计打造开箱即用的软硬一体化方案,让机器人厂家能够跳过复杂的底层开发环节,实现核心能力的快速赋能。这一创新不仅从根本上解决了传统机器人开发门槛高、周期长、适配难的行业难题,更通过构建机器人专属的“空间知识库”,实现对环境信息的结构化存储与智能调用。

“空间即服务”创新模式,展现广泛应用潜力

宸境科技联合创始人兼CEO胡闻表示,在物理AI框架下,智能体需要具备对物理世界极高维度的重构能力。宸境科技正是围绕这一需求,构建了以Insight相机为感知入口、RoboSpatial平台为时空基座、TinyNav引擎为认知核心的技术闭环,提出了空间即服务(SpatialAIasService)的全新理念。这一矩阵通过软硬耦合,将碎片化的物理信号转化为结构化的空间智能,赋予机器人理解物理逻辑的“空间直觉”。

如果说汽车是移动基础设施,手机是信息基础设施,那么机器人有望成为未来的“物理任务基础设施”。宸境科技软硬一体的“空间直觉”方案与“空间即服务”的创新模式,将为产业链上下游提供标准化的基础设施支撑。

发布会现场,宸境科技展示了与宇树科技、地瓜机器人等行业头部企业的深度合作成果。人形机器人与四足机器人在搭载全栈空间智能方案后,展现了卓越的自主导航与交互能力,验证了该技术在工业巡检、物流配送及公共服务领域的广泛应用潜力。

此次全栈解决方案的发布,不仅填补了相关领域的技术空白,更体现了我国科技企业在促进产业链协同创新方面的积极作为。

宸境科技此次推出的矩阵产品,破解了“看得见、走得通、用得好”三大核心痛点,有望推动具身智能加速融入实体经济,成为推动经济社会数字化、智能化转型的重要力量。