所以来读一篇综述:《Stop Overthinking: A Survey on Efficient Reasoning for LLMs》,本文的重点就是如何 高效推理:如何在保持推理能力的同时,尽量压缩推理链,让模型既能想清楚,又不浪费资源。

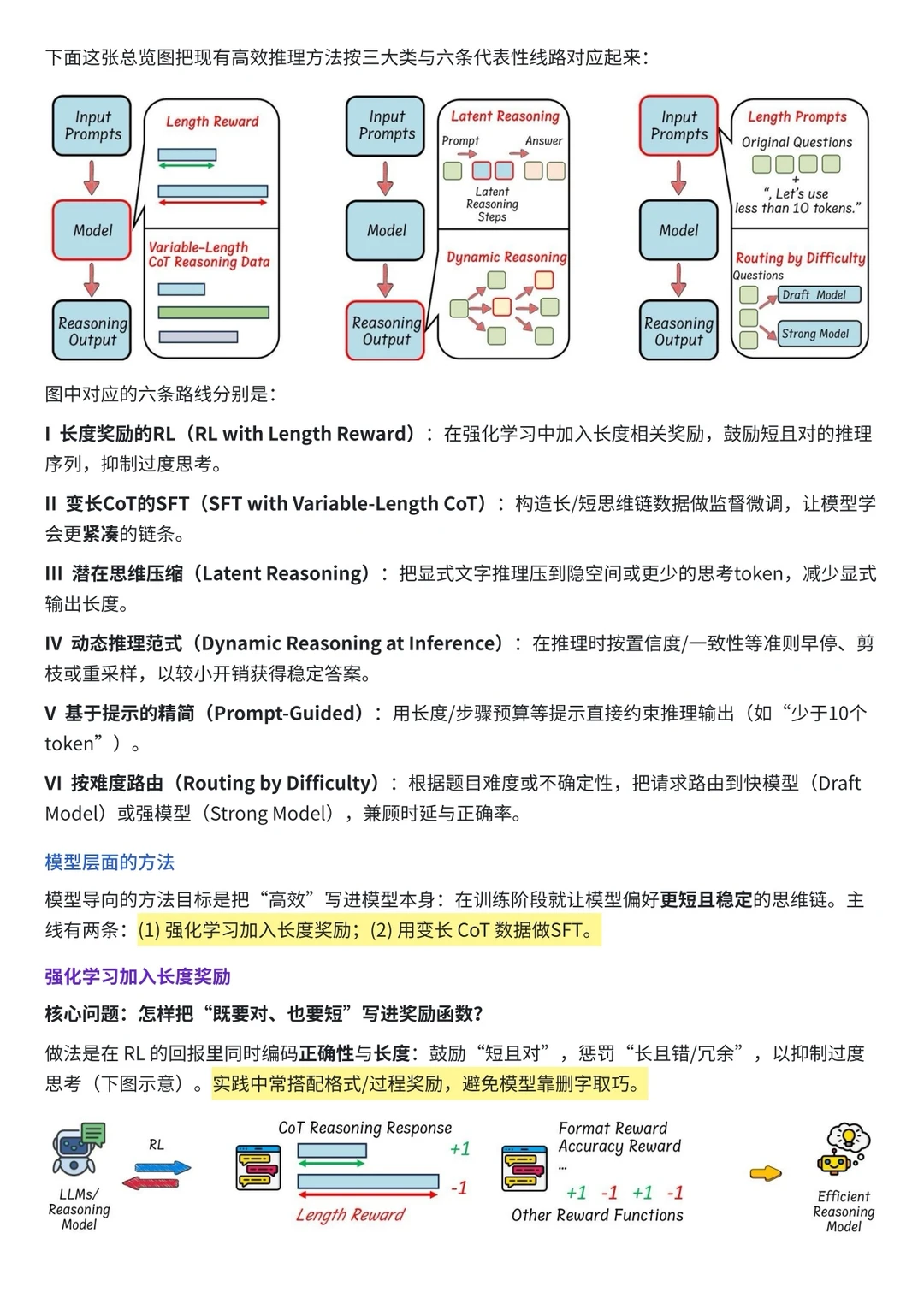

论文把现有方法分成三个角度来总结:

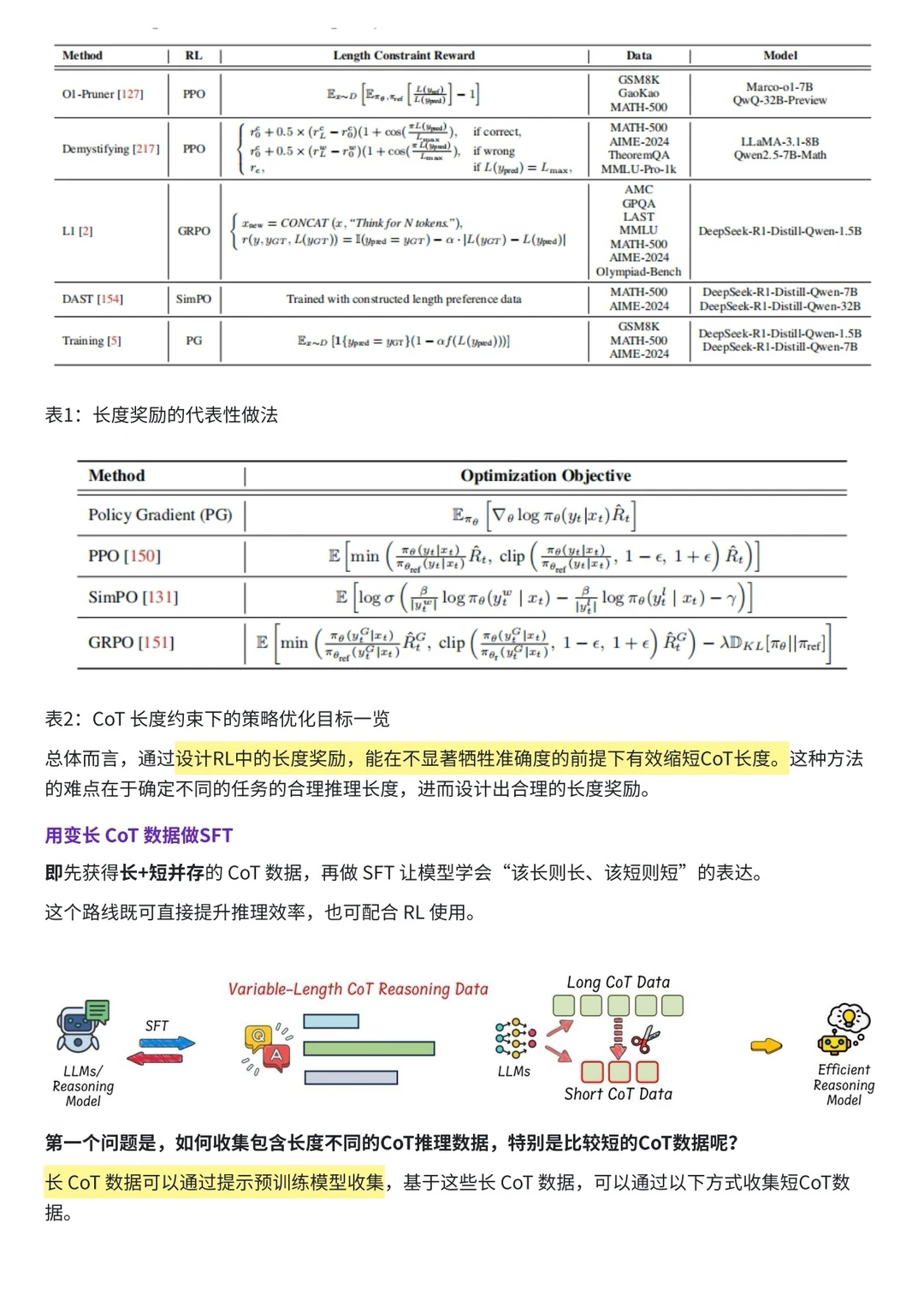

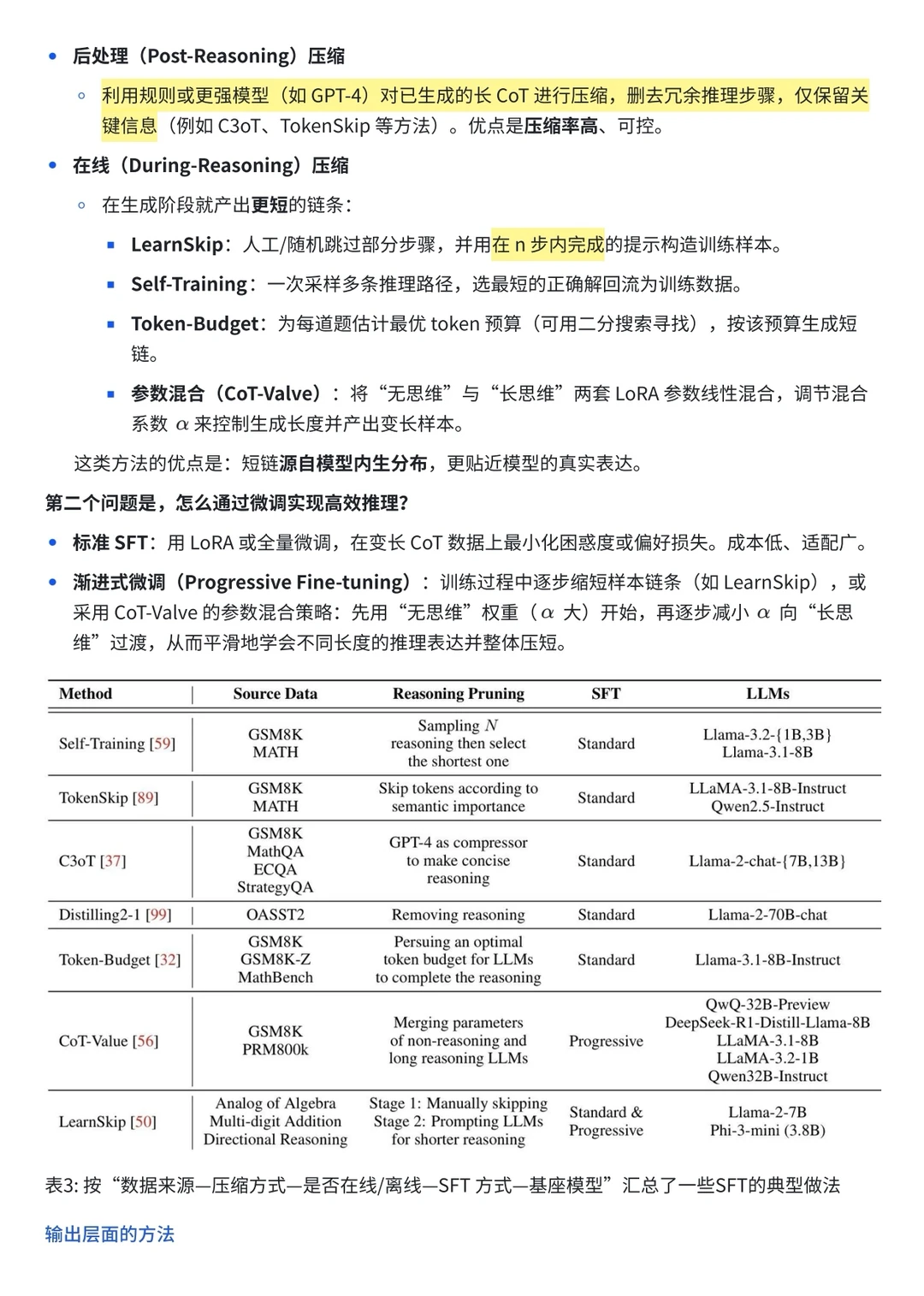

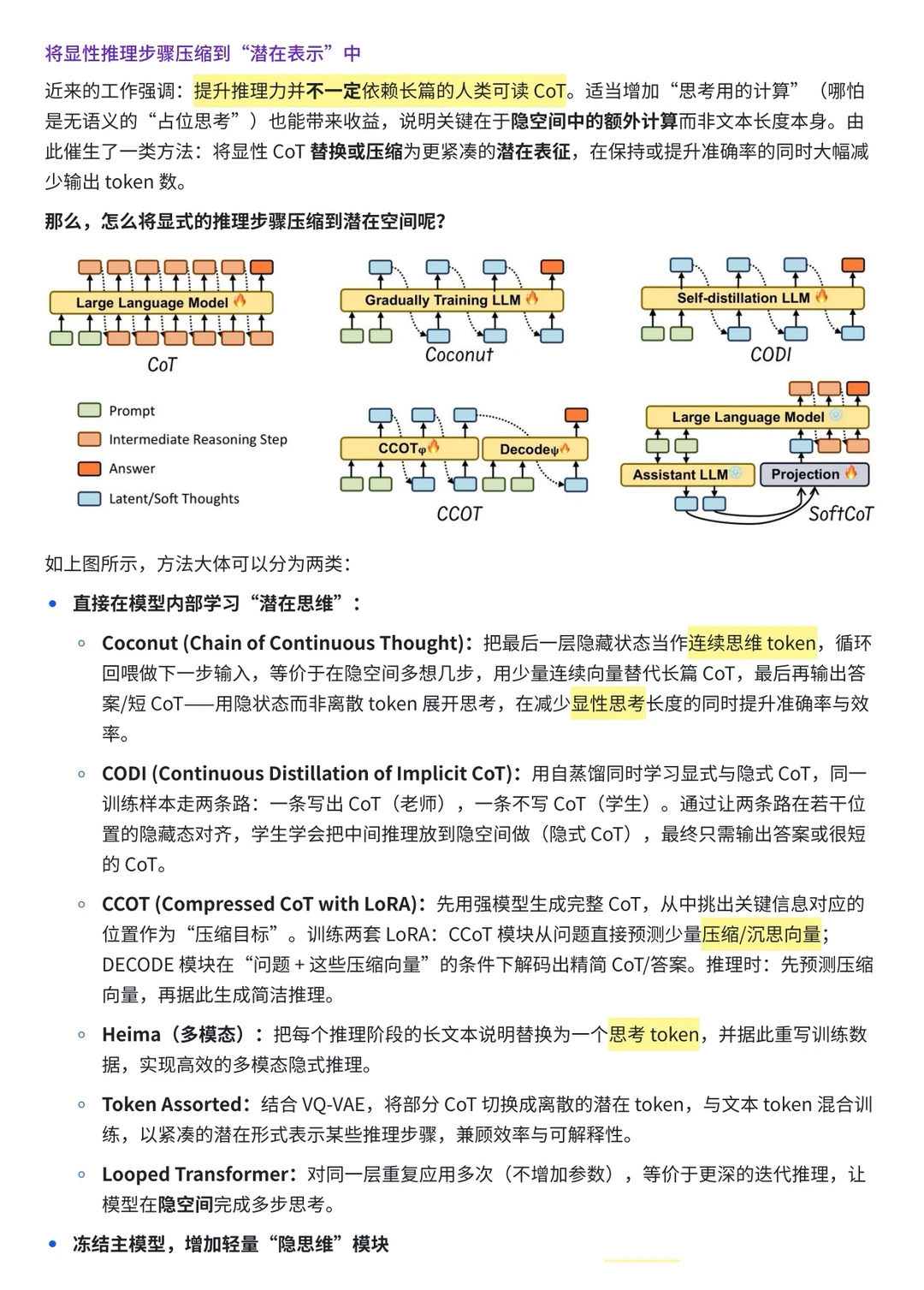

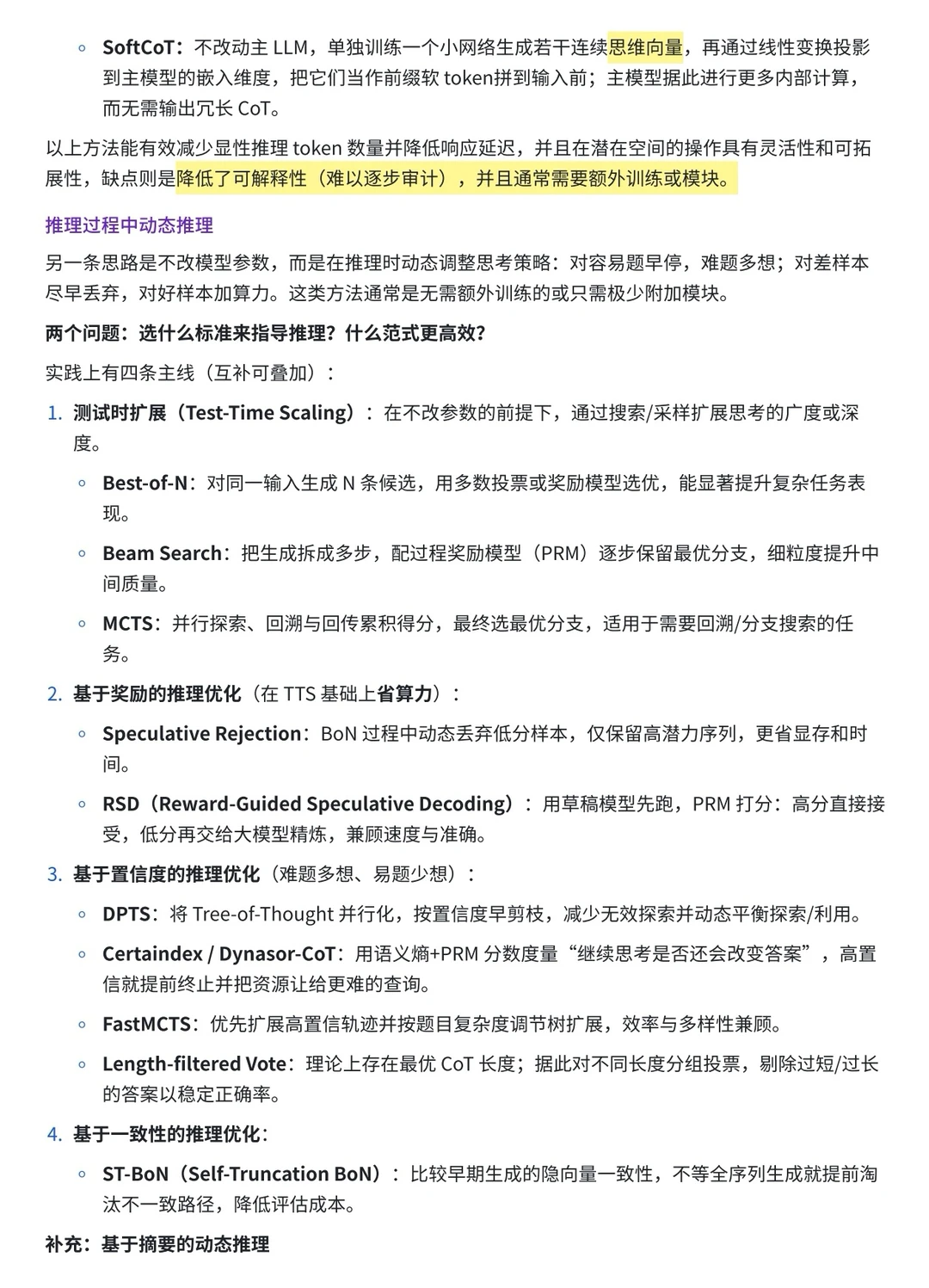

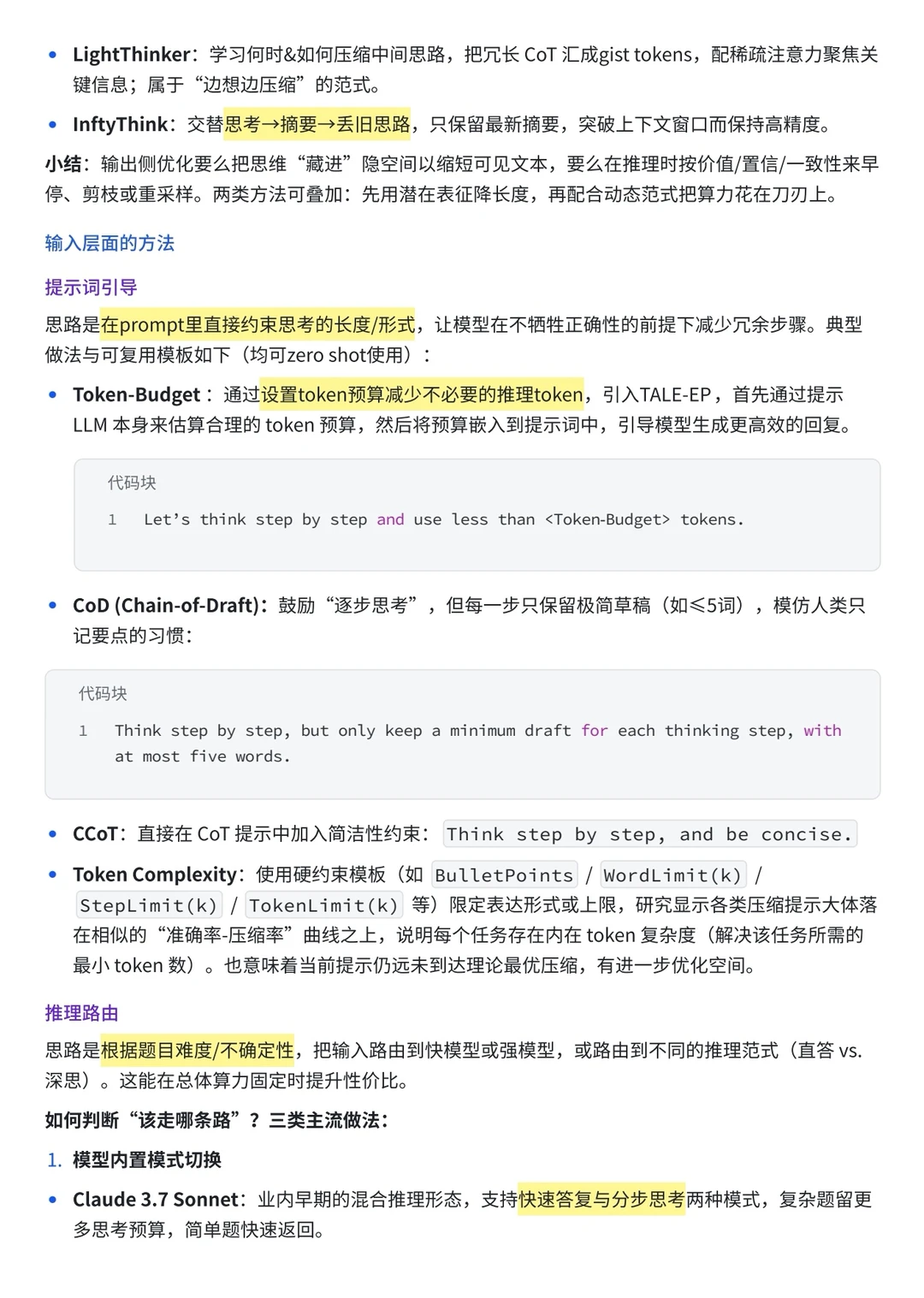

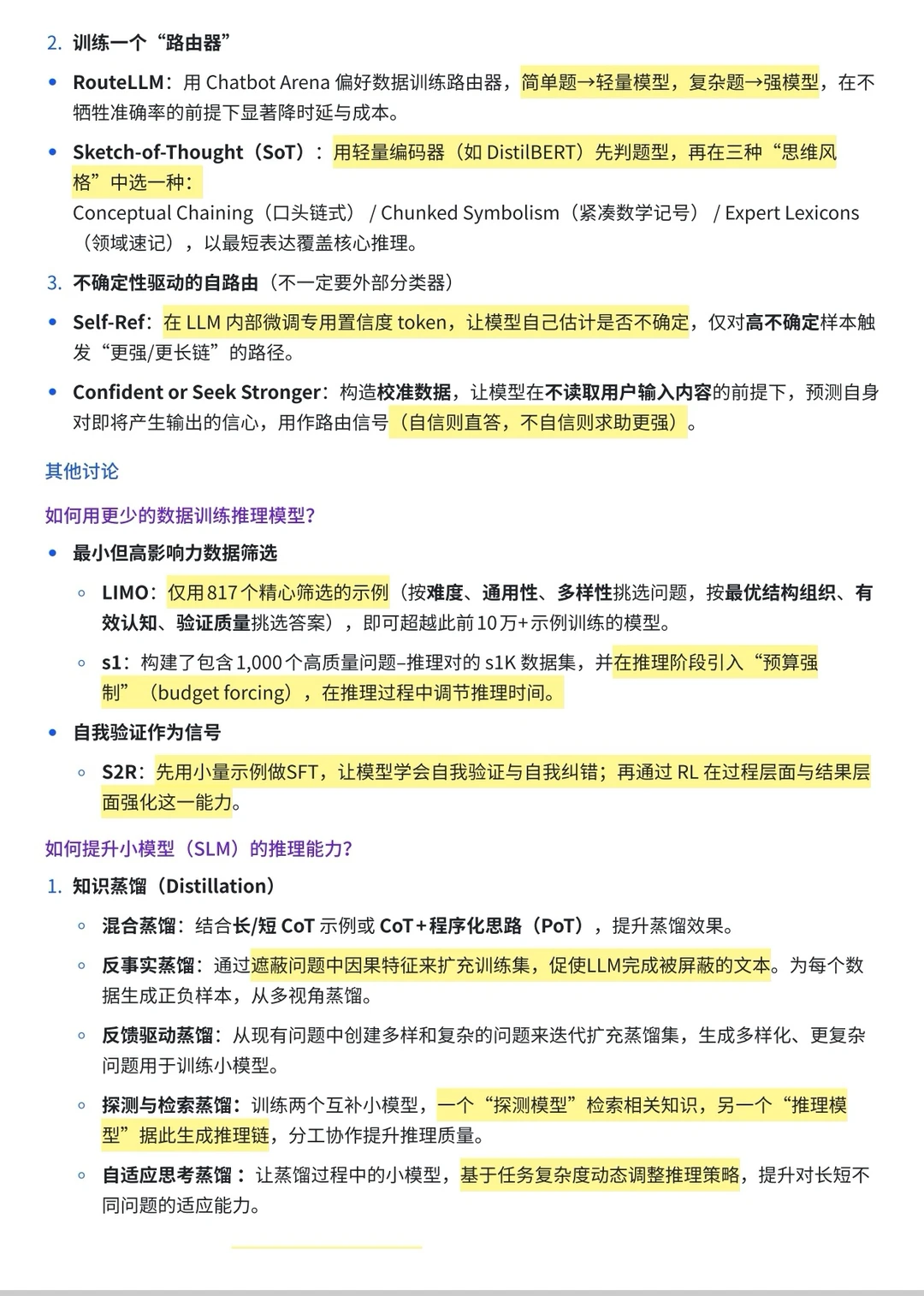

1️⃣模型训练层面:直接训练或压缩出更简洁的推理模型;

2️⃣推理结果层面:在推理过程中动态裁剪冗余步骤;

3️⃣输入 prompt 层面:通过难度控制或输入设计,让模型少想但想对。

总的来说,它给我们一个清晰的研究地图,可以从哪些角度入手来压缩推理链,从而在医疗诊断、自动驾驶、金融交易等场景里更快、更省、更可靠。