过去一周,硅谷与五角大楼之间的博弈达到了前所未有的紧张程度。这场风暴的中心,是Anthropic与美国国防部围绕AI使用限制的激烈交锋。国防部要求Anthropic允许军方将Claude模型用于“任何合法用途”,并删除合同中关于禁止大规模国内监控和全自主武器系统的限制条款;而Anthropic坚持认为,若无明确限制,AI可能“削弱而非捍卫民主”。

2月24日,国防部长皮特·赫格塞斯(PeteHegseth)对Anthropic公司下达最后通牒:若2月27日下午5点01分前未达成一致,将终止合同并将公司列入“供应链风险”名单。这一标签通常用于与中国、俄罗斯等存在关联的实体,此前从未应用于美国本土科技企业。

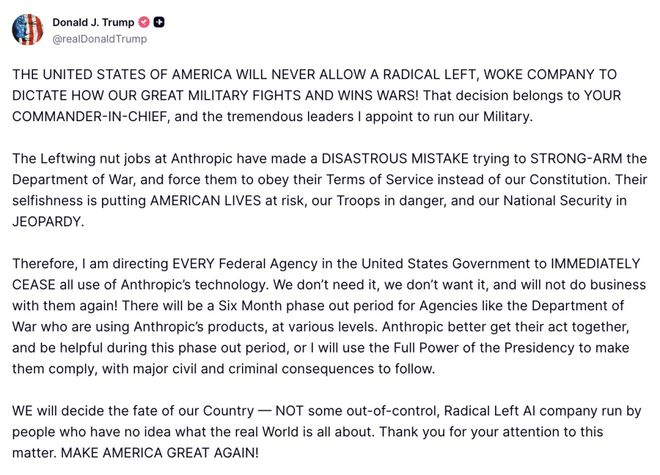

然而,就在27日下午4点,距离截止时间仅剩一小时。美国总统特朗普突然在自己的媒体TruthSocial上发布声明,痛斥Anthropic为“左翼激进分子”,并宣布所有联邦机构立即停用Anthropic技术,并给予六个月过渡期。随后,赫格塞斯在X平台正式宣布将Anthropic列为“国家安全的供应链风险”,指令所有美军承包商、供应商及合作伙伴不得与Anthropic开展任何商业活动。

“原则”的代价

这一切的直接原因,是前一天晚上AnthropicCEO达里奥·阿莫代(DarioAmodei)发表的公开声明。他首先肯定了AI在保卫民主国家、应对专制威胁方面的战略价值,但随即指出,在大规模国内监控和全自主武器系统这两个领域,若不加限制,AI可能带来不可控的风险。

这一立场在科技界引发了广泛共鸣。

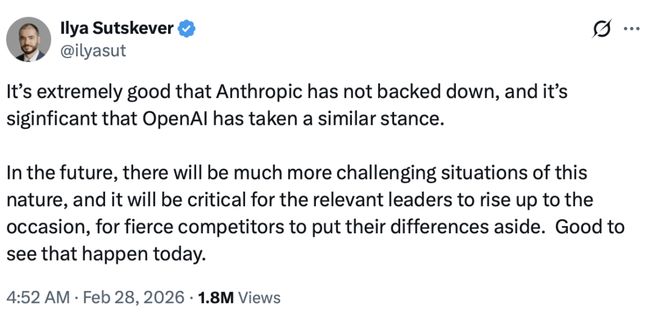

神隐已久的OpenAI联合创始人伊利亚·苏茨克维(IlyaSutskever)公开表示:“Anthropic坚守原则值得肯定,OpenAI也采取类似立场。”

随后,两个由员工组成的联盟其中包括亚马逊公司、谷歌、微软公司和OpenAI的员工也签署了公开信,呼吁各自的公司加入Anthropic的行列,拒绝遵从国防部提出的无限制使用人工智能产品的要求。

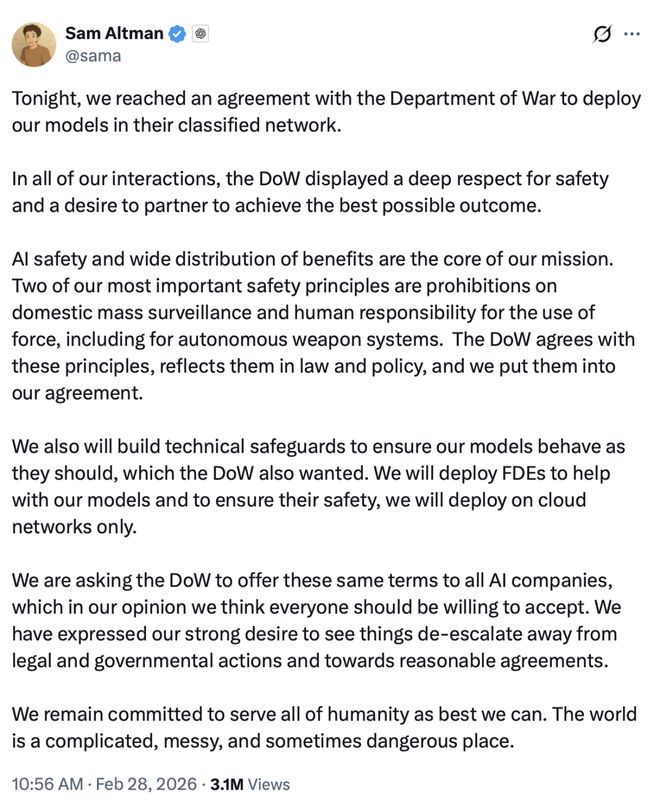

就在行业普遍对Anthropic表示支持之际,周五晚10点58分,OpenAI首席执行官萨姆·奥特曼(SamAltman)毫无征兆地在X平台宣布,他们已与国防部达成协议,将在其机密网络中部署OpenAI模型。

颇具讽刺意味的是,数小时前奥特曼还在内部备忘录中声援Anthropic,强调OpenAI同样坚守“不使用AI进行大规模监控或开发自主致命武器”的红线。

这一立场的快速转变,迅速引发质疑,社交媒体上批评声四起。

“合法”与“合理”的灰色地带

既然奥特曼在声明中也表示OpenAI将保留对大规模监控与自主武器的使用禁令,那么这些措施与Anthropic坚持的原则究竟有何实质差异?为什么国防部绕了个远路还要选择一样的目的地呢?

Axios的分析指出,关键在于双方约束的颗粒度不同。奥特曼的声明似乎默认“大规模监控本身违法”,国防部将遵守现行法律。但Anthropic的核心关切恰恰是:法律尚未充分回应AI的整合能力。即便单条数据收集“合法”,AI却能将其大规模聚合,形成远超传统手段的侵入性监控。这种“合法但不合理”的灰色地带,才是争议焦点。

Anthropic试图通过合同条款明确禁止某些行为,而OpenAI似乎更愿意依赖“遵守现行法律”的模糊承诺,将解释权留给了军方。

OpenAI此举获得进入国防部机密网络的独家通道,不仅意味着可观的合同收益,更可能在AI军备竞赛中占据先发优势。军事场景被视为验证与推进AI能力的关键试验场,这一布局具有战略意义。

相比之下,对Anthropic而言,失去合同不仅是2亿美元的经济损失(约占其140亿美元年收入的1.4%),更关键的是市场信号与声誉影响。公司原计划今年上市,估值高达3,800亿美元,此次事件是否影响IPO进程,尚待观察。

AI与国防未来的悬念

这场冲突发生于行业环境深刻变化的背景下。过去,科技从业者对军事合作的抵制曾产生实质影响:2018年Google在员工抗议后放弃续签ProjectMaven合同;2021年亚马逊在隐私倡导者与员工压力下,无限期限制警方使用其面部识别工具。

但近年来风向已变。自2022年俄乌冲突以来,AI无人机等技术在实战中的广泛应用,推动资本重新关注国防科技。2025年,风投向军事科技领域投入约500亿美元,近乎2024年的两倍。

特朗普第二任期开启后,硅谷与白宫关系进一步升温。扎克伯格、库克、黄仁勋等科技领袖频繁访问白宫。2025年2月,Google取消对其AI用于武器与监控的禁令,且选择在其年度公共部门销售动员会上同步宣布,合作信号意味明显。

国防部现在也并非只有OpenAI一个选项,Google与埃隆·马斯克的xAI均与国防部签有合同。据Axios报道,xAI已达成协议,允许军方在机密系统上使用Grok模型,成为继Anthropic之后第二家获批企业;Google也正就Gemini模型的机密部署进行谈判。

这场博弈没有简单的对错。但当AI能力指数级进化,而法律与伦理框架仍在线性迭代,“合法”与“合理”的缝隙只会越来越大。三方角力背后,真正需要回答的是:我们希望在AI时代,保留怎样的人类控制权?

1.https://fortune.com/2026/02/27/openai-in-talks-with-pentagon-after-anthropic-blowup/

2.https://www.theinformation.com/briefings/defense-secretary-hegseth-declares-anthropic-supply-chain-risk-cutting-military-contractors

运营/排版:何晨龙