最近几天,用OpenClaw这个本地优先的开源AI框架,终于把飞书语音对话彻底跑通了。

2026年3月,OpenClaw GitHub星标已超28万,成为史上增长最快的开源项目,本地运行就能让AI直接接管飞书语音收发,数据全程不离设备,一下子把云端隐私泄露的巨大隐患给掐死了。

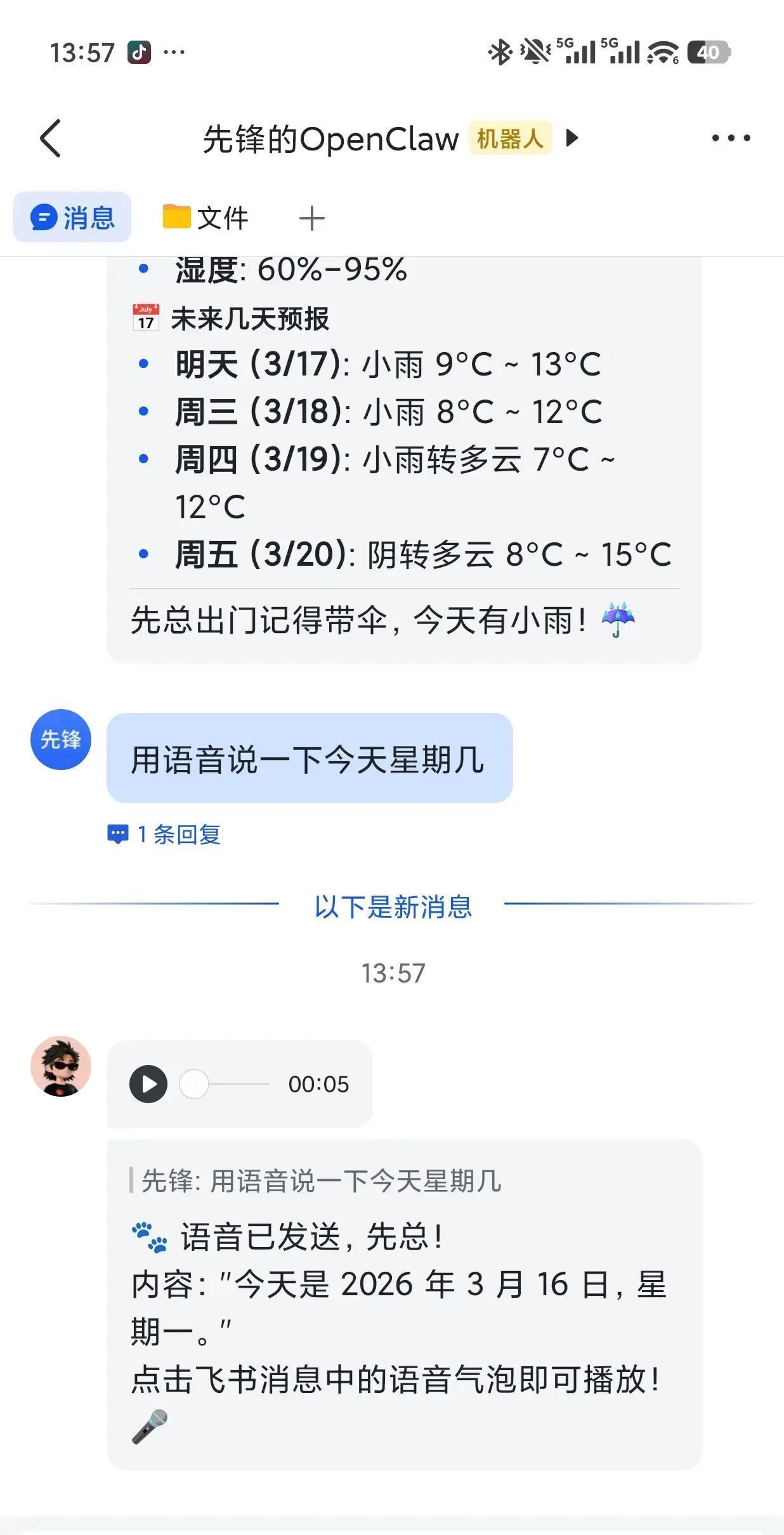

核心冲突就在这儿:大家天天在飞书聊工作、发语音指令,却总担心敏感对话被云端大厂看到。现在用Whisper tiny做本地语音识别,中文准确率日常场景稳超90%,再配EdgeTTS微软神经语音合成,音质清晰自然,支持男女声切换,全程零云依赖。

流程其实不复杂。先在飞书开放平台建自定义应用,拿App ID和Secret,开启机器人消息收发、事件订阅,重点把文件上传和im:message相关权限配齐,避免语音发不出去。

然后部署OpenClaw,装上官方飞书插件,一条命令openclaw channels add feishu就把通道绑好。语音闭环靠三个本地组件:Whisper转文字、OpenClaw核心处理逻辑、EdgeTTS生成语音,最后用FFmpeg把MP3转成飞书专用的OPUS格式,直接上传发送。

实测下来最稳的点是安全和可控。云端方案动不动就传数据出去,企业聊天记录、客户需求全暴露风险。现在全链路本地,模型自己选、插件自己改,还能随时加日程查询、文档等技能,办公场景直接变身数字员工。

但落地也有硬伤:飞书权限少配一个就卡死,OPUS格式不转就报不支持,本地模型没提前下好运行时容易卡。尤其是App Secret泄露等于把钥匙交给别人,后患无穷。

这套方案真正价值在于,它证明了本地优先不再是理想,而是2026年最务实的办公AI路径。OpenClaw把AI从“只会说”推到“真能干”,飞书语音只是起点,未来对接更多工具、实现多轮上下文连续对话,才是企业真正需要的落地方式。数据自己握在手里,能力却越来越强,这才是AI该有的样子