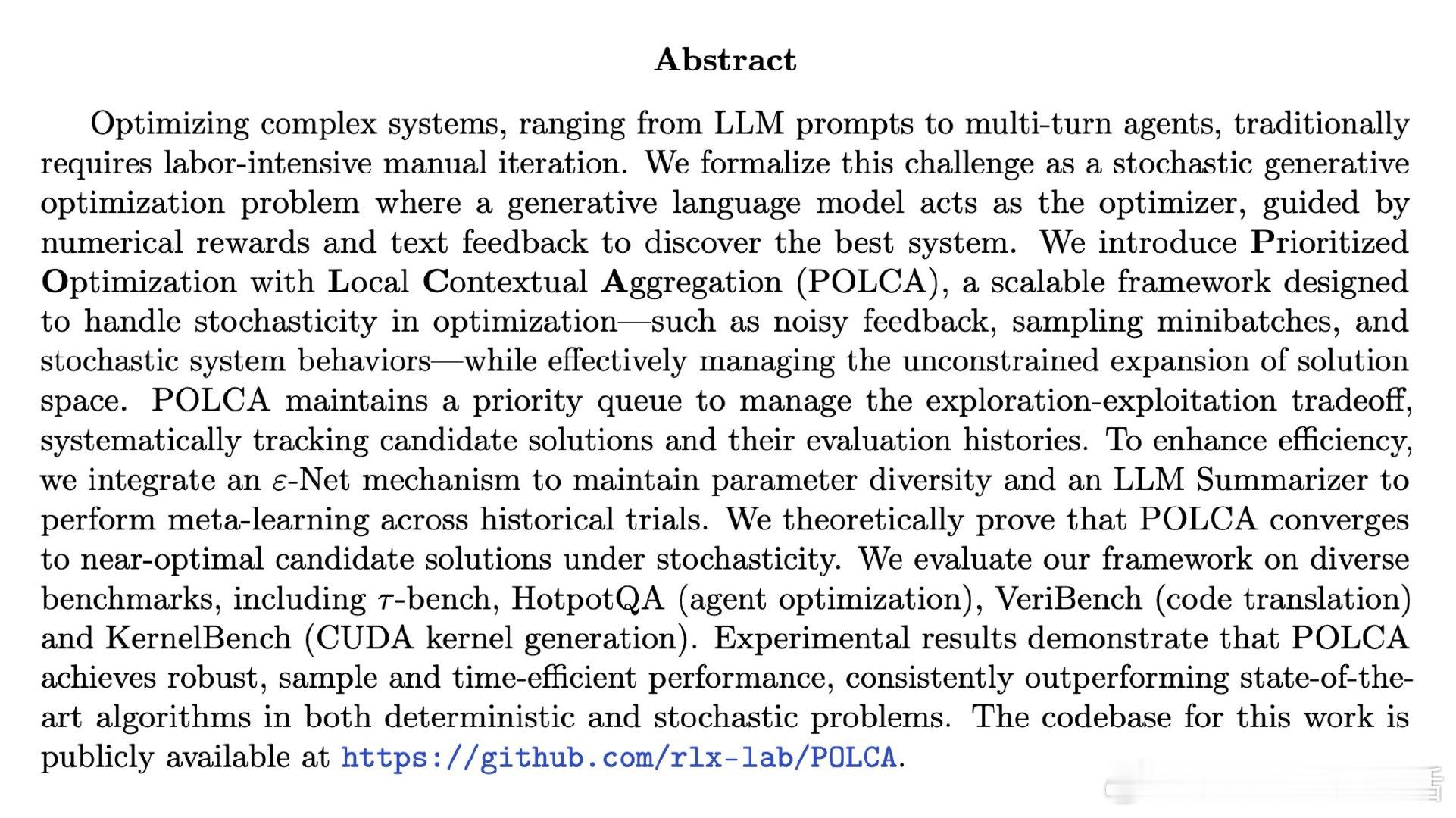

[LG]《POLCA: Stochastic Generative Optimization with LLM》X Ren, A Nie, T Xie, C Cheng [University of Wisconsin-Madison & Google DeepMind] (2026)

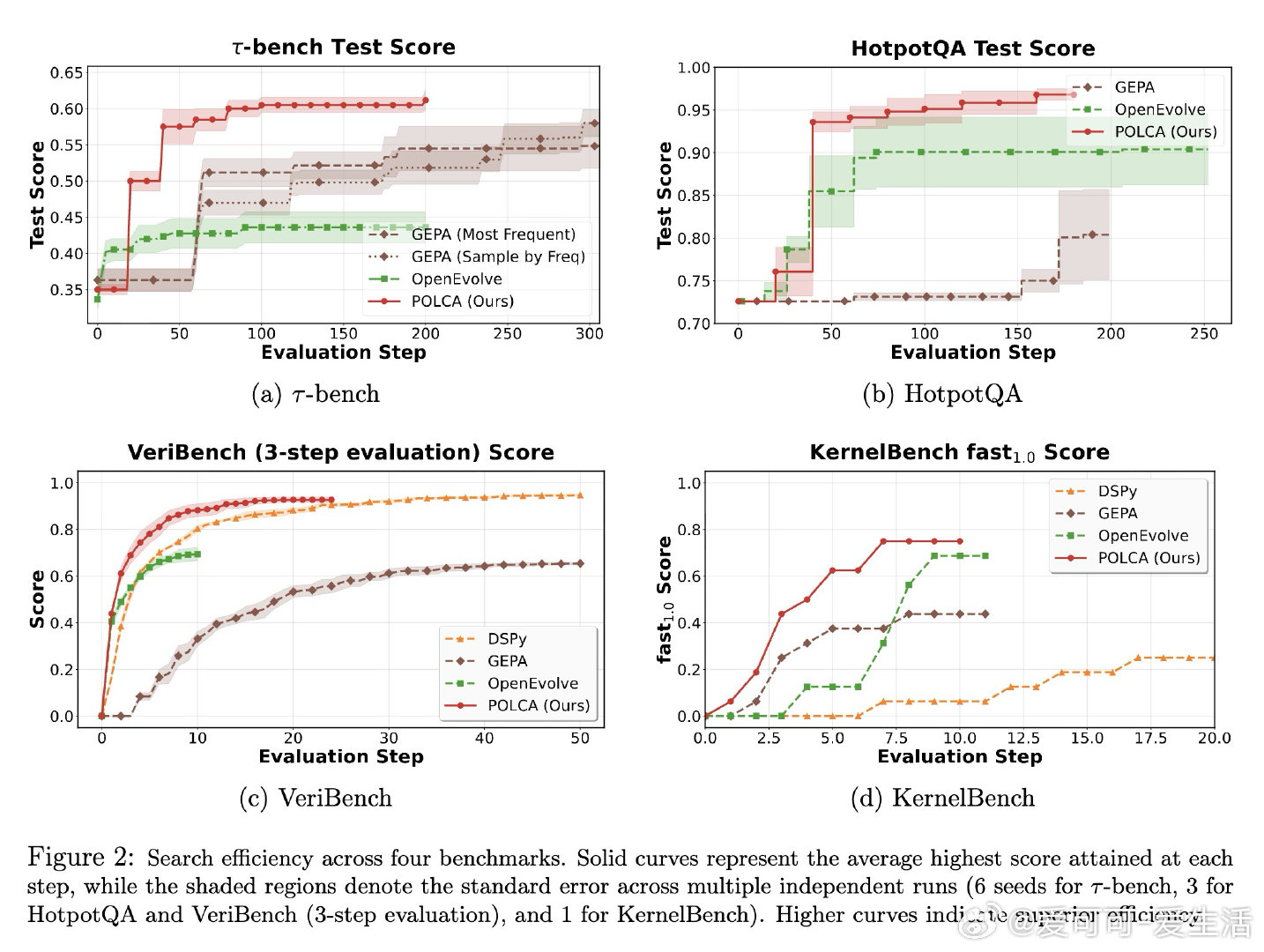

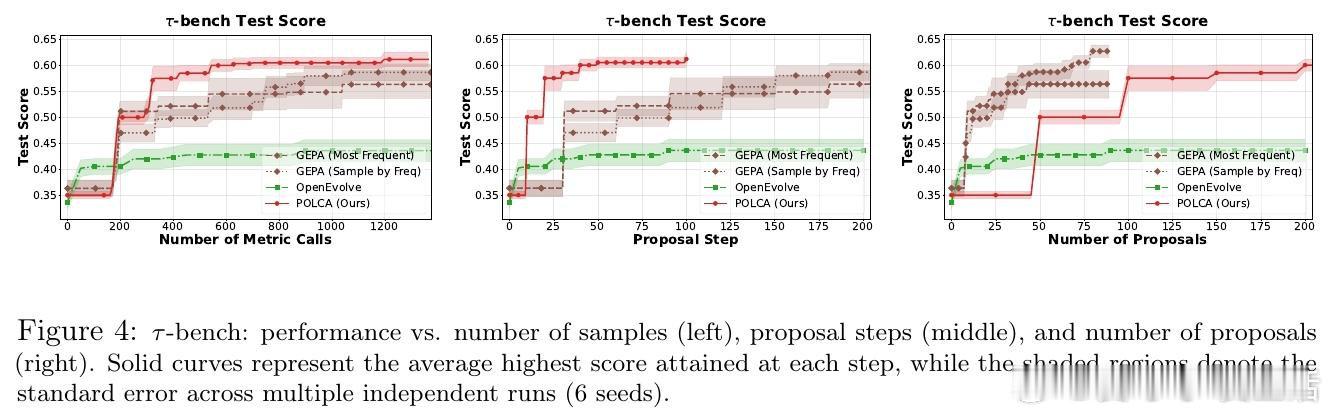

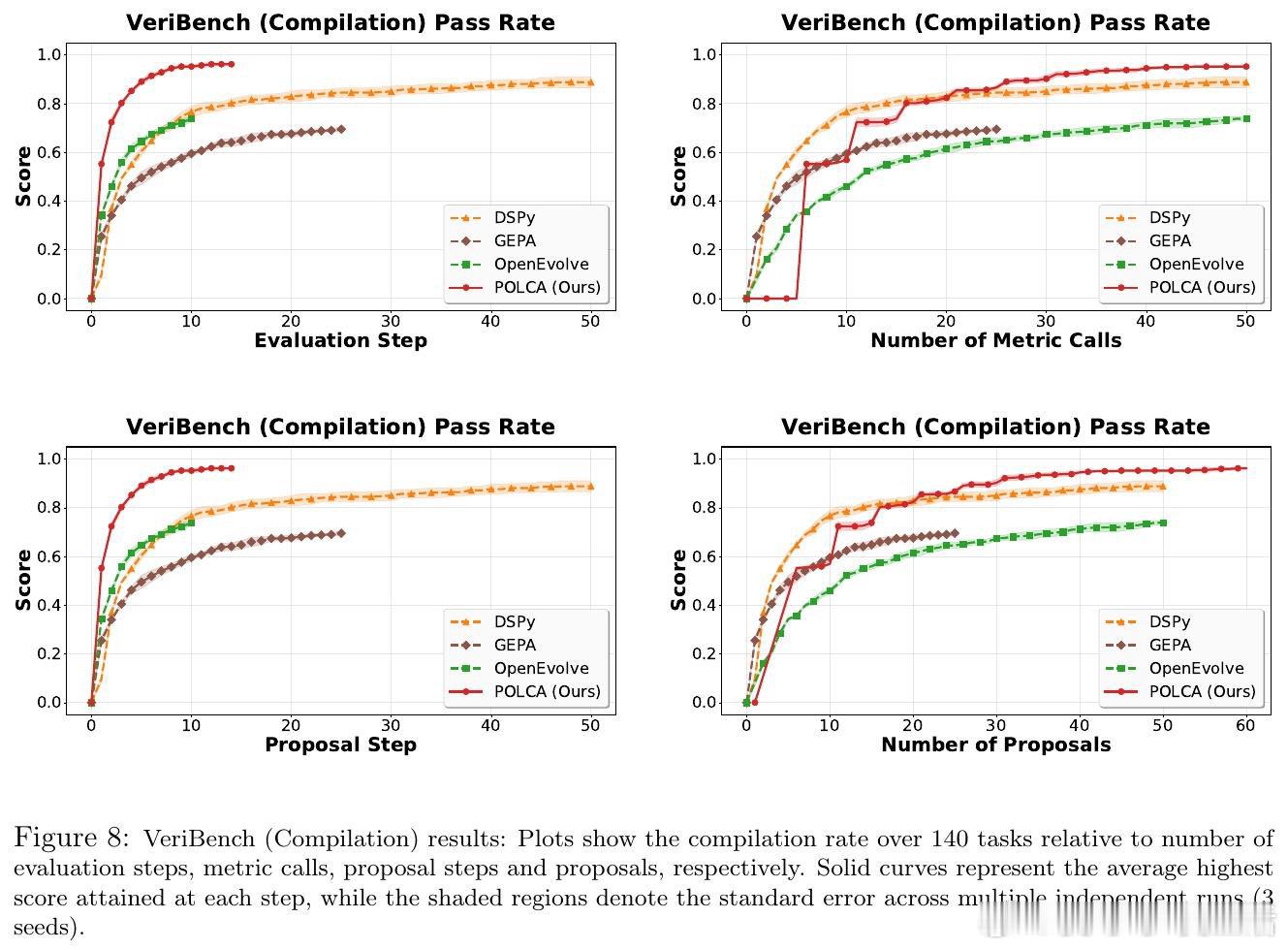

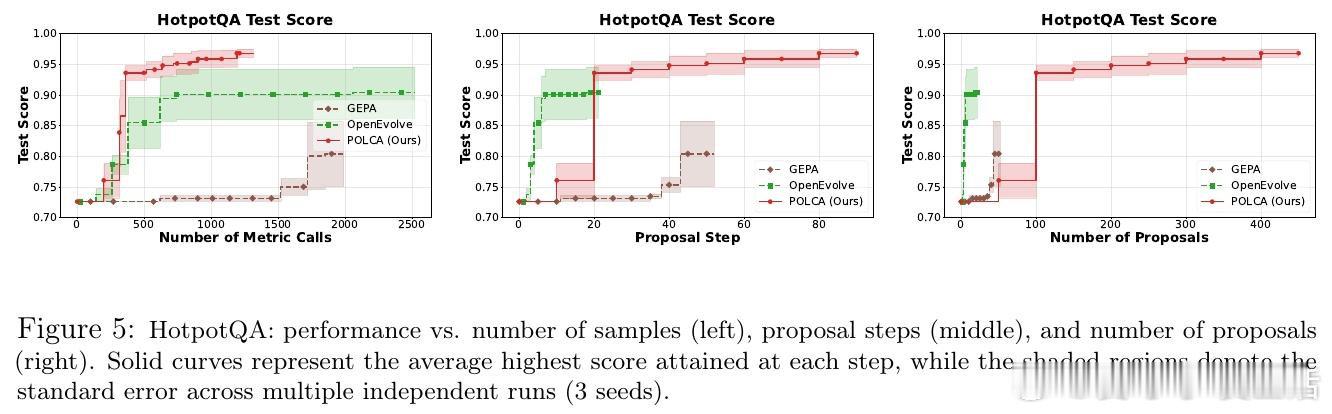

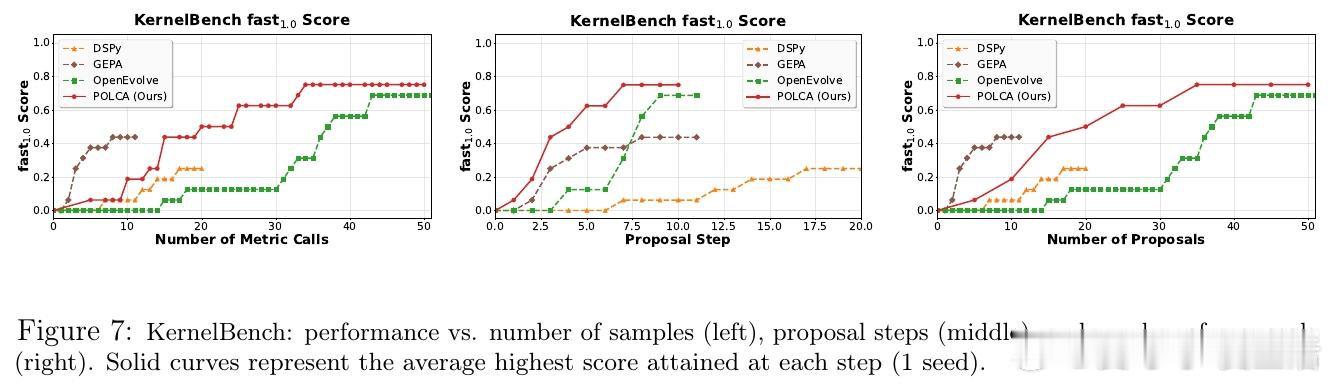

在 LLM 驱动的系统优化领域,如何在噪声评估、随机程序行为与小批量采样三重干扰下稳定搜索,是一个悬而未决的难题。过去方法——无论进化搜索还是 Pareto 前沿——均假设评估预算充裕且近似无噪,导致在随机环境中频繁误判候选方案、陷入局部震荡。

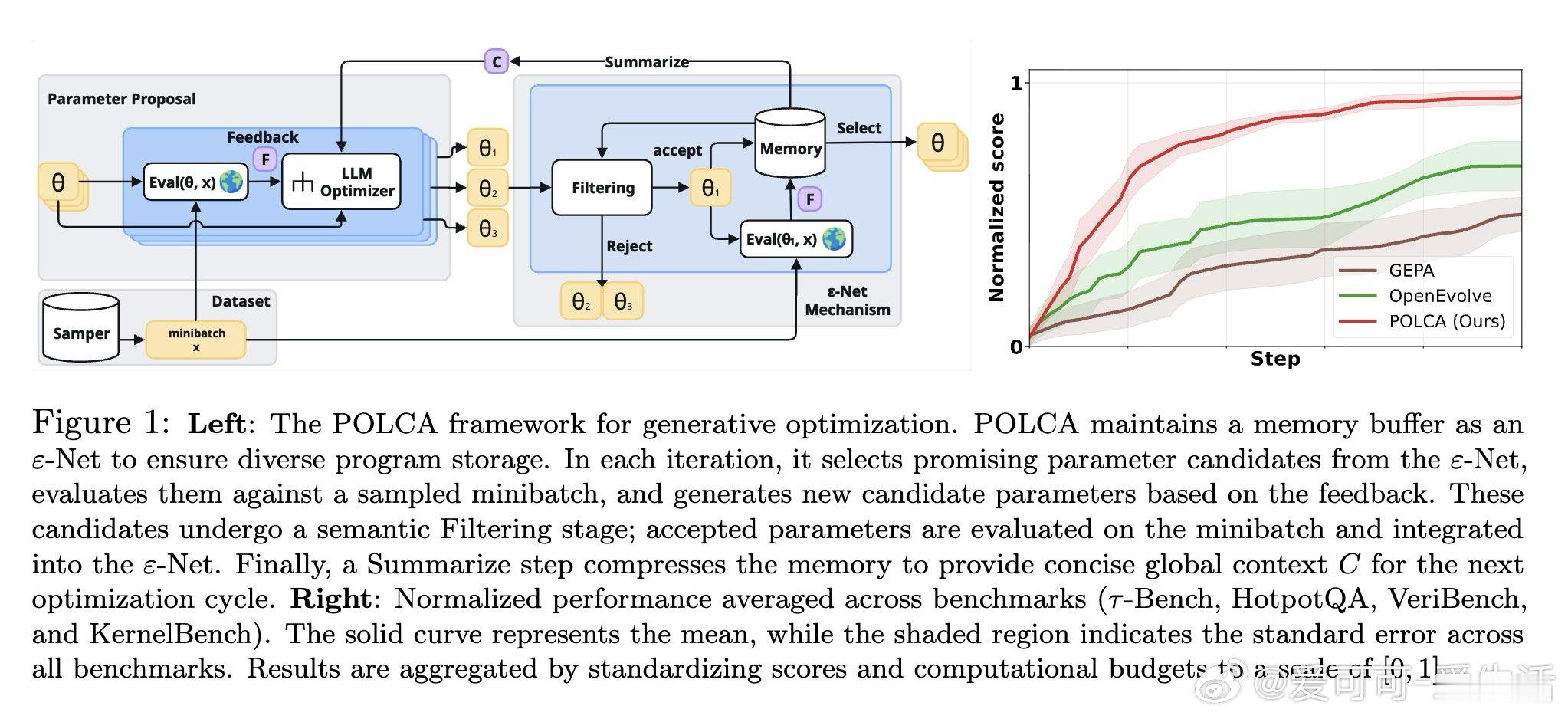

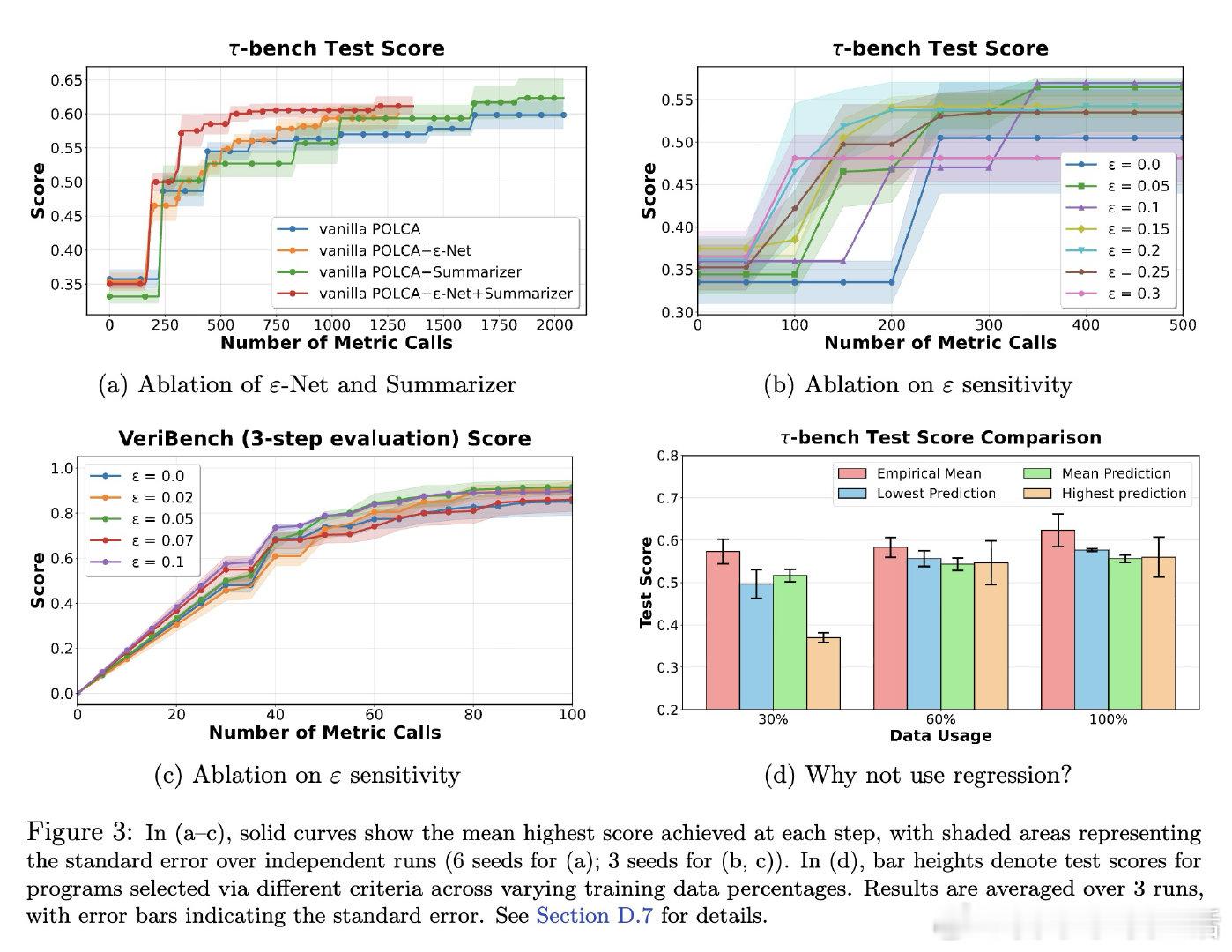

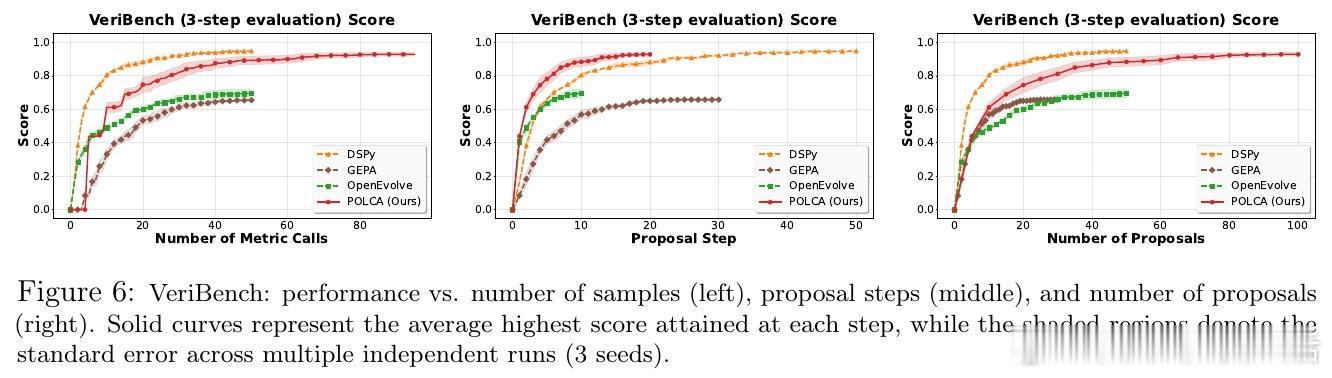

本文的核心洞见是:把"哪些候选值得继续评估"重新看作一个覆盖-代价权衡问题,而非简单的淘汰比较。由此,基于语义嵌入距离的 ε-Net 过滤这一关键操作,使算法得以剔除语义冗余提案、将记忆池规模上界与参数空间解耦;而持续更新的优先队列则通过累积均值逐步抵消噪声,防止有价值候选被噪声误杀。

这项工作真正留下的遗产是:首次将随机生成式优化形式化,并给出可证收敛的算法框架,填补了 LLM-as-optimizer 理论保障的空白。它为后来者打开的新门是:如何利用嵌入空间几何结构系统性地控制搜索开销与近似误差之间的折衷。但尚未跨过的门槛是:收敛保证依赖对优化器能力的理想化假设,且嵌入质量直接决定过滤有效性,在嵌入不可靠的领域中鲁棒性尚待验证。

arxiv.org/abs/2603.14769

机器学习 人工智能 论文 AI创造营