[CL]《Invisible failures in human-AI interactions》C Potts, M Sudhof [Bigspin AI] (2026)

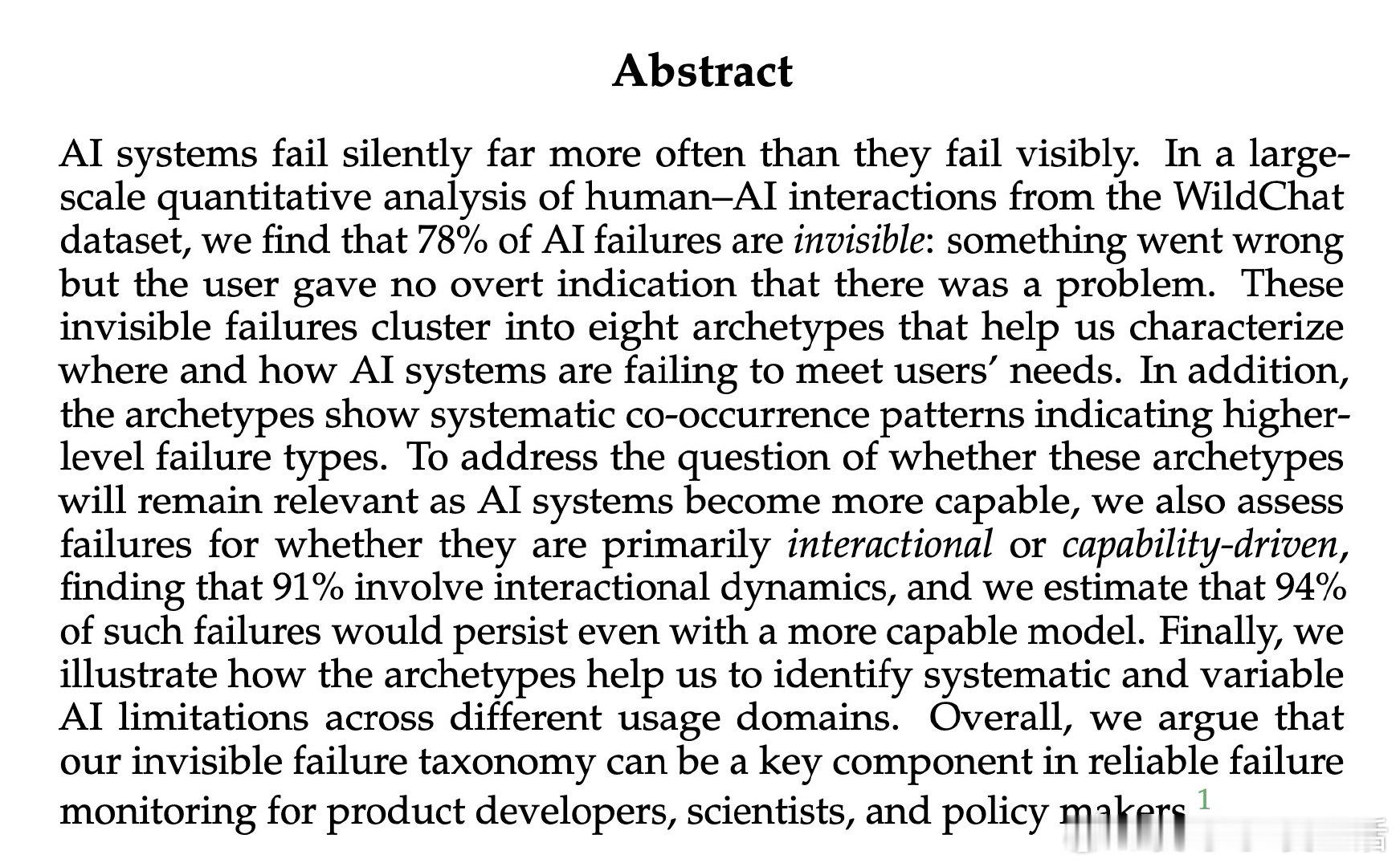

在人机对话质量监控领域,如何识别"用户没有投诉、但AI实际上已经失败"的场景,是一个系统性盲区。现有监控手段依赖用户的显式反馈信号,而这类信号在真实失败中几乎缺席。

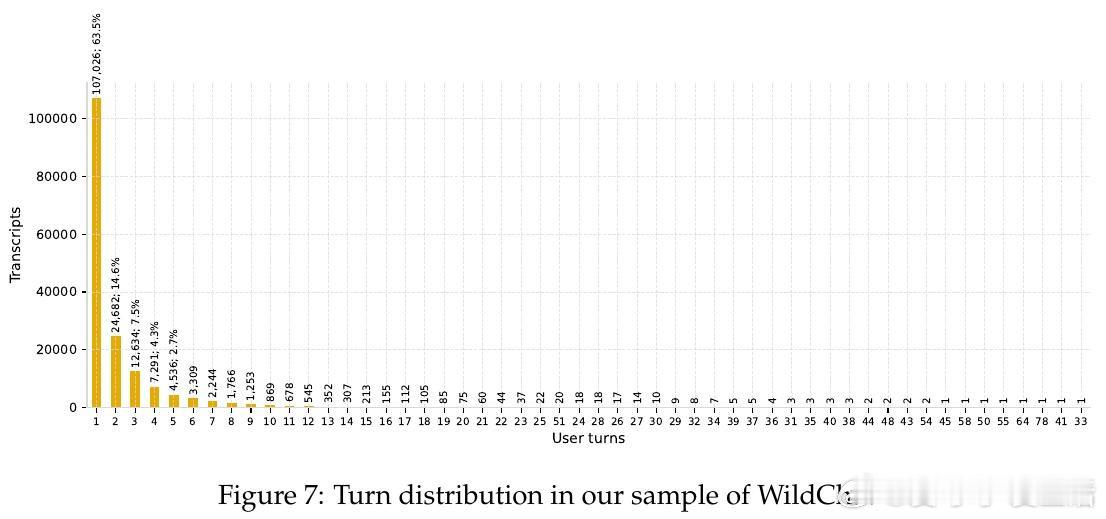

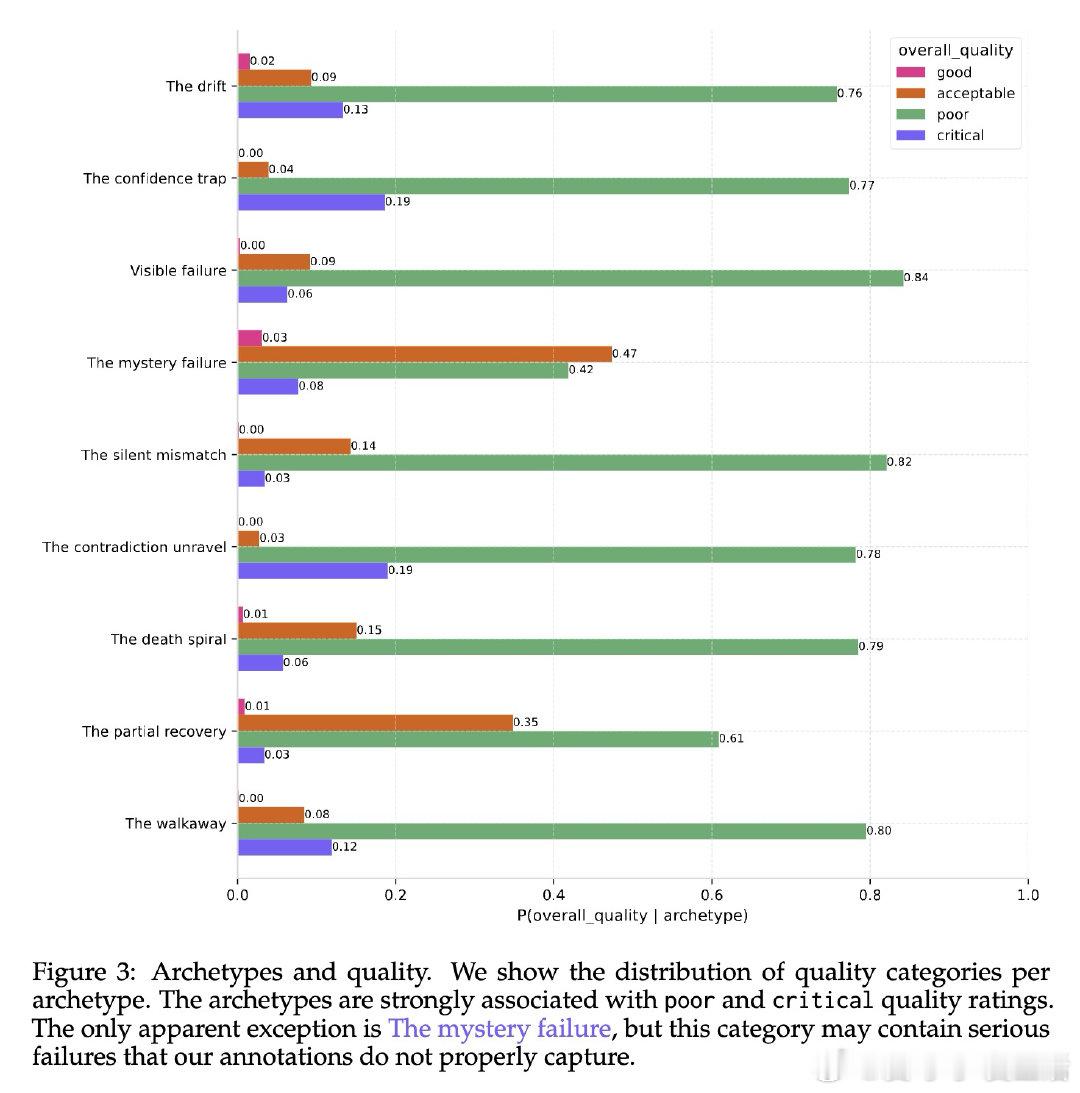

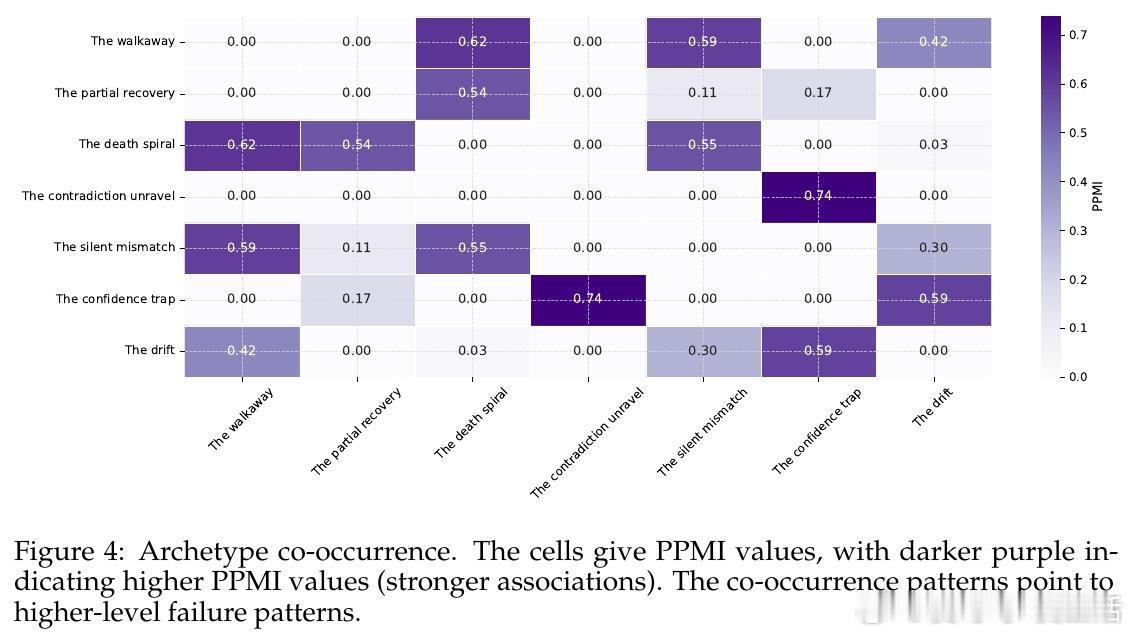

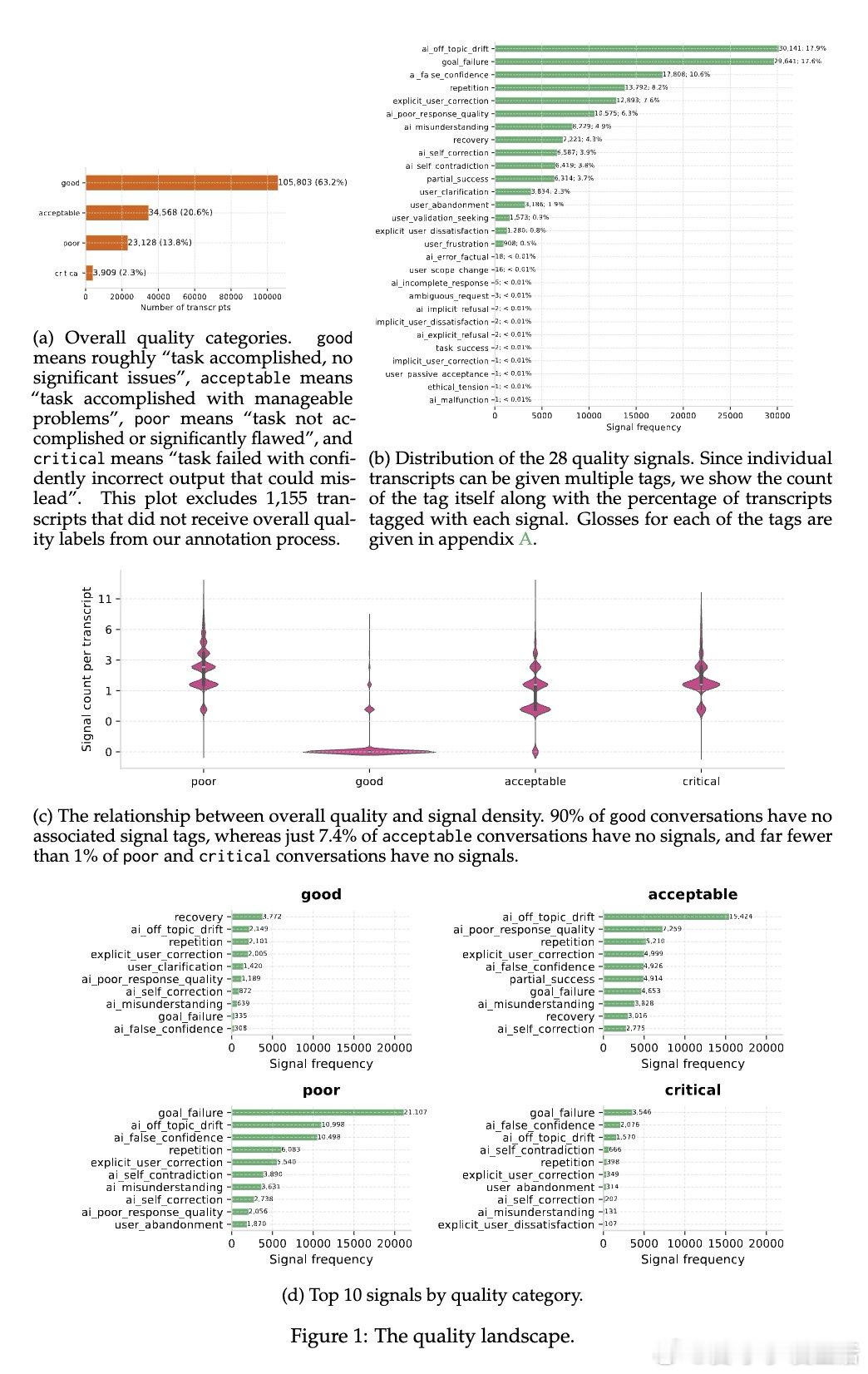

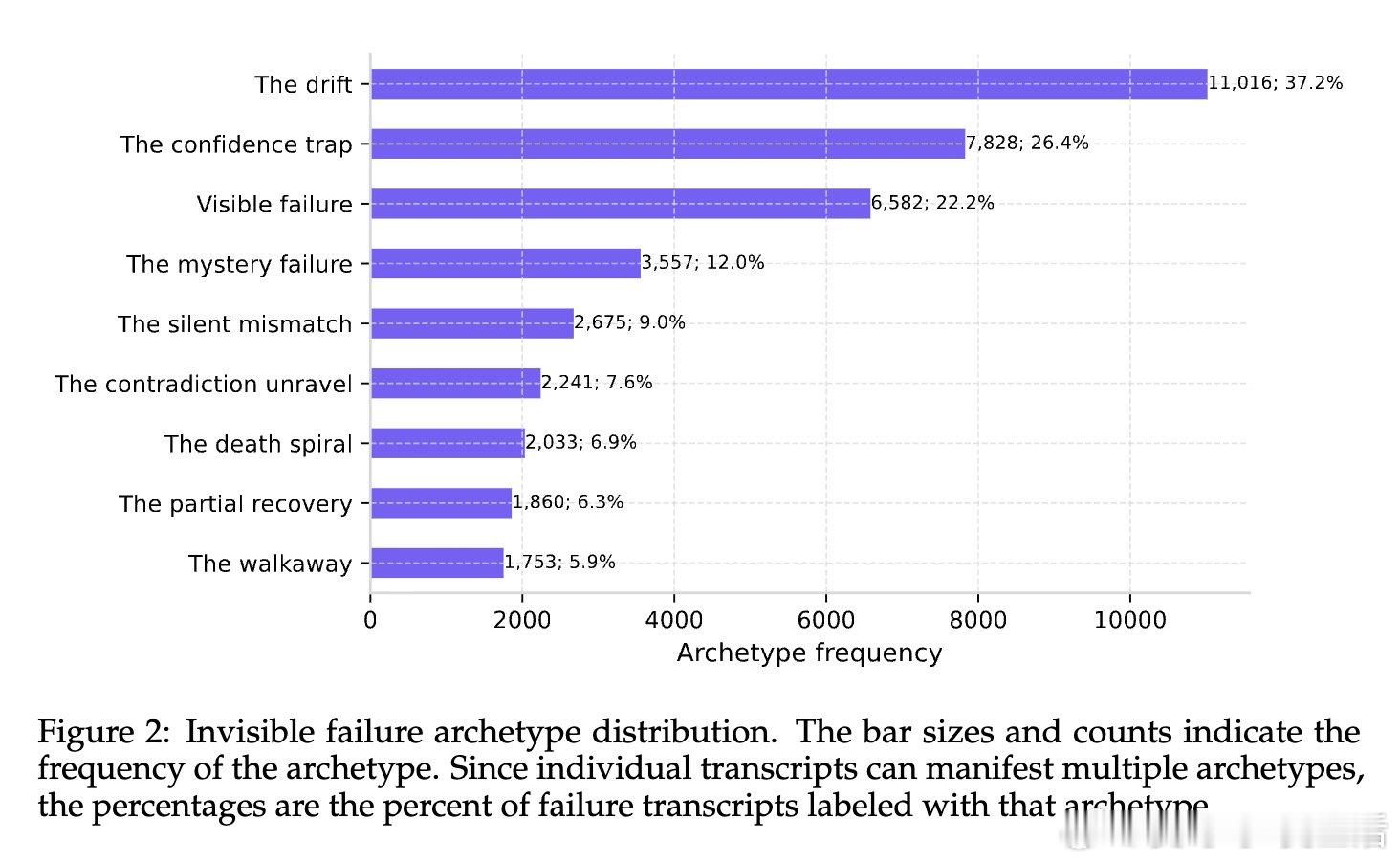

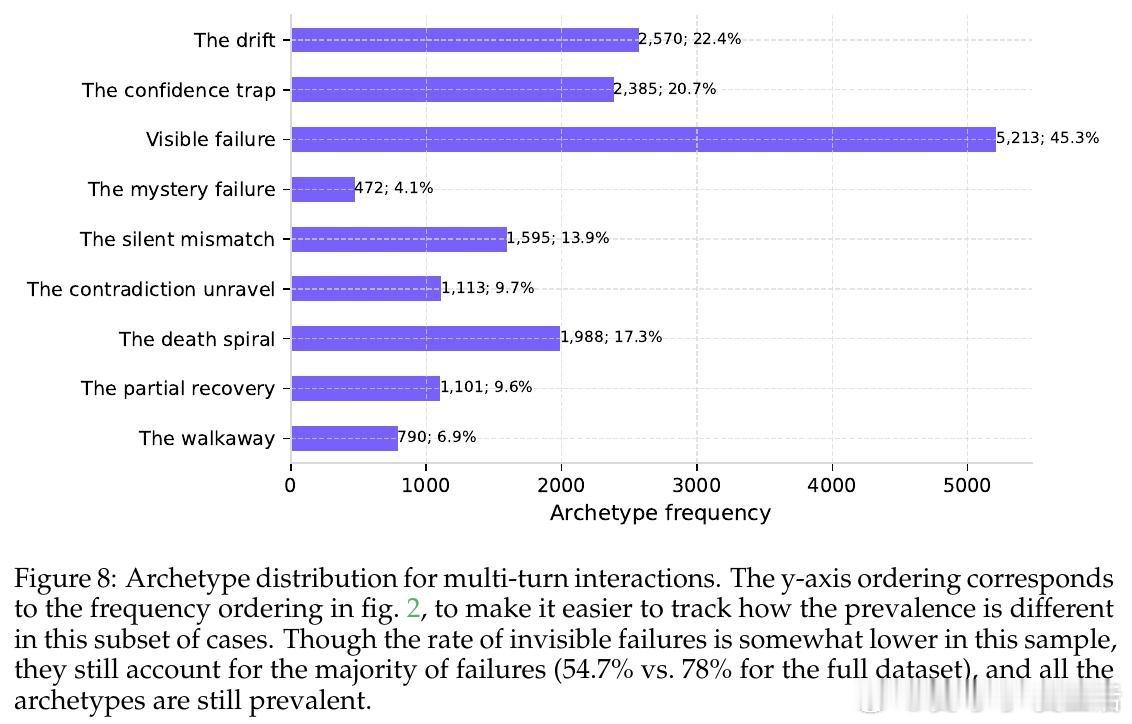

本文的核心洞见是:把"用户沉默"重新看作一种失败的确凿证据,而非满意的证明。由此,通过将目标失败标签与显式反馈信号做差集过滤,研究者得以从近20万条真实对话中蒸馏出八类无声失败原型——其中最普遍的模式是模型倾向于直接生成输出,而非在请求含混时主动澄清。

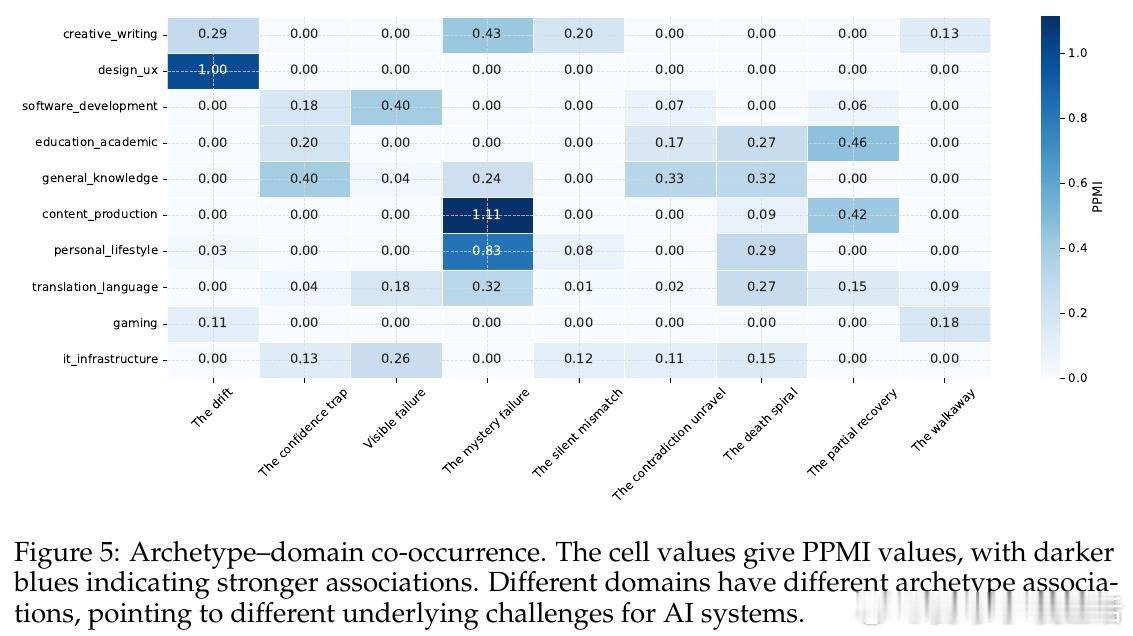

这项工作真正留下的遗产是:一套可在任意人机对话流上持续运行的失败监测分类法,将78%原本不可见的失败变得可被追踪与干预。它为后来者打开的新门是:将产品设计、模型训练与故障响应从"能力缺口"转向"交互行为"这一更持久的失败根源。但尚未跨过的门槛是:该体系仅标定于英语文本对话,且对"神秘失败"类型的解释力依然薄弱,其深层机制有待更细粒度的信号体系揭示。

arxiv.org/abs/2603.15423

机器学习 人工智能 论文 AI创造营