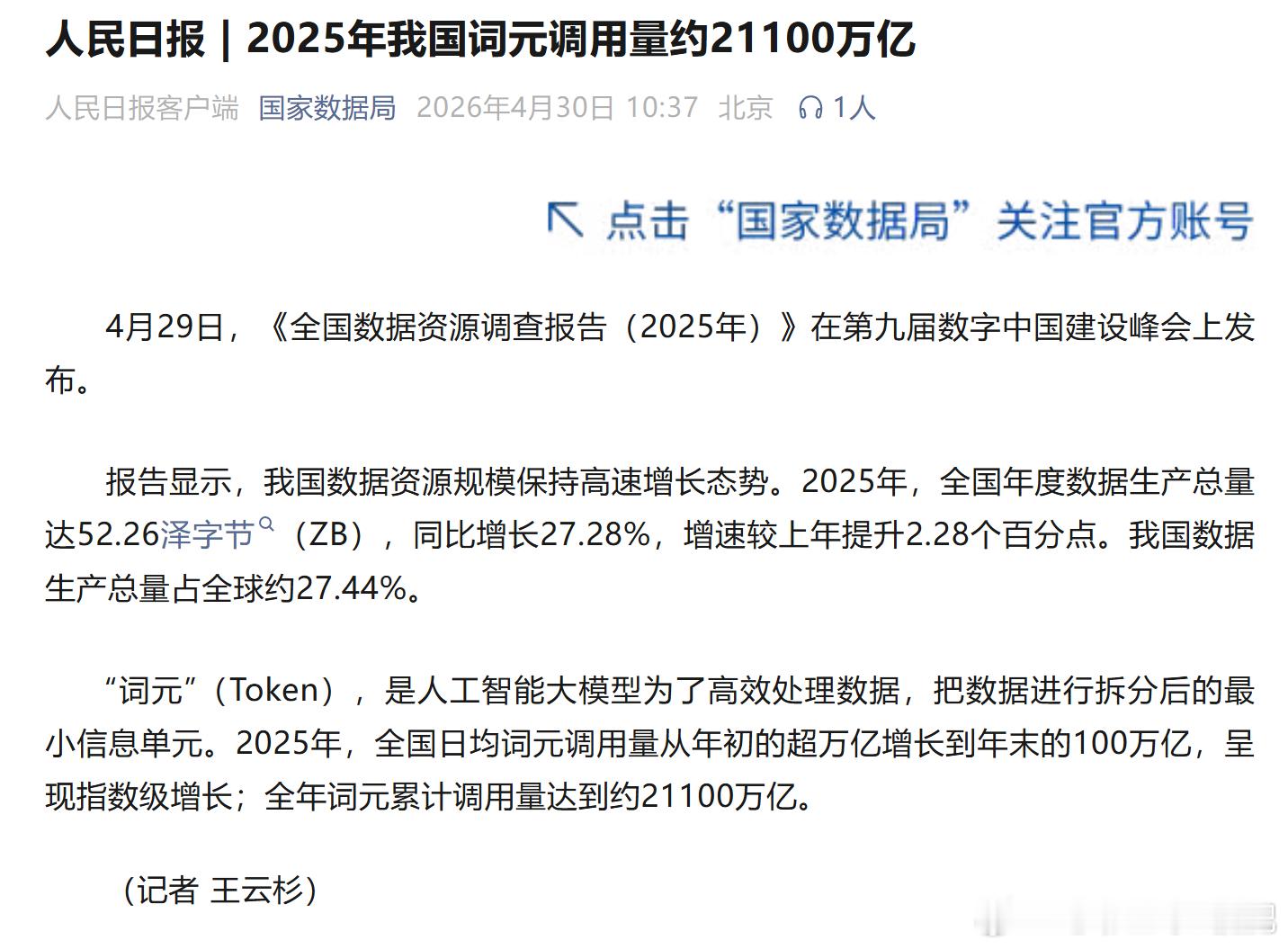

国家统计局:2025年全国词元(token)累计调用量2.11万亿。

这是个什么概念?token在不同阶段其实会产生不同的数据规模,可以简单理解为动植物物-食材-备菜-装盘整个烹饪过程中,不同状态对应的「体积」。

举个例子,一个汉字字符如果以token的形式单存进硬盘里,大概要占用3-6byte空间;如果输入到模型中开始推理了,那么在embedding(嵌入)阶段就可能占用32KB的缓存;而到了半精度推理阶段,最高可以占用128KB左右的显存。

如果我们按照推理阶段+半精度来估算的话,2025年我们全员在推理端消耗了257538359GB的token,可以塞满3.15万个8TB的机械硬盘。

这么多机械硬盘放在一起,大概是13000升的体积,大家可以算算要多少台国产大三排新能源SUV才能装载全国人民的AI热情(可算是绕回我的本职工作了)。

token词元token是什么