学习大语言模型(LLM)常常需要翻阅各种资料,Transformer架构论文难懂,训练部署细节零散,还要搜集多模态和微调教程。

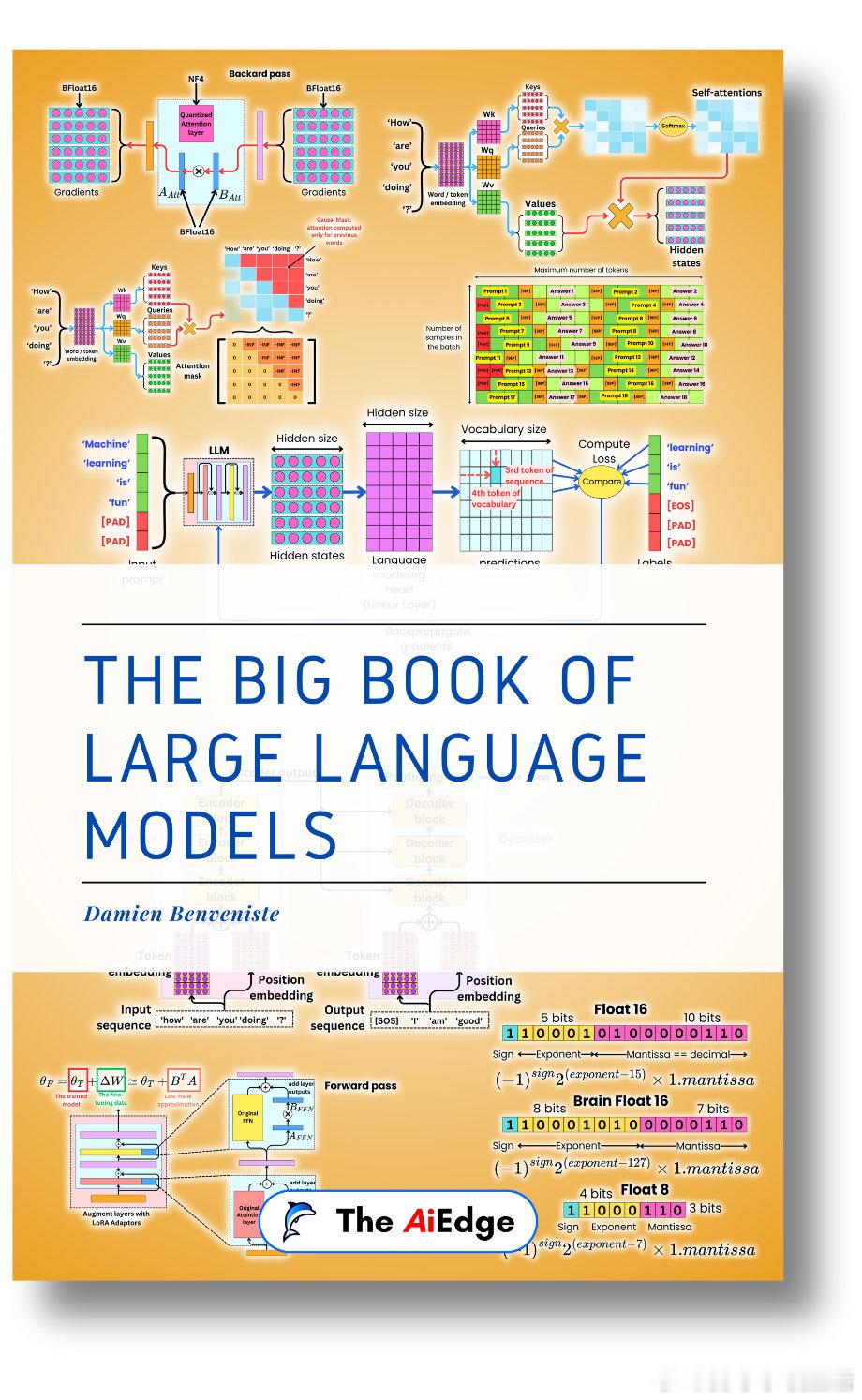

《The Big Book of LLMs》把LLM全知识体系整合到一本手册,提供从基础到部署的完整指南。

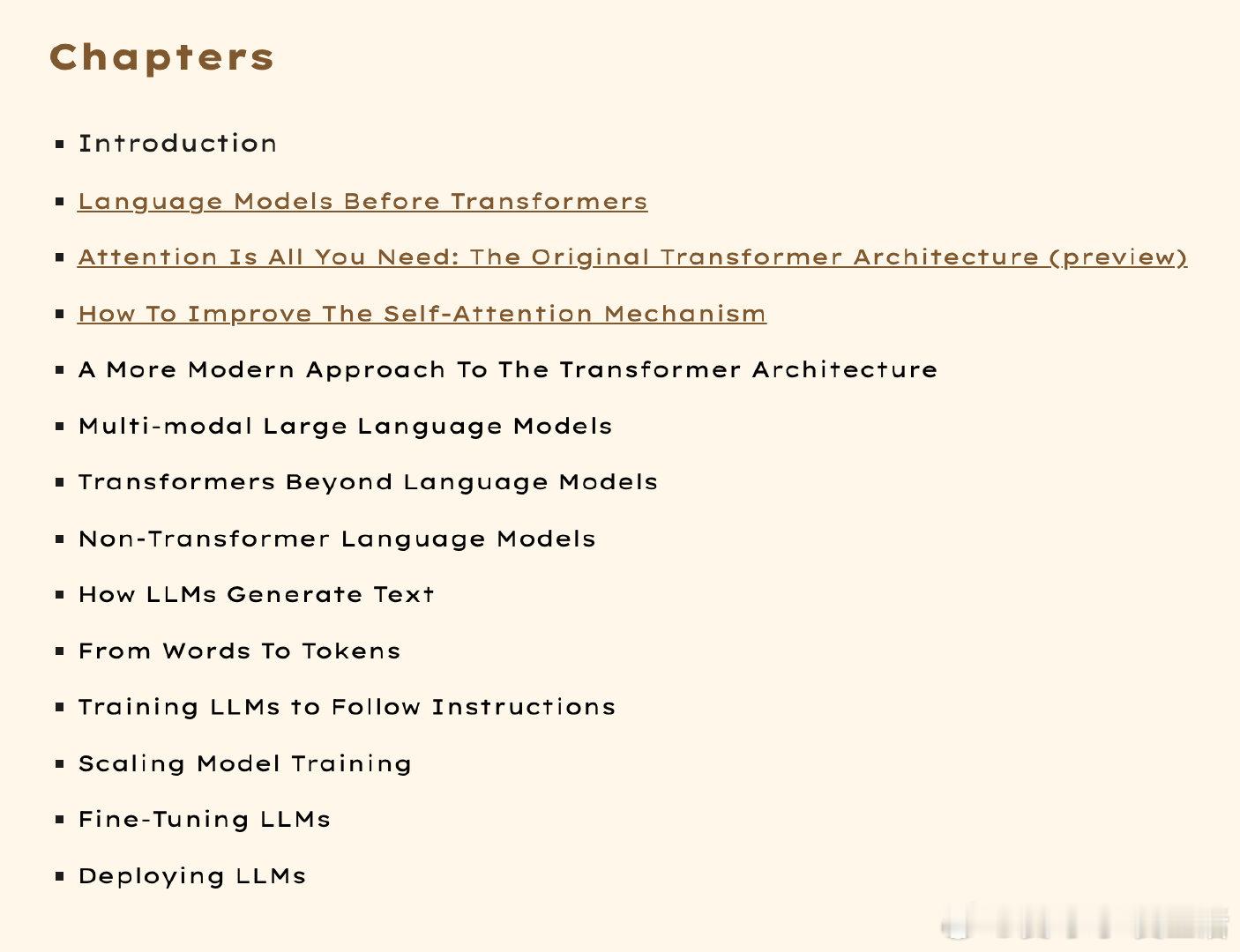

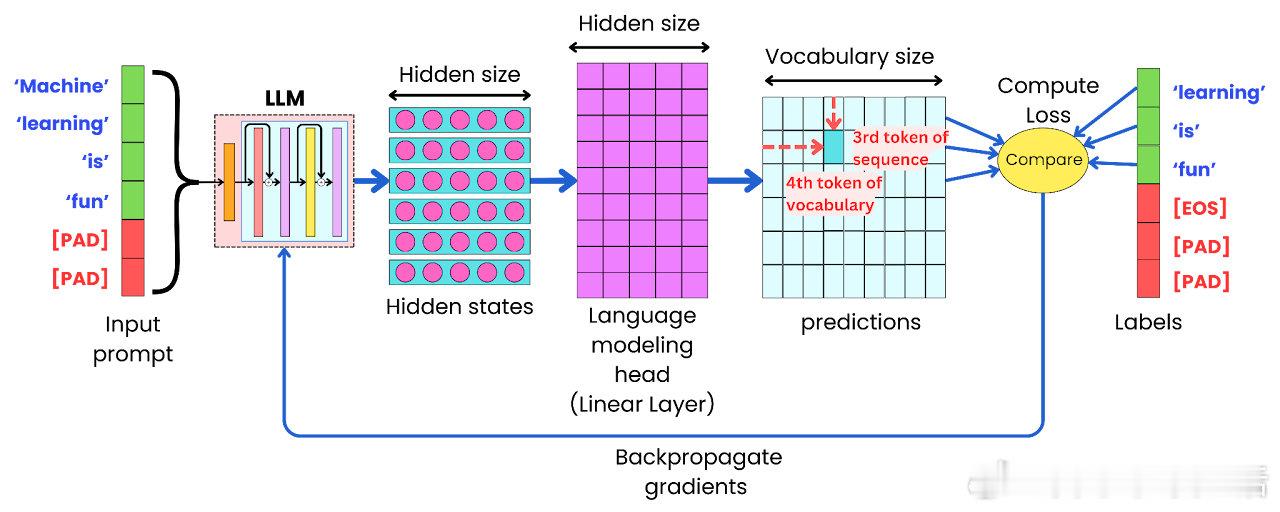

不仅详解Attention机制和现代Transformer架构,还覆盖多模态LLM、非Transformer模型、指令微调、模型训练与部署,甚至包括文本生成和分词原理。

网站:book.theaiedge.io

- 详尽讲解Transformer原论文《Attention Is All You Need》和自注意力改进;- 介绍多模态LLM及超越语言模型的应用;- 剖析LLM文本生成、从词到Token的过程;- 指导指令训练、Scaling训练和Fine-Tuning技巧;- 部署LLMs的最佳实践;- 涵盖非Transformer语言模型前沿。

由Meta前ML Tech Lead Damien Benveniste撰写,支持在线阅读,适合AI工程师、研究者和创业者深入掌握LLMs。

AI创造营大语言模型