【LLM 文档腐蚀 25% 引热议,这场研究可能从一开始就站不住脚】

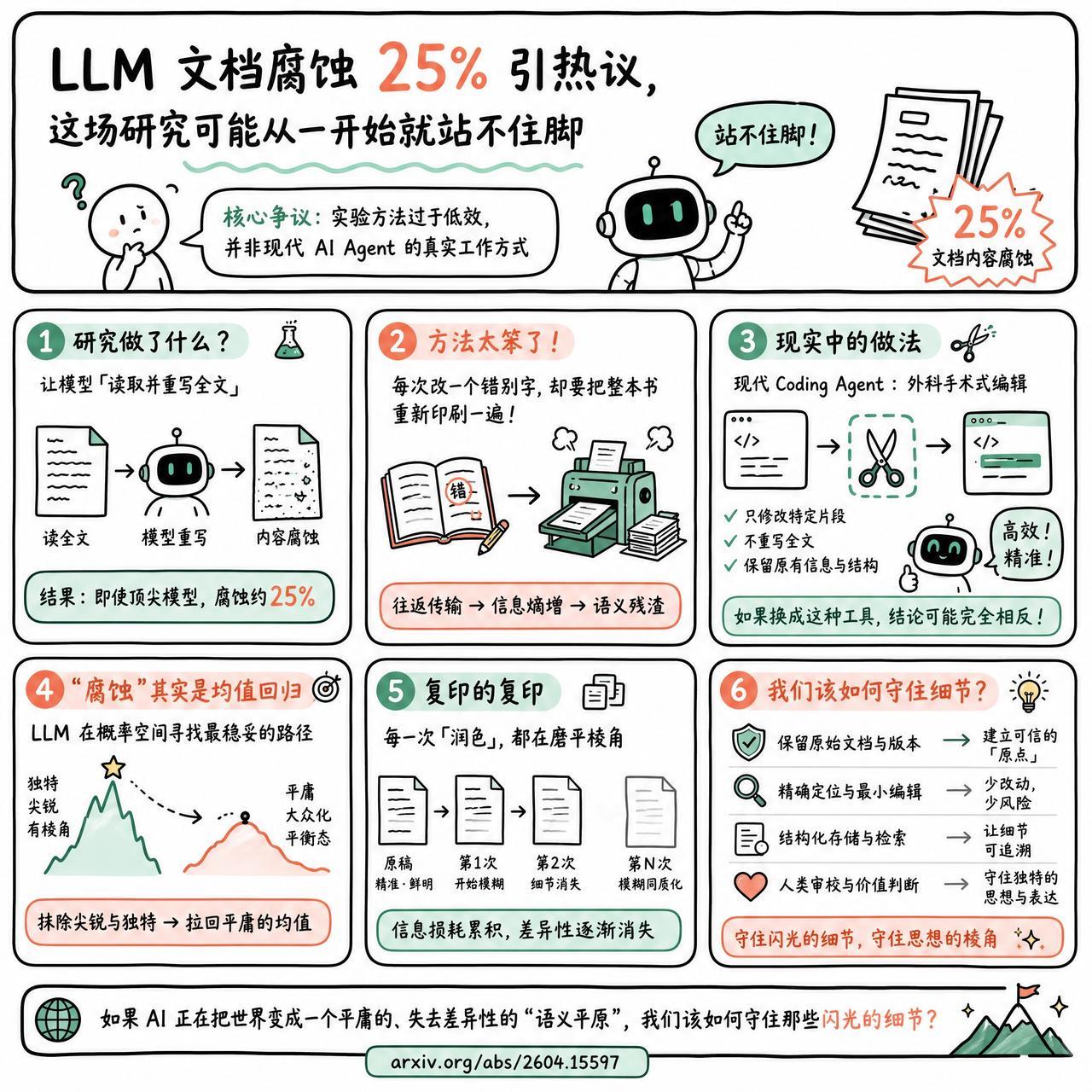

快速阅读:一篇关于 LLM 在长流程任务中会导致文档内容腐蚀的研究引发了激烈讨论。核心争议在于:实验所用的“读取并重写全文”的低效模式,并非现代 AI Agent 的真实工作方式。

《LLMs Corrupt Your Documents When You Delegate》这篇论文给人的感觉很像是在测试一个人能不能靠背诵来改作文,结果发现他记不住,于是得出“人类不适合改作文”的结论。这显然站不住脚。

研究发现,即便最顶尖的模型,在长流程任务中也会让文档内容腐蚀约 25%。但问题在于,他们测试的方法太笨了:让模型把整个文件读一遍,再重新写一遍。这在工程上简直是灾难,就像是每次改一个错别字都要把整本书重新印刷一遍,这种“往返传输”必然会导致信息熵增,最终让文档变成一堆模糊的、失去灵魂的“语义残渣”。

有网友提到,现代 Coding Agent 的做法完全不同。它们使用的是“外科手术式”的编辑,通过指令只修改特定的代码片段,而不是让文本流经模型进行重写。如果实验能换成这种更符合实际的工具集,结论大概会完全相反。

更有意思的观点在于,这种“腐蚀”其实是一种均值回归。LLM 本质上是在概率空间里寻找最稳妥的路径,它会悄悄抹除掉你文档中那些尖锐、独特、甚至有些古怪的细节,把它们拉回到一种平庸的、大众化的平衡态。

这就像是在做复印件的复印。每一次经过 LLM 的“润色”,原本精准的科学论述或独特的表达,都会像被磨平的棱角一样,逐渐变得模糊且同质化。

如果 AI 正在把世界变成一个平庸的、失去差异性的“语义平原”,我们该如何守住那些闪光的细节?

arxiv.org/abs/2604.15597