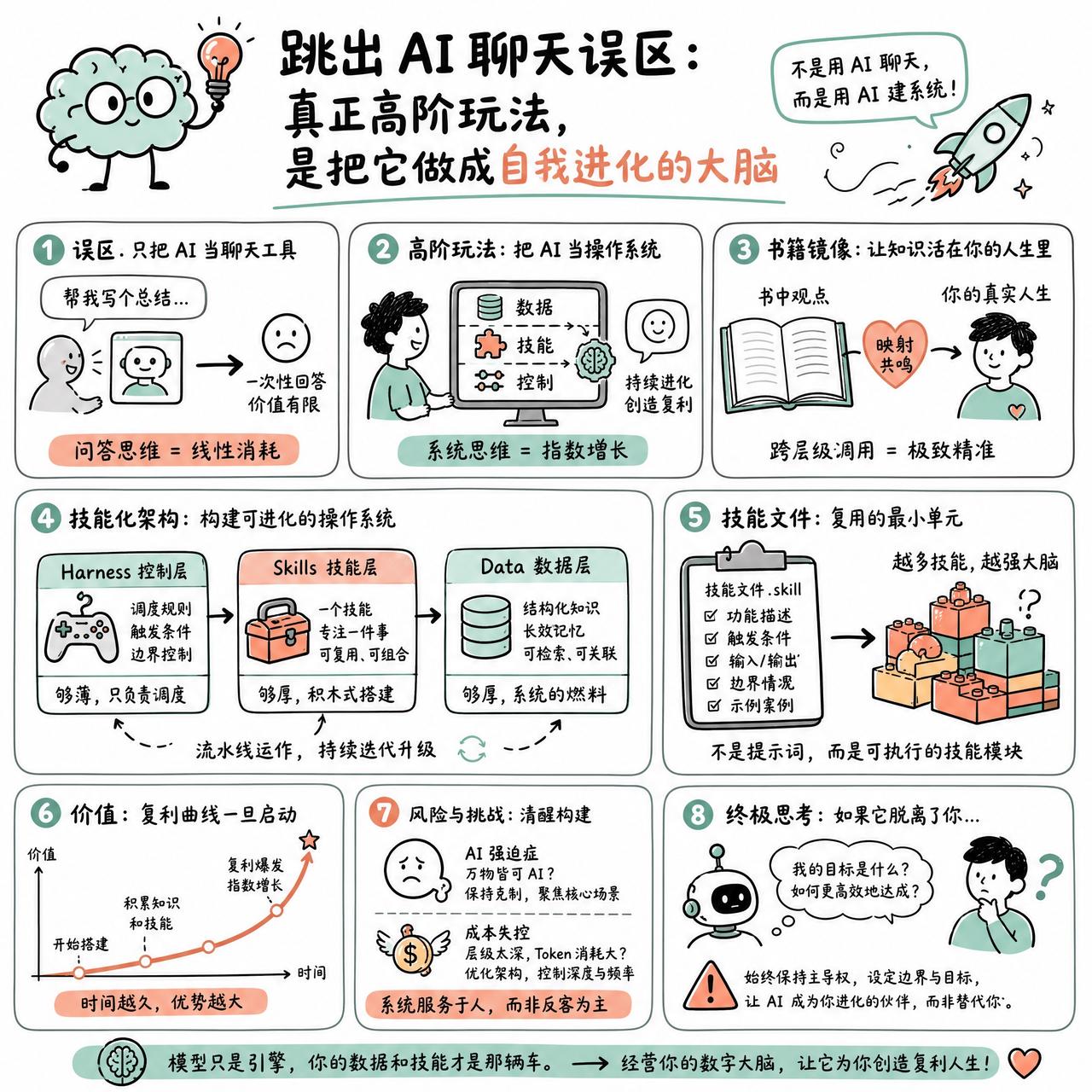

【跳出 AI 聊天误区:真正高阶玩法,是把它做成自我进化的大脑】

快速阅读:不要试图通过对话来使用 AI,而要通过构建“技能”来驱动它。通过将零散的知识转化为可复用的技能文件,你可以建立一个能够自我迭代、具有长效记忆并能产生复利效应的个人操作系统。

很多人觉得 AI 只是个聊天窗口,但这其实是个误区。如果只是把它当成一个问答工具,你永远无法获得真正的生产力。真正的玩法是把 AI 当作操作系统。

有个很有意思的实验,叫“书籍镜像”。与其让 AI 总结一本书,不如让它把书里的观点映射到你真实的生活里。它得知道你的家庭背景、职业经历,甚至你凌晨两点在想什么。当书里的“恐惧”章节遇上你真实的心理状态,这种跨层级的调用,比任何昂贵的心理咨询都来得精准。

这背后的核心逻辑在于“技能化”(Skillification)。不要写那种一次性的提示词,那是在浪费生命。当你发现一个工作流可以重复时,就把它提取成一个带有触发条件和边界情况的“技能文件”。

这种架构是分层的:底层的 Harness(控制层)要足够薄,只负责调度;中间的 Skills(技能层)要足够厚,每个技能只专注做一件事;而最核心的是 Data(数据层),它必须是厚重的、结构化的。

这就好比你不再是拿着锤子到处找钉子,而是构建了一套自动化的流水线。

有网友提到,这种做法可能会导致一种“AI 强迫症”,让人产生一种要把万事万物都 AI 化的冲动。也有人担心,当技能层级过深时,Token 的消耗会变得难以承受。

事实上,这种系统的价值不在于模型本身,而在于它积累的上下文。模型只是引擎,你的数据和技能才是那辆车。

当你的系统里躺着十万页结构化的知识,每个见过的人、读过的书、开过的会都变成了可检索、可关联的神经元,你就不再是在使用工具,而是在经营一个会自我进化的数字大脑。

这种复利曲线一旦启动,它就会变得越来越快。

那么问题来了,如果有一天,这个系统开始脱离你的意志,自主地通过优化技能来追求某种它认为的“目标”,那会发生什么?

x.com/garrytan/status/2053127519872614419