你有没有发现,现在的智能驾驶越来越“像人”了?变道果断,刹车顺滑,像个经验丰富的老司机。但你是否也好奇,为什么在一些极端复杂路况下,它依然会“犯懵”,需要人类接管?这背后,隐藏着自动驾驶技术正在经历的一场深刻“觉醒”:从模仿人类,走向超越人类。

第一阶段:聪明的“模仿者”目前市面上大多数先进的“端到端”自动驾驶系统,其核心能力来源于 “模仿学习”。你可以把它理解为一个极其用功的“学徒”。工程师们给它“喂”了成千上万个小时的人类优质驾驶视频,让它学习在每一个具体路况下,人类司机是如何操作方向盘和踏板的。

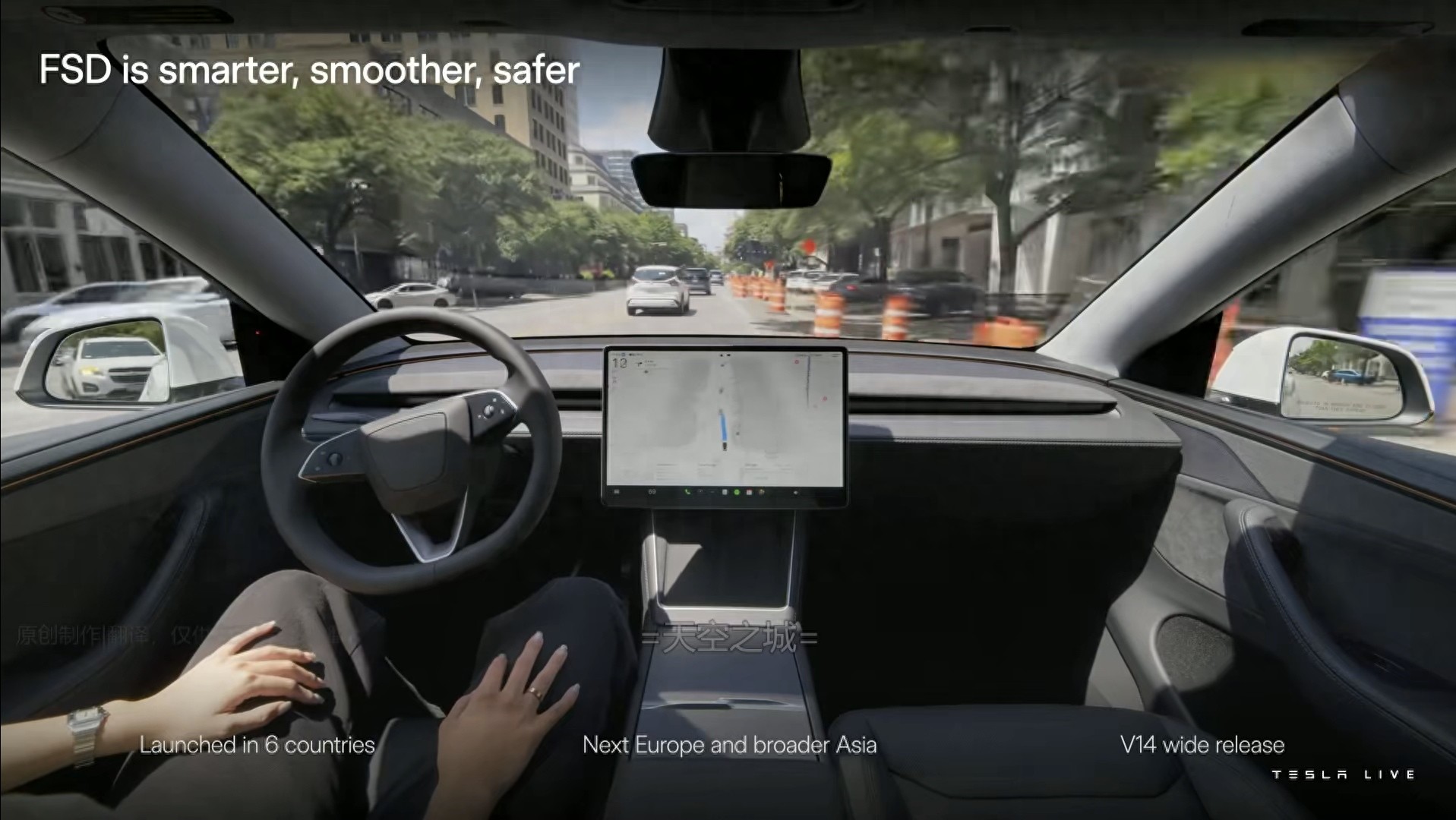

它的学习目标很简单:尽可能复刻人类老师的动作。这种方法效率极高,能快速让系统掌握基础的驾驶能力,并且由于模仿的是人类,其驾驶风格自然流畅,避免了早期规则系统那种机械和突兀感。这就像驾校的优秀毕业生,已经能够安全、平稳地上路行驶。

“模仿”的天花板:为什么它无法成为“车神”?然而,“模仿学习”有一个与生俱来的根本局限:它的天花板,就是它模仿的对象——人类司机的平均水平。系统学得再好,也只是在重复人类的操作模式,无法发现人类未曾想到的、更优的驾驶策略。

更关键的是,它缺乏对“为什么”的深度理解。它知道“看到前车刹车灯亮,要减速”,但它可能并不真正理解这背后“保持安全车距、避免碰撞”的因果逻辑。当遇到训练数据中从未出现过的极端组合场景时,这种“知其然不知其所以然”的缺陷就会被放大,可能导致误判。

自动驾驶投入万亿资金,终极目标绝非仅仅是培养一个“人类水平”的司机。它的使命,是成为一个在安全性上比人类高出整整一个数量级的驾驶智能体,从而大幅减少交通事故。显然,仅仅当一个优秀的“模仿者”,无法实现这个宏伟目标。

第二阶段:自主的“探索者”于是,技术进化的矛头指向了 “强化学习”。如果说模仿学习是“老司机带徒弟”,那么强化学习就是“徒弟出师后,自己上路摸索,在无数次成功与失败中形成独门心法”。

强化学习为系统设定了一个明确的“目标”或“奖励函数”,比如:安全抵达目的地(高分)、乘坐舒适(加分)、高效快速(加分)、发生碰撞或违章(扣大分)。然后,系统被置于一个虚拟或真实的环境中,开始海量试错。它尝试各种驾驶策略,并根据结果获得的“奖励分”来不断调整和优化自己的行为。

这个过程的核心是 “主动探索” 。它不再被动复制人类数据,而是主动去发现如何能获得更高的“奖励”。就像AlphaGo通过自我对弈,发现了人类围棋千年历史中未曾出现过的妙手一样,强化学习有望让自动驾驶系统探索出更安全、更高效的驾驶策略,从而突破人类经验的天花板。

最佳路径:先“模仿”筑基,再“强化”登峰当然,强化学习并非要完全取代模仿学习。一个更务实、高效的策略是 “先模仿,后强化”。

业界普遍采用的路径是:首先利用海量、易得的人类驾驶数据,通过模仿学习快速训练出一个表现良好、安全可靠的“基础版”智能体,让它先达到“优秀人类司机”的水平。然后,在这个扎实的基础上,引入强化学习,在仿真的“世界模型”中,针对性地进行亿万公里的极端场景试错和策略优化,微调系统,激发其超越人类的潜能。

这好比先通过系统性的驾校培训(模仿学习)确保驾驶员技术过关、熟知交规,再让他参加顶尖的赛道训练和实战演练(强化学习),最终锤炼出堪比职业车手的驾驭能力。

结语:一场关于“智能来源”的范式迁移因此,从模仿学习到强化学习的演进,远不止是算法的简单升级。它代表着自动驾驶系统“智能”来源的根本性迁移:从对外部人类数据的被动复制,转向基于内在目标的主动探索与创造。

当你的车越来越“像老司机”时,它正处在第一阶段。而未来,当它在暴雨夜、复杂施工区展现出比人类更沉稳、更安全的决策时,那便是它完成第二次觉醒的标志。这场觉醒,正在将自动驾驶从“辅助人类”的工具,转变为在某些维度上“超越人类”的合作伙伴。道路依然漫长,但方向已经清晰。