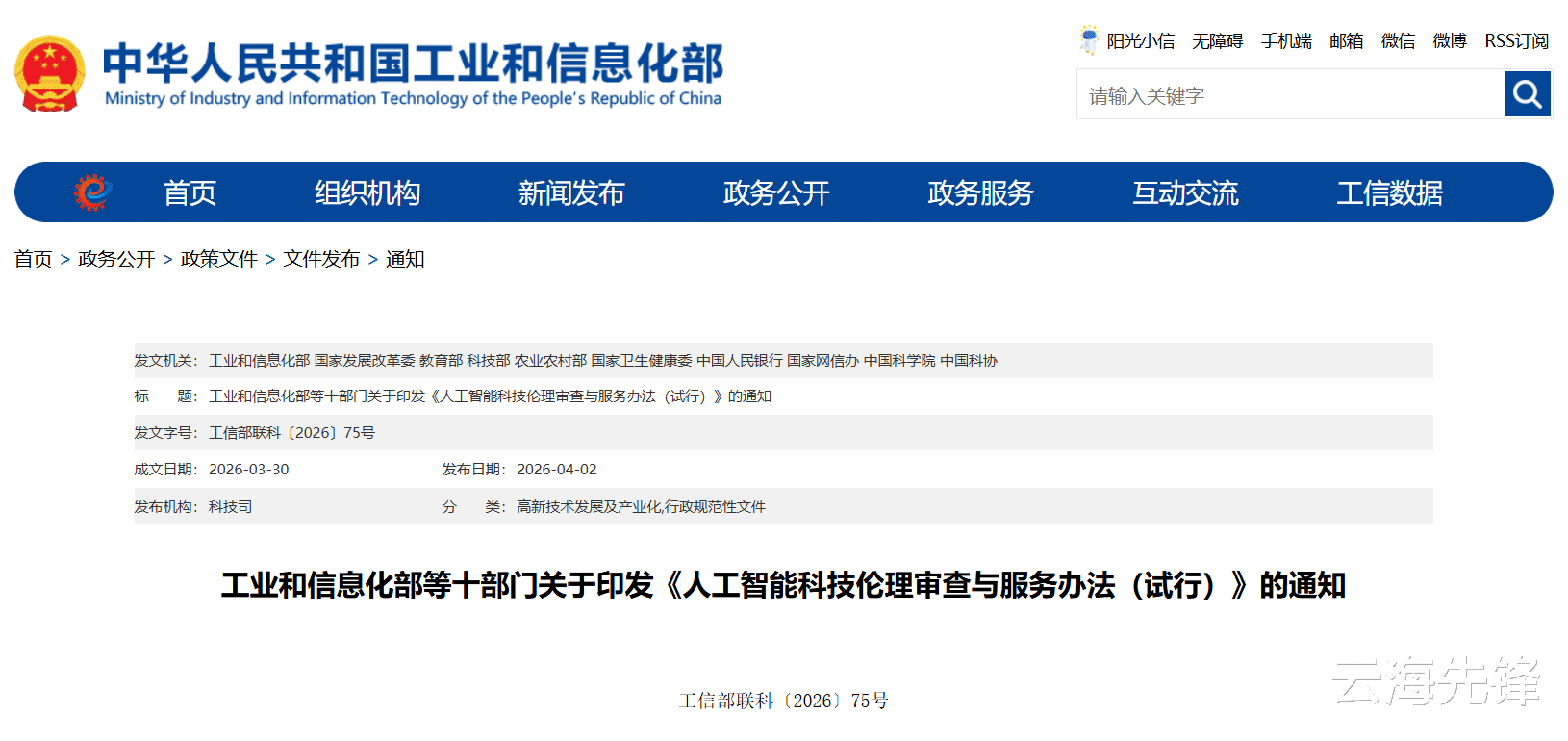

近日,工业和信息化部、国家发展改革委、教育部、科技部、农业农村部、国家卫生健康委、中国人民银行、国家网信办、中国科学院、中国科协等十部门联合印发《人工智能科技伦理审查与服务办法(试行)》(以下简称《办法》)。该《办法》自印发之日起施行,标志着我国人工智能伦理治理进入制度化、规范化新阶段。

《办法》明确适用于中华人民共和国境内开展的人工智能科学研究、技术开发等活动,涵盖可能对人的尊严、公共秩序、生命健康、生态环境、可持续发展等带来伦理风险挑战的场景,以及依法需审查的其他科技活动。其核心是贯穿“增进人类福祉、尊重生命权利、坚持公平公正、合理控制风险、保持公开透明、保护隐私安全、确保可控可信”七大伦理原则,要求将伦理要求融入人工智能科技活动全流程。

《办法》从服务与促进、实施主体、工作程序三方面构建全链条治理框架。在服务端,提出建立人工智能科技伦理标准体系,推动国际、国家、行业、团体标准制定,支持搭建国际交流平台;推进伦理服务体系建设,强化风险监测预警、检测评估、认证咨询等服务,重点支持中小微企业审查能力建设;加强伦理宣传教育与人才培养,鼓励高校、科研机构、企业等开展伦理研究、技术创新及职业体系建设。

在实施主体上,明确从事人工智能活动的单位(高校、科研机构、企业等)为伦理审查责任主体,需设立人工智能科技伦理委员会(以下简称“委员会”),配备专业人员与经费保障独立性。委员会需包含技术、伦理、法律等多领域专家,章程与职责参照《科技伦理审查办法(试行)》(以下简称《伦理办法》)执行。地方或主管部门可依托单位建立专业性伦理审查与服务中心(以下简称“服务中心”),提供委托审查、复核、培训等服务,但不得对同一活动同时提供审查与复核。

《办法》将审查程序分为一般程序、简易程序、专家复核程序和应急程序,实现风险分级响应。一般程序要求委员会或服务中心在受理后30日内作出决定,审查会议需5名以上委员(含不同专业背景),重点评估人类福祉、公平公正、可控可信、透明可解释、责任可追溯、隐私保护六大维度。简易程序适用于低风险活动(如常规风险、小幅修改、跟踪审查),由2名以上委员审查,若出现否定意见或争议则转为一般程序。专家复核程序针对高风险活动,由工信部、科技部动态调整“复核清单”(包括人机融合系统、舆论引导算法、高危场景自动化决策系统等三类),通过初步审查后需申请专家复核,跟踪审查间隔不超过6个月。应急程序明确突发公共事件下72小时内完成审查(含复核前36小时),保障紧急状态下的伦理合规。

《办法》明确科技部统筹全国科技伦理监管,工信部会同有关部门负责人工智能伦理治理,各部门按职责监管本行业系统,地方负责本地区监管。单位需通过国家科技伦理管理信息登记平台登记委员会情况、复核清单活动进展及年度报告;服务中心需登记并提交年度工作报告。违规行为将依照《网络安全法》《数据安全法》等法律法规调查处理。此外,《办法》允许地方、主管部门及科技类社会团体结合实际制定细则,特殊规定符合办法精神的从其规定,未作规定的参照《伦理办法》执行。