2026年1月拉斯维加斯CES现场,身着标志性黑色皮衣的英伟达CEO黄仁勋掷地有声:“这一次,我们打破了自己的规则。”下一代AI计算平台Vera Rubin携六颗全新架构芯片亮相,震惊全场。马斯克感慨“这是给AI装火箭引擎”,这场颠覆性发布让全球科技圈沸腾。究竟是什么技术突破引发震动?英伟达“自杀式”革新背后,又藏着怎样的生存焦虑?

在过去的二十年里,英伟达遵循着一种近乎钟表般精准的迭代节奏:每代产品架构通常只更新一到两颗核心芯片,其余部分则沿用旧架构进行微调。这种策略既稳健又能最大化商业利益。

然而,在2026年,黄仁勋亲手终结了这个传统。Vera Rubin平台的发布,意味着从CPU、GPU到网络交换芯片、DPU等六大核心组件,全部进行了推倒重来的底层设计。

我们先来看看这套被命名为“Vera Rubin”的系统到底强在哪里。从数据层面看,Rubin GPU的晶体管数量虽然仅比上一代Blackwell增加了1.6倍,达到了3360亿颗,但其AI推理性能却暴涨了5倍。

英伟达这次采用了一种“极端协同设计”的思路。比如,他们引入了全新的NVFP4精度格式,这不仅仅是数据位宽的压缩,而是配合硬件层面的自适应精度调节。

简单来说,芯片变得更“懂”模型了,它知道在处理Transformer架构的不同层级时,哪里需要高精度,哪里可以模糊处理,从而在不牺牲智能水平的前提下,大幅提升计算效率。

更关键的突破在于解决了“木桶效应”。在AI集群中,GPU往往跑得太快,而内存和网络传输却成了拖后腿的短板。

Vera Rubin平台中,英伟达不仅自研了拥有88个核心的Vera CPU来提升数据吞吐,还搞出了Spectrum-X以太网交换芯片,将硅光子技术直接封装在芯片内部。

这意味着数据在服务器之间的传输不再受限于传统铜缆的物理瓶颈,整套系统的互联带宽达到了惊人的260TB/s。对于像GPT-5、GPT-6这样参数量级的大模型训练来说,这种系统级的优化比单纯提升单卡算力要重要得多。

这套系统目前已经全面投产,预计2026年下半年就能在微软、OpenAI的数据中心里看到它们的身影。

对于行业而言,这不仅是一次产品的更新换代,更像是一次算力成本的洗牌,AI推理的Token成本直接降到了原来的十分之一。这对于那些还在为高昂算力成本发愁的AI应用公司来说,无疑是最大的利好。

从“屏幕里的嘴炮”到“现实世界的行者”如果说算力的提升是“硬菜”,那么黄仁勋提出的“物理AI”概念就是这次发布会的“灵魂”。

长久以来,我们熟悉的AI——无论是ChatGPT还是各种文生图模型,它们本质上都生活在数字屏幕里。它们缺乏对物理世界“基准真相”的认知。

CES现场,黄仁勋展示了英伟达在这一领域的突破性进展——Alpamayo自动驾驶生态。这不仅仅是一个辅助驾驶系统,而是一个拥有100亿参数、具备“思维链”推理能力的视觉-语言-动作模型(VLA)。

演示视频中,一辆搭载该系统的奔驰CLA在旧金山复杂的城市道路上行驶。它没有依赖预先绘制的高精地图,而是完全像人类司机一样,通过视觉实时判断路况。

这里有一个细节极具震撼力:车辆在行驶中遇到了一个正在施工的围挡,旁边还有行人。系统后台的思维链实时显示了它的“心理活动”——“前方有施工,道路变窄,右侧有行人可能突然移动,我需要减速并向左轻微借道,同时准备随时刹车。”

这种具备因果推理能力的驾驶方式,与过去那种靠死记硬背规则的自动驾驶有着本质区别。它不再是机械地执行“红灯停绿灯行”,而是在理解“为什么”要这么做。

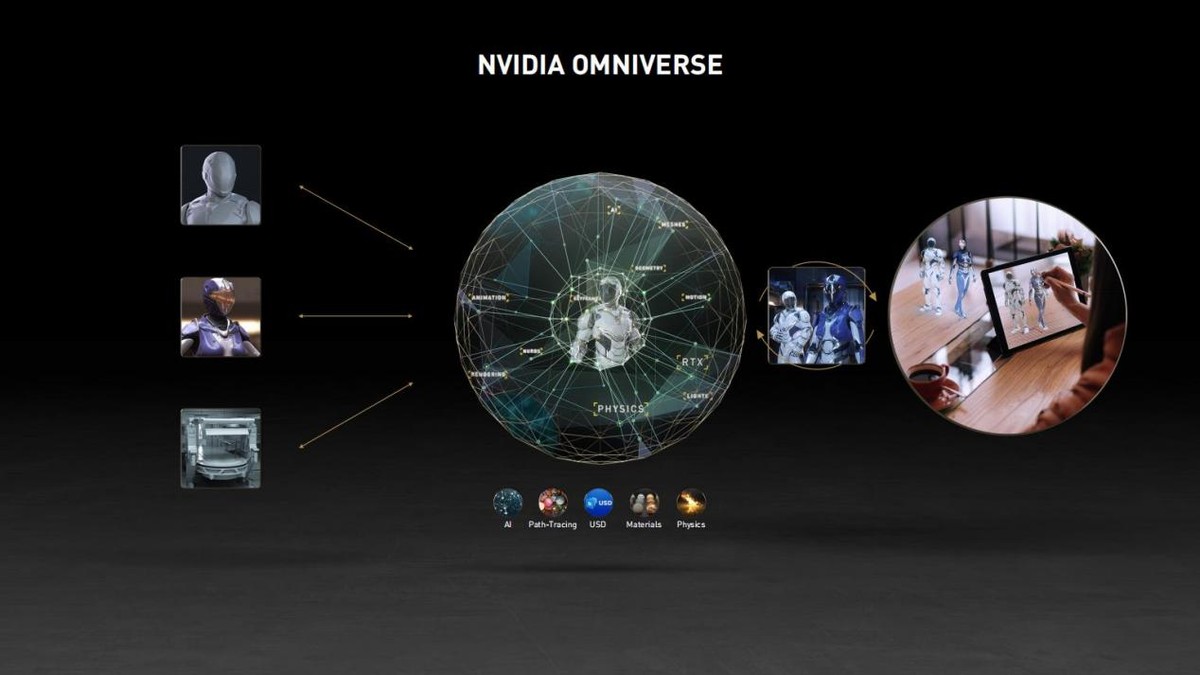

为了训练这种能理解物理规律的AI,英伟达构建了一个庞大的虚拟仿真世界——Omniverse。在这里,英伟达利用Cosmos世界模型生成了海量的合成数据。这些数据严格遵循物理定律,重力、摩擦力、流体力学都在其中得到了完美复刻。

发布会舞台上那两个步履矫健的BDX机器人,就是这种训练模式的产物。它们在虚拟世界中经历了数亿次的行走、跌倒、爬起,最终将学到的技能部署到物理实体上。

这标志着AI正式从处理信息的工具,进化为能够操控物理实体的智能体。黄仁勋形象地称之为“物理AI的ChatGPT时刻”,这意味着机器人产业将迎来类似大模型爆发那样的指数级增长。

在被围剿前自我重构外界看英伟达是风光无限的万亿市值巨头,但在黄仁勋眼里,公司始终处于“距离倒闭只有30天”的危机之中。这种焦虑并非空穴来风,而是基于对行业格局的深刻洞察。

我们先看外部环境。曾经的大客户谷歌、微软、亚马逊,如今都成了最危险的竞争对手。这些科技巨头拥有海量的数据和应用场景,他们越来越倾向于自研芯片来替代昂贵的英伟达GPU。

2025年底,市场曾传出Meta计划大规模采用谷歌TPU芯片的消息,直接导致英伟达股价单日暴跌8%,数千亿美元市值瞬间蒸发。

这给黄仁勋敲响了警钟:如果英伟达只能提供通用的算力芯片,那么在巨头们的垂直整合策略面前,护城河迟早会被填平。

再看技术趋势。AI模型的参数量每年增长10倍,而摩尔定律带来的硬件性能提升每年只有不到2倍。这种“剪刀差”意味着,如果芯片厂商按部就班地迭代,很快就会成为AI发展的瓶颈。一旦算力供给跟不上需求,客户就会被迫寻找替代方案,或者彻底转向新的计算架构。

正是在这种内忧外患的背景下,黄仁勋选择了“孤注一掷”。他在2025年圣诞节前夕,以200亿美元的天价收购了AI芯片独角兽Groq,这笔交易的溢价之高令人咋舌。

但他看重的不仅仅是Groq的LPU(语言处理单元)技术,更是为了快速整合其在低延迟推理方面的优势,补齐英伟达在推理侧的短板。

这次一口气发布6颗芯片,实际上是英伟达构建新护城河的战略举措。

通过Vera Rubin平台,他将芯片、网络、存储、算法库、仿真平台打包成一个紧密耦合的生态系统。客户如果想获得极致的性能,就必须全套采用英伟达的方案。

这种“全栈式”的打法,极大地提高了竞争对手的准入门槛。你想替代我?那你不仅要造出比我快的GPU,还得造出比我好的CPU、交换机、DPU,以及配套的软件生态。这在短期内几乎是不可能完成的任务。

AI时代的“造富”与“淘汰”Vera Rubin平台的问世,将对整个AI产业链产生深远的影响,一场关于算力与应用的双向革命正在加速到来。

对于头部玩家而言,这是一个强者恒强的时代。拥有Vera Rubin这种顶级算力基础设施的公司,能够以更低的成本、更快的速度训练出更强大的模型。OpenAI、谷歌、Meta等巨头之间的竞赛将进一步升级,万亿参数模型将成为常态,通用人工智能(AGI)的到来可能会比预期更早。

但对于中小企业和创业公司来说,门槛被无形中拔高了。当算力基础设施变得如此复杂和昂贵,单纯靠微调模型或做简单套壳应用的生存空间将被极度压缩。

我们还要关注到中国科技产业在这场变革中的位置。面对英伟达的技术封锁和性能飞跃,中国企业面临的挑战是客观存在的。

但这同时也倒逼出了两条清晰的发展路径:一是华为昇腾、寒武纪等国产芯片厂商必须加速追赶,在硬件架构上寻找差异化的突破口;二是利用中国庞大的制造业基础和丰富的数据场景,在“物理AI”的应用侧抢占先机。

比如比亚迪等车企建立的AI训练集群,以及各类人形机器人公司的快速迭代,都显示出中国在应用落地方面的强大爆发力。

说到底,2026年的这场CES发布会,不仅是黄仁勋个人的高光时刻,更是AI行业从“追求算力规模”向“追求场景落地”转折的标志。

评论列表