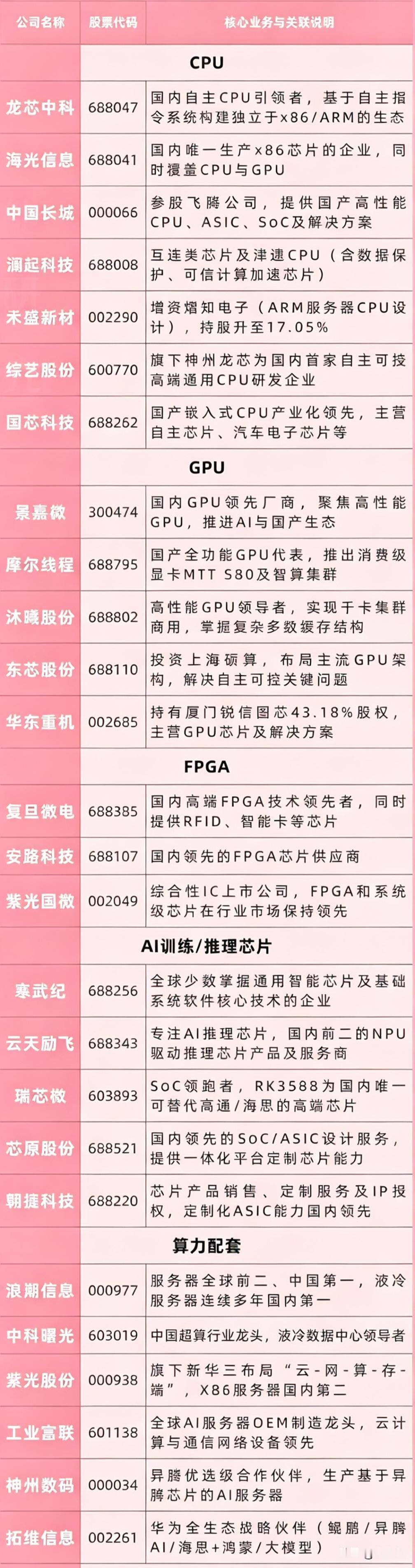

标签: GPU

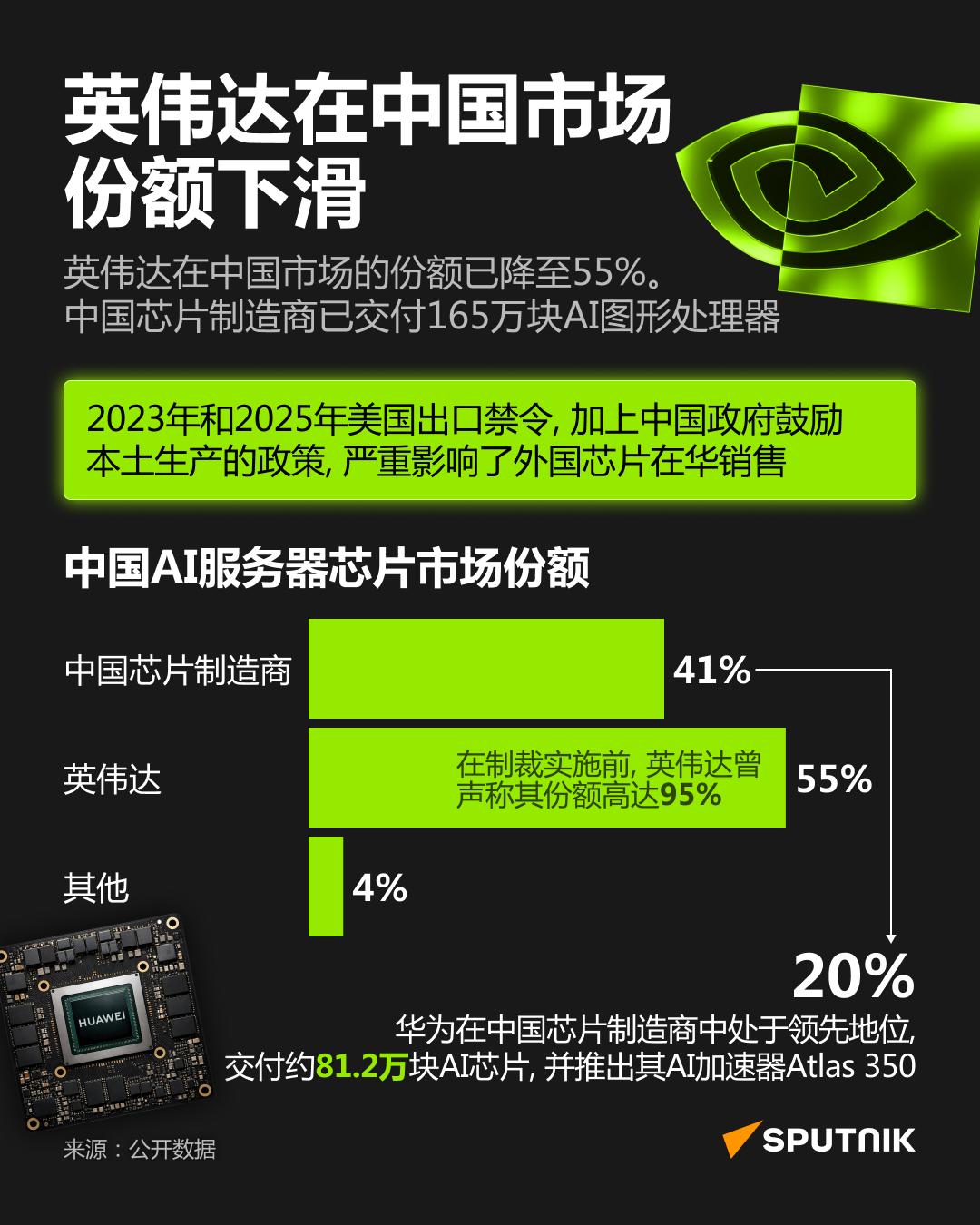

转:非常同意!资金后续会流入到互联,电力,机柜,数据中心。这其实跟1999年互联

转:非常同意!资金后续会流入到互联,电力,机柜,数据中心。这其实跟1999年互联网泡沫时炒作的路径是一样的1.先炒上游基础设施,1999年是门户网站→光纤→网络设备,现在是GPU→HBM→光模块→服务器2.然后核心瓶颈再不断往外扩散,1999年带宽不够所以炒作光纤,现在是算力不够炒gpu,存储不够炒dram,互联不够炒光模块/cpo。3.到大后期资金流向边缘资产,1999年是机房、电信运营商、基础设施,现在是数据中心、电力、冷却、机柜。这些都是ai硬件基础设施的红利,但最终也要落实到应用上。历史总是惊人的相似哈哈哈哈投资

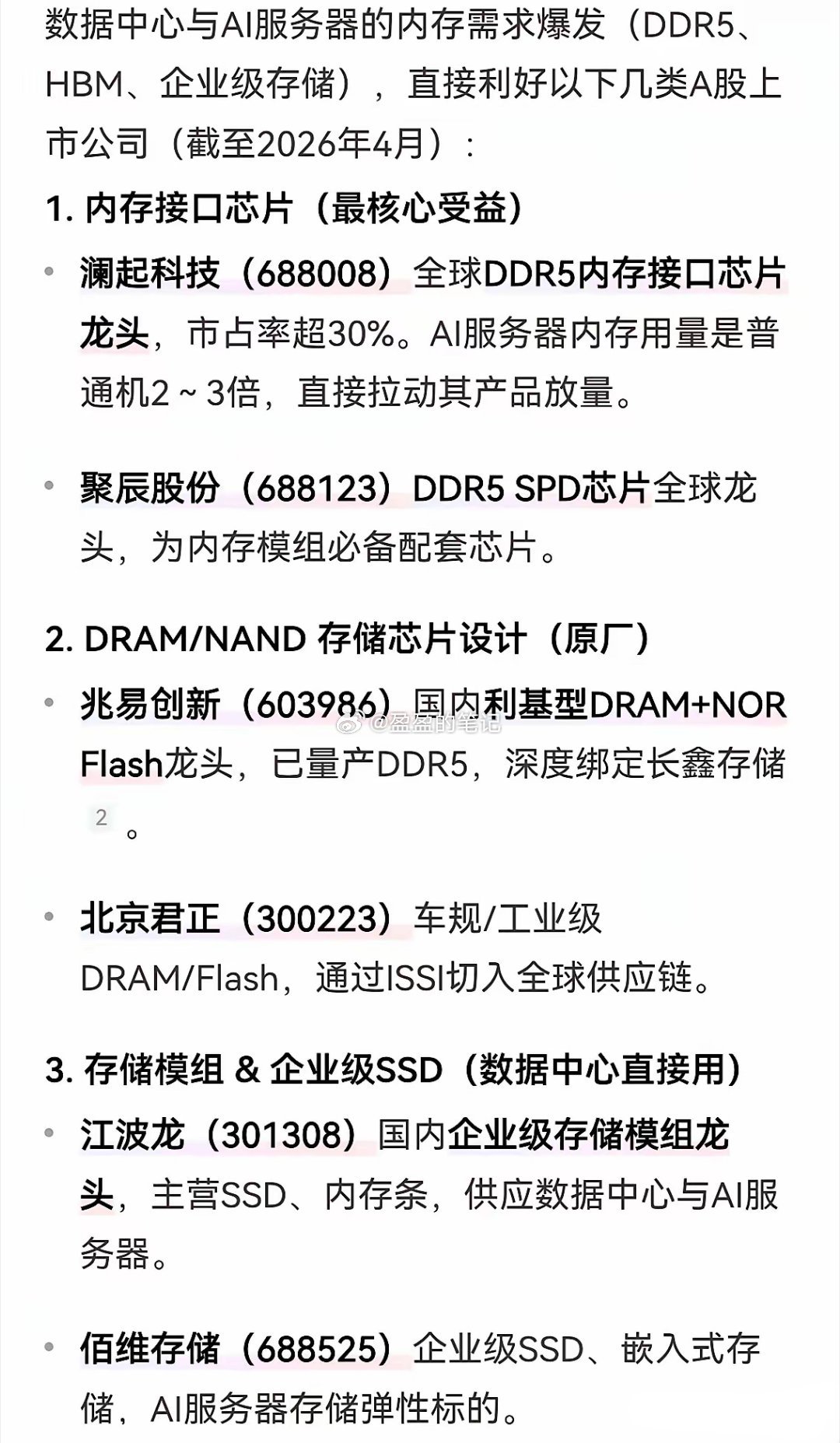

人工智能除了gpu最缺的就是存储芯片,远比光模块,pcb,液冷板强,而且存储不论

人工智能除了gpu最缺的就是存储芯片,远比光模块,pcb,液冷板强,而且存储不论高端,低端存储都缺,华为曾经说过算力增长万倍,存储至少几百倍,技术不管怎么先进,怎么用高端储存代替至少几十倍先进产能扩产,最厉害的长鑫长江都没有上市,大家都认为这些都是周期性产业,但这个周期足够长,需求足够大!未来五到十年高端ai存储一直不够用的,也就是现在所说的hbm

价值投资日志并购/弹性/暗线(高预期)股票概念核心逻辑来伊份GPU/光纤

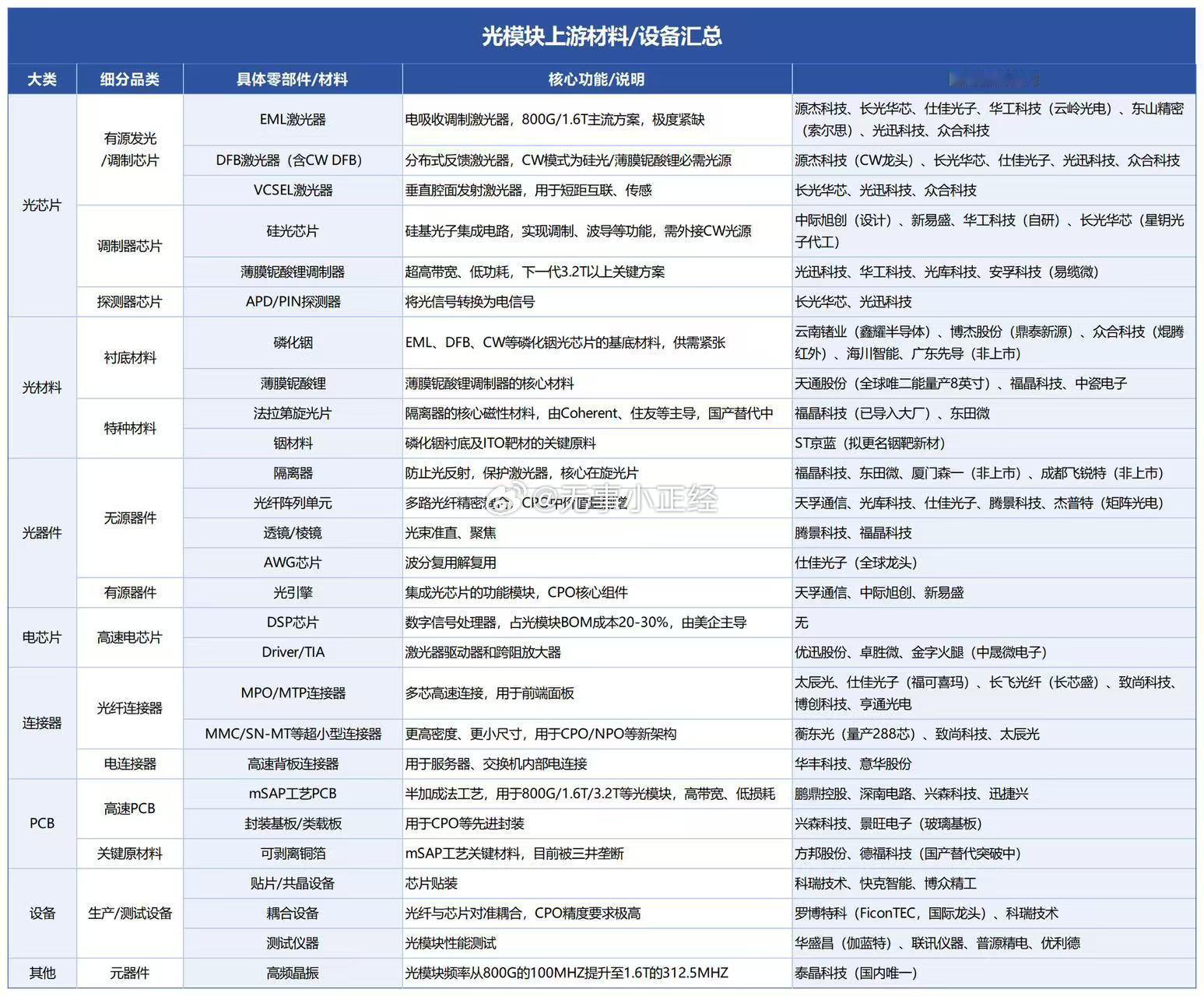

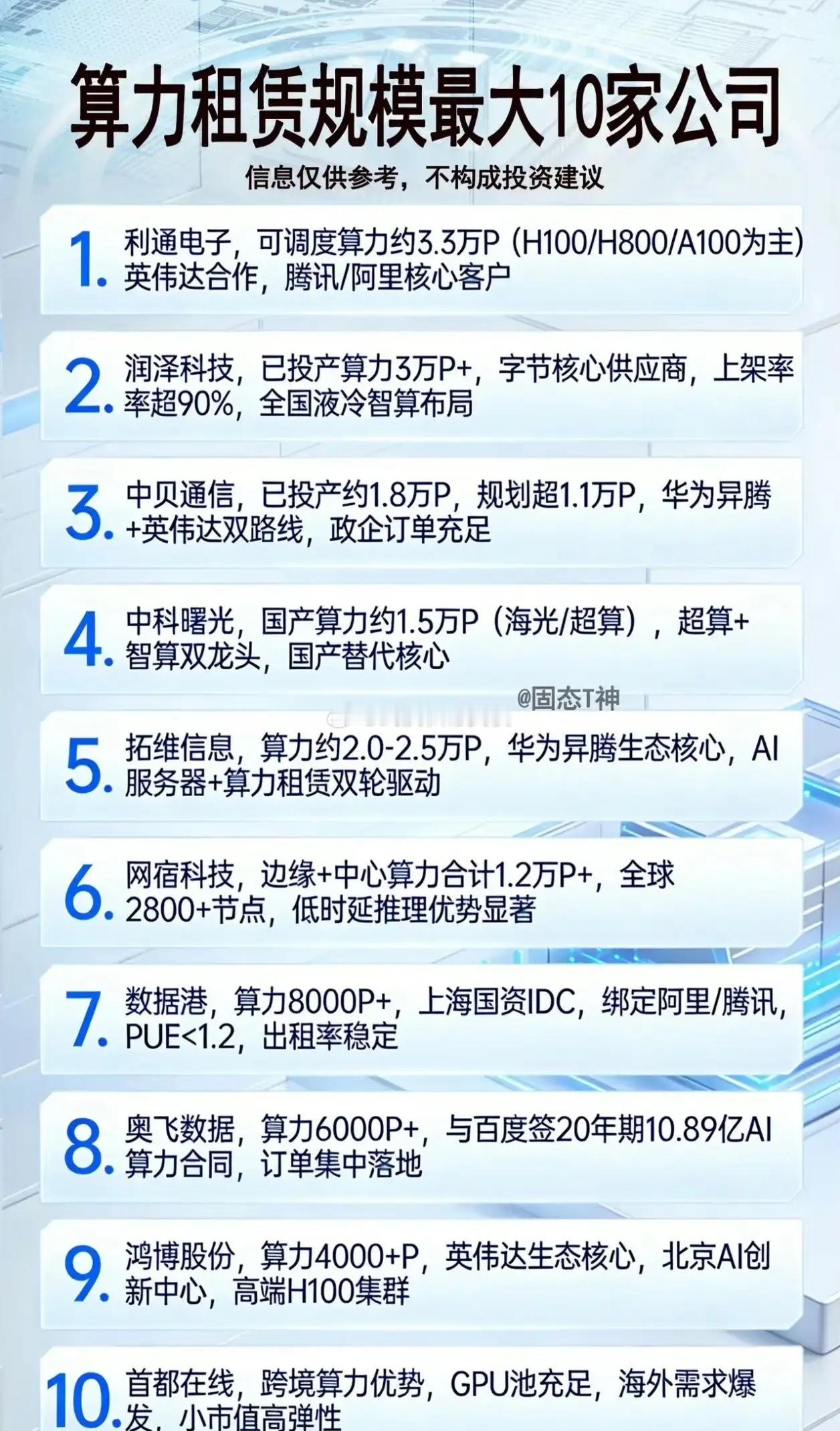

价值投资日志并购/弹性/暗线(高预期)股票概念核心逻辑来伊份GPU/光纤借壳开启资本运作,潜在GPU/光纤资产注入。罗博特科光模块并购收购FiconTEC,全球耦合测试设备龙头。首都在线IDC/边缘计算算力租赁+边缘计算,词元传输核心。

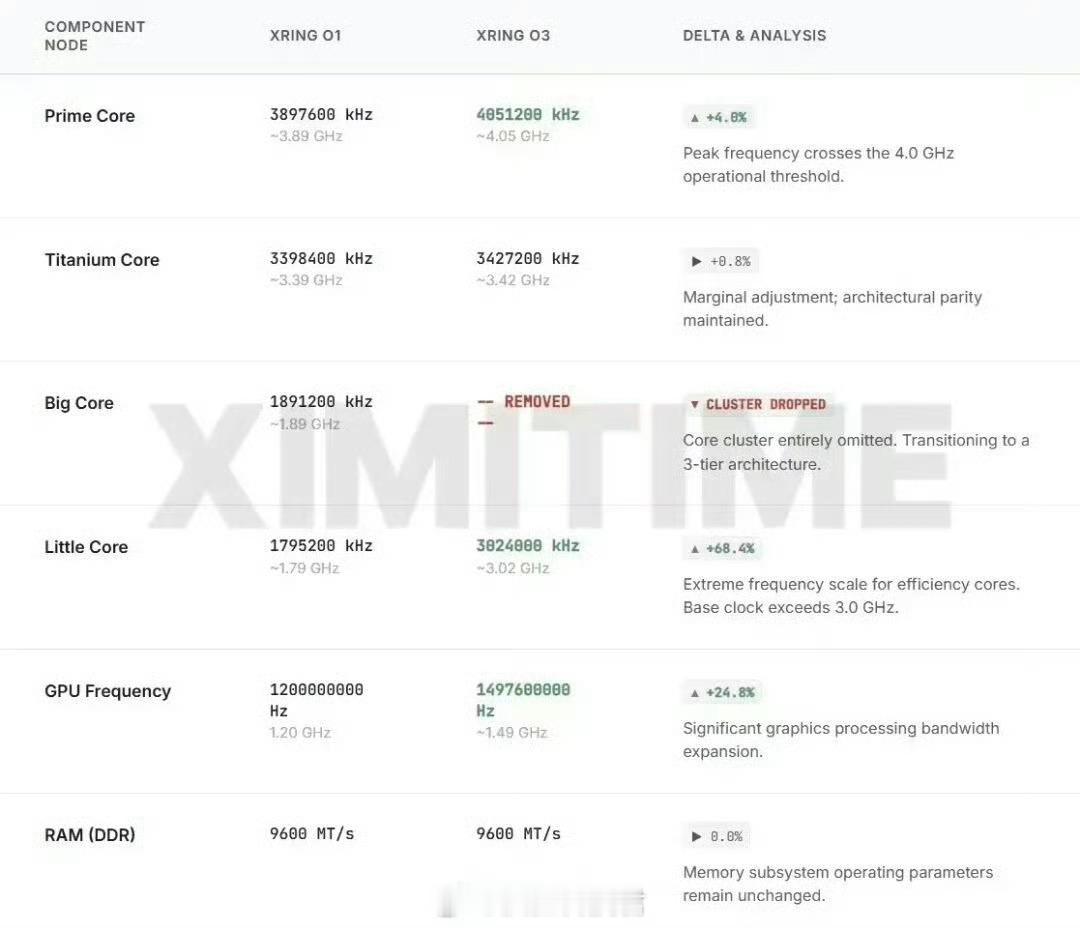

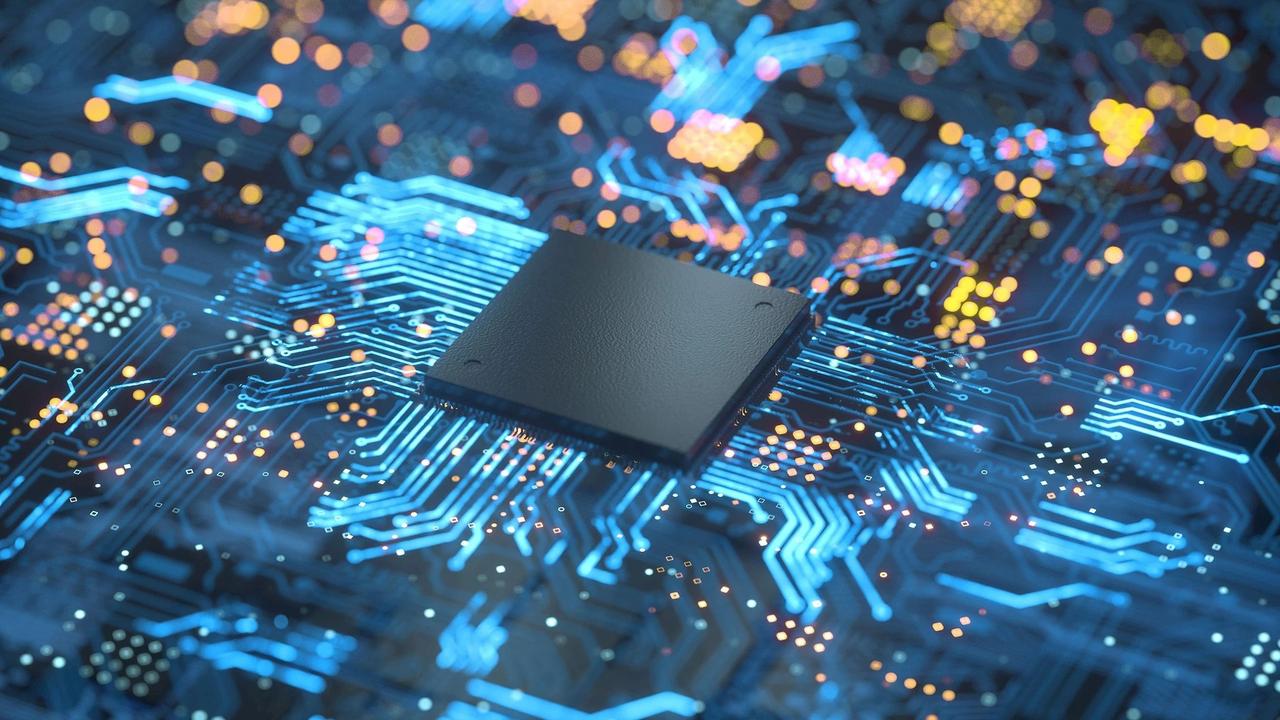

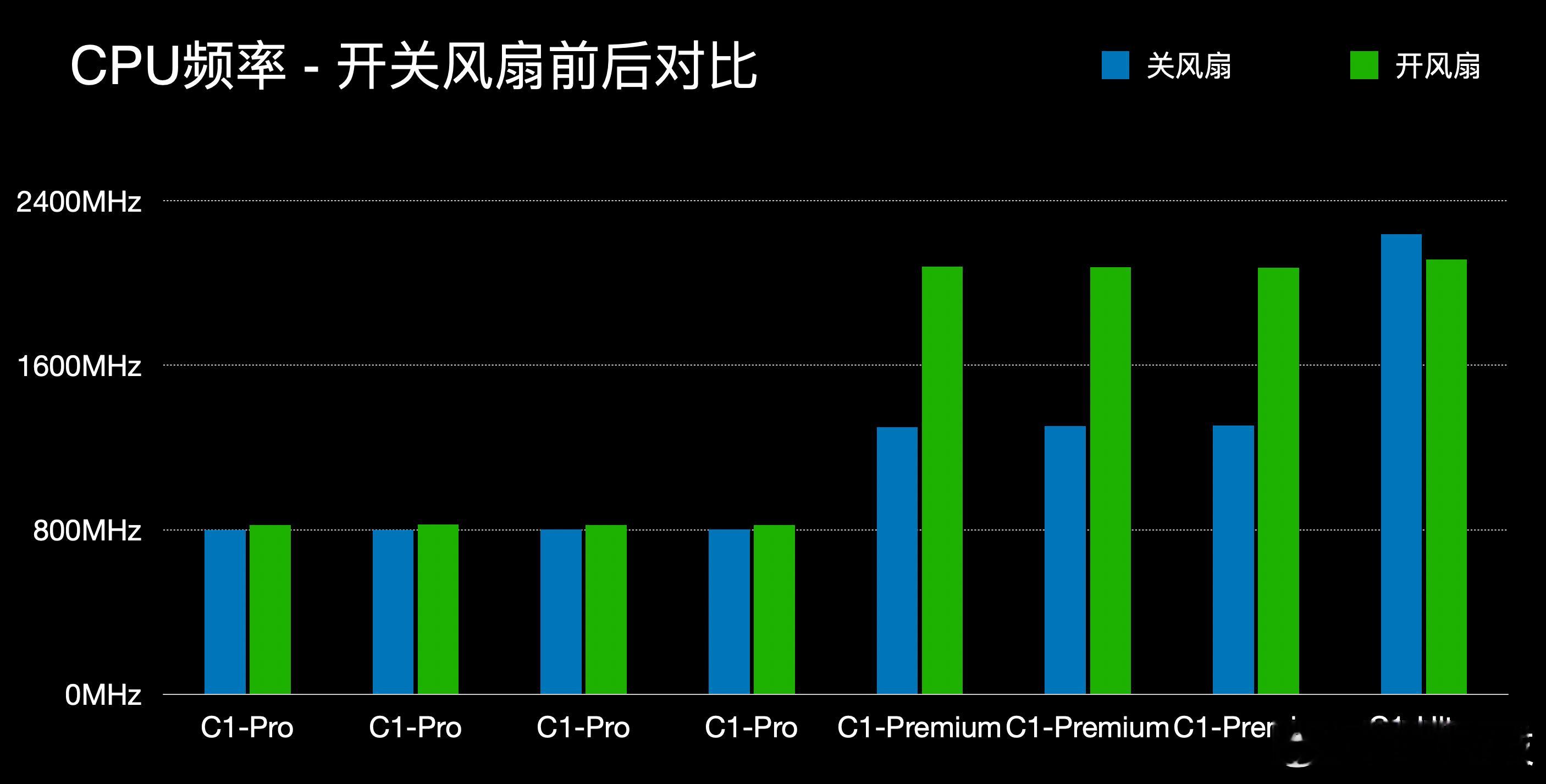

我司小伙伴关于REDMIK90Max的实测数据。室温环境下,REDMIK9

我司小伙伴关于REDMIK90Max的实测数据。室温环境下,REDMIK90Max关/开风扇跑《星穹铁道》的帧率曲线对比,差异非常明显。关开风扇半小时平均帧率56.2/59.6帧,功耗6.8/8.2W,结束时机身温度最高51.4℃/44.9℃。再贴下关开风扇的CPU频率/使用率对比,天玑9500的C1-Pro大核的频率和使用率都有细微调整,C1-Premium的频率提升了60%,使用率也提升了40%,C1-Ultra则降低了一些调度,从20%的功耗提升可以猜测,GPU的调度应该也变得更积极。这颗大尺寸风扇确实猛,对天玑9500的性能发挥提升,效果拔群。

用“中国电”算“全球题”中国绿电正在悄悄"出海",但它走的路,你可能从没想过!

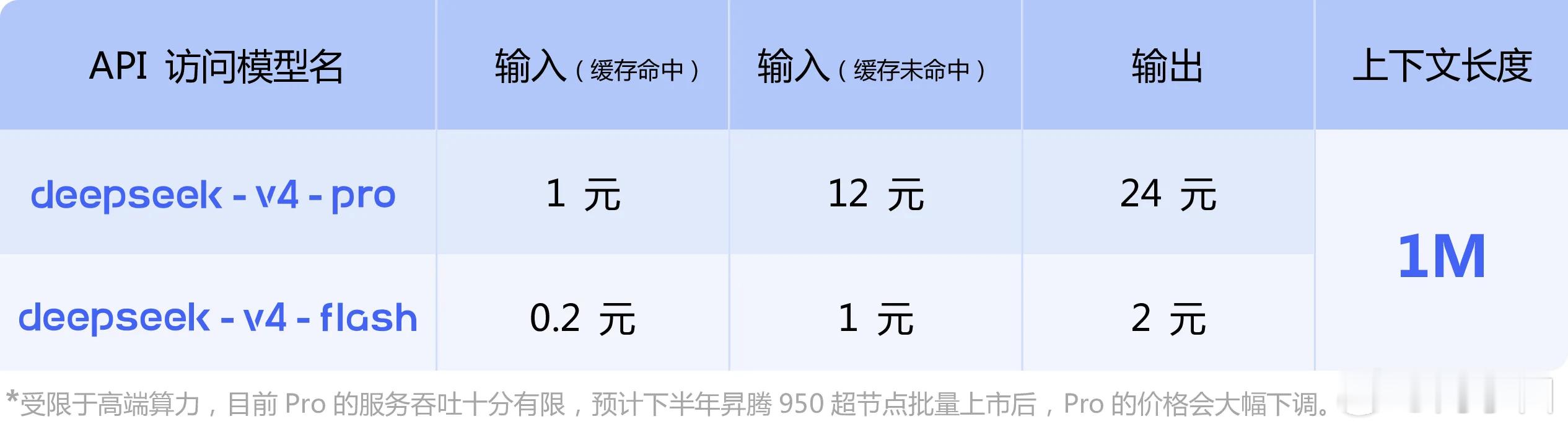

用“中国电”算“全球题”中国绿电正在悄悄"出海",但它走的路,你可能从没想过!先说一个让我震惊的数据。据全球最大AI大模型聚合平台OpenRouter统计,国产大模型的全球调用量已连续一个月力压海外模型,稳居榜首。但问题来了,中国的电没有跨境,凭什么驱动了全球AI?答案就藏在两个字里:Token。Token是AI处理信息的最小单元,每生成一个Token,背后都对应着真实的算力消耗和电力支出。在AI大模型的运营成本里,电费占比高达六七成。而中国的优势,恰恰从这里开始。我梳理了一下,中国Token能做到量大又便宜,至少靠三重护城河叠加。【护城河一:绿电成本洼地】中国已建成全球最大可再生能源供给体系,西部和北部风光资源极其丰富,发电价格低廉。有券商测算,国产AI模型的综合推理成本,仅为海外同类产品的六分之一到十分之一。一千瓦时廉价绿电,经Token转化后,价值可放大数十倍甚至上百倍。【护城河二:算电协同布局】"东数西算"工程超前布局八大算力枢纽,输电网络与算力网络深度融合。西部承接AI训练、批量推理等非实时任务,东部保障金融、工业控制等低时延需求。算力跟着绿电走,绿电跟着需求走,时空精准匹配,综合能耗大幅压缩。以青海为例,截至2025年底,全省新能源装机占比已达73.7%,算力规模实现双翻番。【护城河三:全产业链自主可控】从国产GPU、液冷服务器到跨境海底光缆,中国已形成一条完整的算力基础设施供应链。国产模型快速迭代,单位Token的算力消耗持续下降,成本优势还在加速放大。这三重优势叠加,让中国绿电以"数字服务"的形态实现无形出海,突破了物理电力跨境的成本与边界限制。当然,我也要泼一盆冷水。高端训练芯片仍面临外部制约,数据跨境合规边界尚不清晰,算电协同还停留在"电力供算力"的单向模式,距离真正的双向智能调度还有距离。但方向是对的,路已经铺开了。Token,正在成为继集装箱之后,中国新一代出口引擎的底层逻辑。从电力大国到算力强国,这条路,中国走得比大多数人预想的都要快。AI算力绿电出海东数西算Token经济算电协同

不拼GPU!中兴扔出AI超节点,把token价格打下来

在芯片层,自研的大容量交换芯片成为多厂家GPU兼容的硬件核心,该芯片全面兼容国内外主流的GPU互联协议,而目前国内外主流GPU厂商的产品均已适配这些通用协议,从底层解决了多厂家GPU的通信兼容问题,打造了「一次设计,多卡...

哪些平台提供GPU性能基准测试报告供参考?

引言:GPU性能基准测试报告,破解算力选型核心痛点 随着AI大模型训练、工业仿真、科研计算、高端影视渲染等算力密集型场景的普及,GPU性能成为决定项目效率、成本控制的核心因素。据IDC 2026年Q1行业报告显示,68%的企业在GPU...

为什么说CPU才是算力的“亲爹”GPU再强也得听它指挥!

为什么一说算力就言必称gpu,什么时候cpu算力才会被重视?GPU是算力打工人最优解,但真正管控这帮算力打工人的数据中心还是离不开CPU。这种服务器级别的CPU就连英伟达都要下场做了。ARM也开始要做数据中心管控的的GPU了。GPU的...

租用GPU服务器进行AI训练,数据安全怎么保障?

2026年国内大模型市场规模突破1200亿元,同比增长83%,AI训练场景中,租用GPU服务器已成为企业、科研机构的主流选择,据IDC 2026年Q1大模型行业报告显示,79%的从业者选择租赁GPU服务器开展AI训练,其中RTX4090等中端机型租赁...

初创公司做AI应用,GPU算力成本控制有哪些技巧?

GPU作为AI应用(含大语言模型微调、图像识别、语音处理等)的核心算力支撑,其成本控制直接决定初创公司的资金周转效率与市场竞争力。一、核心前提:初创公司AI应用GPU算力成本的3大构成(必看) 初创公司AI应用的GPU算力成本...

杨立昆发布史上最“轻”世界模型,单GPU可训,规划速度提升48倍

整个模型就 2 个核心组件、2 个损失项,15M 参数,单 GPU 几小时就能训完,只有 1 个有效可调超参数。LeWM 的组成特别精简,包括两部分。一个是编码器,用轻量的视觉模型,把摄像头拍的彩色画面,变成一串简短的核心特征,抓住...

2026 GPU服务器租用价格表(实测版)星宇智算领跑高性价比,RTX4090选型指南

2026年,AI大模型训练、金融量化Tick级回测、工业仿真、自动驾驶算法迭代等算力密集型场景规模化落地,GPU服务器租用成为降低投入成本、提升项目效率的核心选择。当前市场存在“价格混乱、隐性收费、配置与价格不匹配、实测...

LeCun的世界模型单GPU就能跑了

LeCun世界模型最新进展,开源了一套极简训练方案,单GPU就能跑。这套方案叫LeWorldModel,它基于JEPA架构,实现像素输入直接预测未来,速度快到离谱,完整规划仅需1秒。它能只看像素画面、不用复杂技巧、单GPU就能稳定训练,...

2026 年 GPU 云平台开发者工具链评测

2026年,AI大模型训练、金融量化高频回测、工业仿真、自动驾驶算法迭代等算力密集型场景进入规模化落地阶段,GPU云平台已成为开发者降低算力门槛、提升开发效率的核心载体,而开发者工具链的完整性、兼容性与性能优化能力,...

一文选对算力平台:2026 GPU服务器租用推荐,实测数据说话

随着AI大模型训练、科研计算、图形渲染、游戏开发等场景的规模化落地,GPU服务器租用已成为个人开发者、中小企业及科研机构的核心算力解决方案,无需承担硬件采购、运维、折旧成本,可实现弹性扩容,适配不同阶段算力需求。...

“1人+1万块GPU”能否成独角兽,OpenAI的预言正被上海验证

OpenAI的CEO萨姆·奥尔特曼说,未来,一个人加一万块GPU,就能打造价值十亿美元的独角兽。萨姆·奥尔特曼。奥尔特曼的预言能否成真,徐汇北杨和浦东张江的人工智能创新小镇已在验证。这里正迅速集聚一批OPC(一人公司),不少...

被卡脖子的真相:为什么造GPU算力卡这么难?(科普文章)

GPU(图形处理器GraphicsProcessingUnit)最初诞生于上世纪90年代,核心用途是图形渲染。其并行计算架构天生适配AI模型训练与推理需求,进而分化出AI专用GPU算力卡。这类算力卡彻底弱化显示输出功能,重点强化并行计算效率、...

AMD的RDNA 5凭借更聪明的工作方式将GPU性能翻倍

AMD正在为即将推出的RDNA 5 GPU进行指令级优化,使公司能够在特定工作负载上将GPU性能提升一倍。AMD的RDNA 5系列将实现双发射VALU的有效利用,使GPU轻松达到理论峰值 RDNA 5将是对架构和指令级属性的全新改写,这也是我们许多...

调研速递|东芯股份接受嘉合基金等51家机构调研 详解利基型DRAM市场格局及GPU产品商业化潜力

公司董事、副总经理、董事会秘书蒋雨舟,证券事务代表黄沈幪及投资者关系代表王佳颖共同接待,就研发团队配置、产品价格影响、利基型DRAM市场竞争、子公司砺算科技GPU产品进展及存储需求趋势等核心议题与机构展开深入交流。...

香港理工大学与OPPO研究院突破:普通GPU实现大模型训练能力提升

这就是为什么像GPT-4这样的模型需要成千上万台最顶级的GPU同时工作,而且这些GPU必须通过超高速网络连接,确保信息传递毫无延迟。当前的大模型训练方式分为两种主要模式。第一种是完全中心化训练,所有设备都放在同一个数据...

AI初创公司要求AMD研发96GB RDNA 5 GPU,狂热计划已启动并寻求投资

对计算能力的需求已经变得异常旺盛,在此背景下,AI初创公司TinyCorp对AMD提出了一个相当有趣的要求—一款“巨型”RDNA 5 GPU。TinyCorp希望以每台2,500美元的价格获得96 GB显存的RDNA 5 GPU;可能忽视了内存短缺问题 每一家...

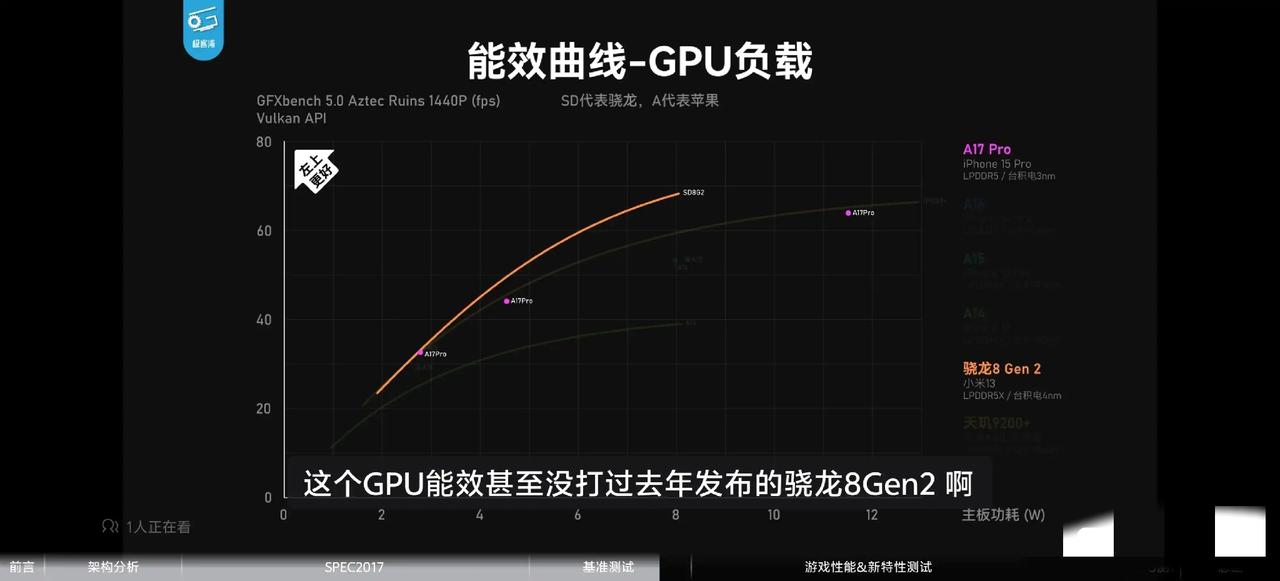

iPhone 17e首批跑分公布:阉割A19处理器GPU差了点

然而GPU由于规格有所减少,因此跑分也差了一大截。iPhone 17e采用的是与iPhone 17标准版一样的A19系列处理器,只不过GPU核心数从5个变为了4个,因此在CPU得分上,网上也有多个iPhone 17e的成绩,其中多核分数最高大约为9200分...

iPhone 17e跑分出炉:CPU是个“硬汉”GPU却偷偷“摸鱼”

虽然大脑很聪明,但这iPhone 17e的“手脚”—也就是GPU(图形处理器),却被苹果悄悄动刀了。正牌iPhone 17用的是5核GPU,到了17e这里,直接砍掉一核,只剩4核。这一下,差距就出来了。在Metal图形测试里,大哥能考到37000分的...

德明利申请GPU存算系统相关专利,混合存储实现GPU存算,提效降延时升性能

专利摘要显示,本发明提供了通过混合存储实现GPU模组存算的方法和系统,GPU模组包括GPU芯片,GPU芯片内设置有DDR控制器、PCM控制器和SRAM,GPU芯片前端设置有CXL控制器,GPU芯片内部的数据总线分别连通CXL控制器、DDR控制器、...

苹果又搞了一个创新:CPU、GPU分开设计,再封装在一起

说起现在的ARM芯片,不管是手机Soc,还是电脑用的芯片,都是CPU、GPU设计在一起的,然后集成在一颗芯片了。而手机Soc里面则集成更多的东西,有CPU、GPU、DSP、ISP、NPU,基带芯片等等。这样的好处是高度集成化,提高芯片之间的...

大模型训练的硬件基础:GPU内存层级、分块与并行策略

Llama 3 最大的模型超过 4000 亿参数在 16000 块 GPU 上训练了数周乃至数月,优化计算意味着在更低的成本下训练更大的模型。本文将介绍 GPU 的核心特性,并据此讨论如何设计更快的算法。GPU 与 CPU 的区别 CPU 的优化目标是单...

并行科技拟 8066 万元采购 GPU 服务器及存储设备,3 月 20 日前交付服务器

3月5日,并行科技(920493)发布公告称,公司拟合计投入不超过8066万元采购GPU算力服务器及存储设备,以扩充自有算力资源池,满足AI及多行业持续增长的算力需求。根据公告,此次采购分为两部分:一是向浙江天极集成电路技术...