【DeepSeek发布多模态论文又连夜删除!开始在视觉模型上发力 性能持平或超越GPT、Claude、Gemini最新版本】DeepSeek终于能“看见”了。前两天,DeepSeek偷偷开启了多模态能力的灰度测试,部分用户打开DeepSeek首页会发现,界面多了一个“识图模式”的入口。上传图片后,DeepSeek能像人一样理解画面了。DeepSeek多模态团队负责人陈小康在4月29日发文称,“现在,我们能看见你了。”这是DeepSeek的聊天产品第一次接入多模态。就在4月30日,DeepSeek又发布了一篇关于多模态技术报告,阐释了这次上新的多模态技术背后的细节。

但很快大家发现,官方连夜删除了多模态仓库和论文原文,5月1日打开Github界面已经是“404”状态。关于删除原因官方并没有特别说明,不过有猜测不是内容问题,而是信息透露太多。这次的论文说了些啥?从行业反馈来看,论文符合DeepSeek扎实且务实的风格,同样在通过工程能力降低成本,采用了新的范式,也意味着,DeepSeek开始在视觉模型上发力了。

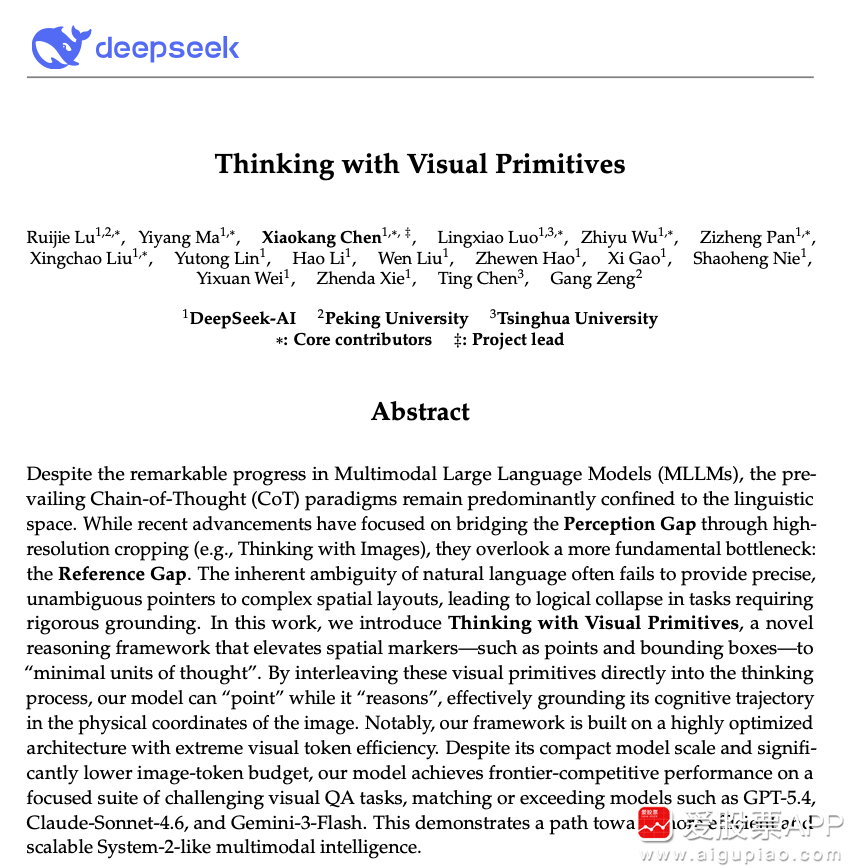

DeepSeek给模型配上一只“手指”。通过引入“视觉原语”框架,模型将点、边界框等空间标记提升为最小思维单元。这一模型基于DeepSeek-V4-Flash(总参数2840亿)构建。DeepSeek的大量实验表明,该方法在推理精度上实现显著突破,在空间推理、视觉问答等挑战性任务上,性能持平或超越GPT、Claude、Gemini最新版本。多模态已经成为当前大模型更新的一个重要方向,有传言称,DeepSeek暂缓多模态生成的训练策略,主要源于算力和现金的掣肘,在融资后,或许这一方向的训练会更加顺利。(一财)