DeepSeekV4发布DeepSeekV4和GPT5.5谁更强

DeepSeek V4 发布,网上又是一波跑分对比的高潮。但比起那些枯燥的 Benchmark 榜单,我更看重这次发布会传达出的产业信号。

这次 V4 最大的杀招,是直接把 100 万(1M)超长上下文做成了全系标配。

以前的大模型,一百万上下文是个极其昂贵的旗舰功能,你往里扔一堆文档,看着模型反应半天,后台烧掉的都是真金白银。现在 DeepSeek 直接把它变成了默认配置,等于是把长文本处理的门槛彻底踩平了。

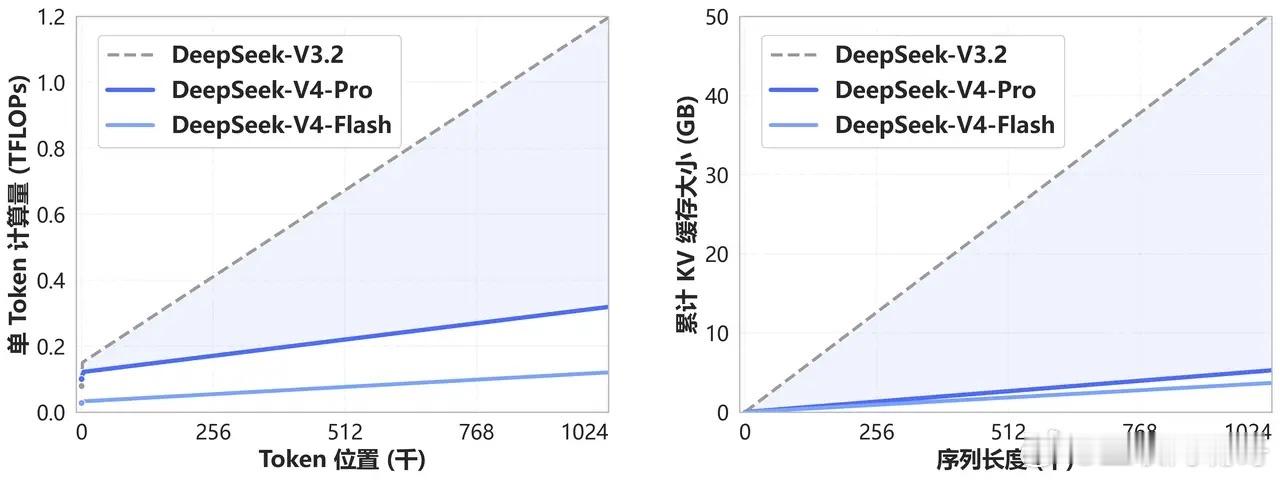

这背后是那个全新的“DSA稀疏注意力”机制。简单点说,以前模型读一百万字是逐字死磕,计算量呈平方级爆炸;现在是用稀疏注意力去抓取关键关联,跳过大量废话,极大地节省了显存和算力。把技术上的算力红利,直接转化为了产品端的标配功能。

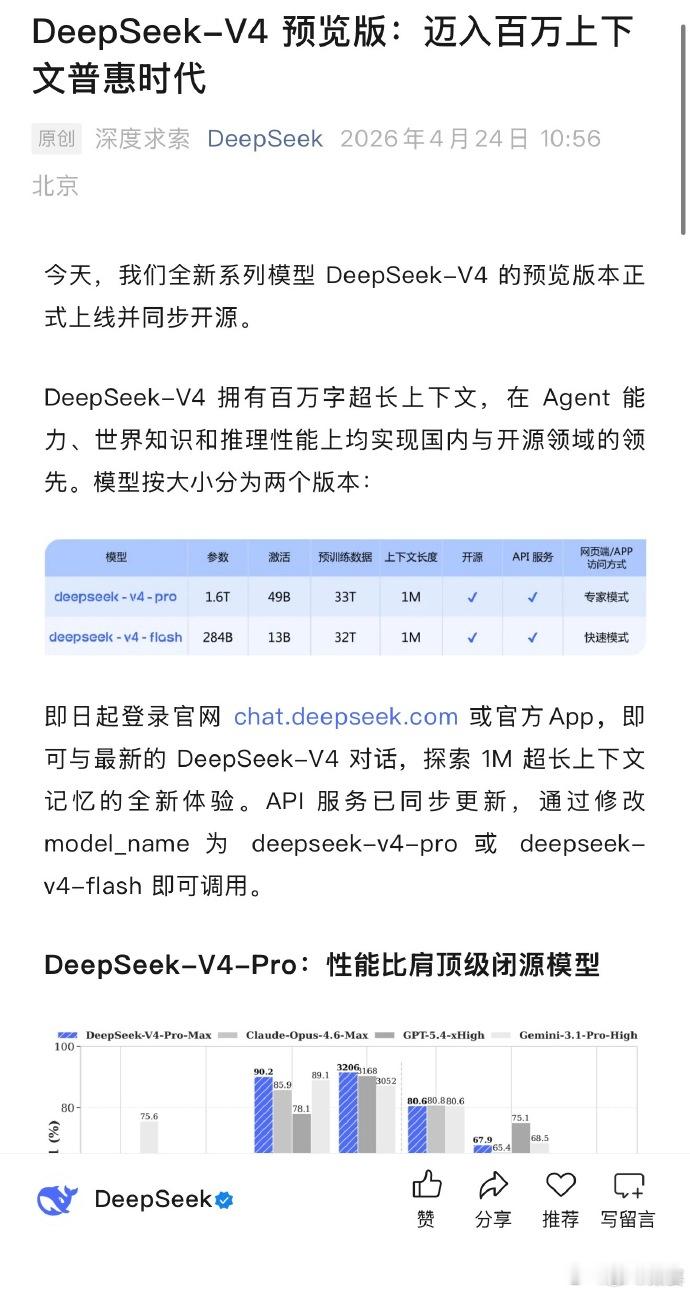

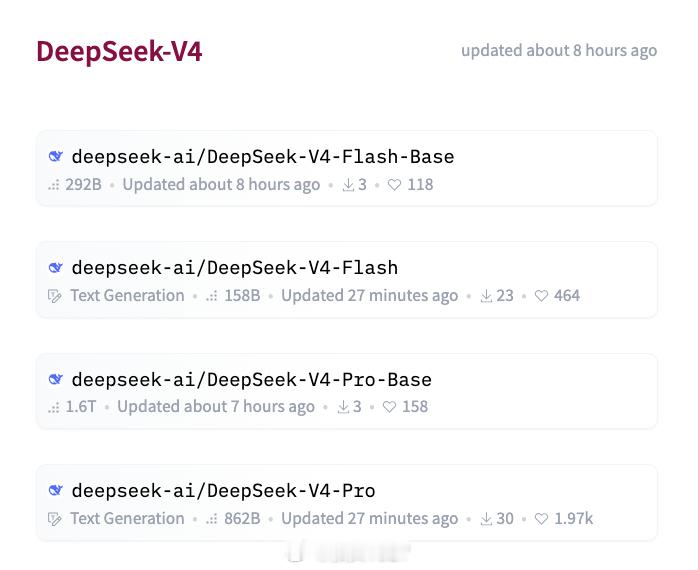

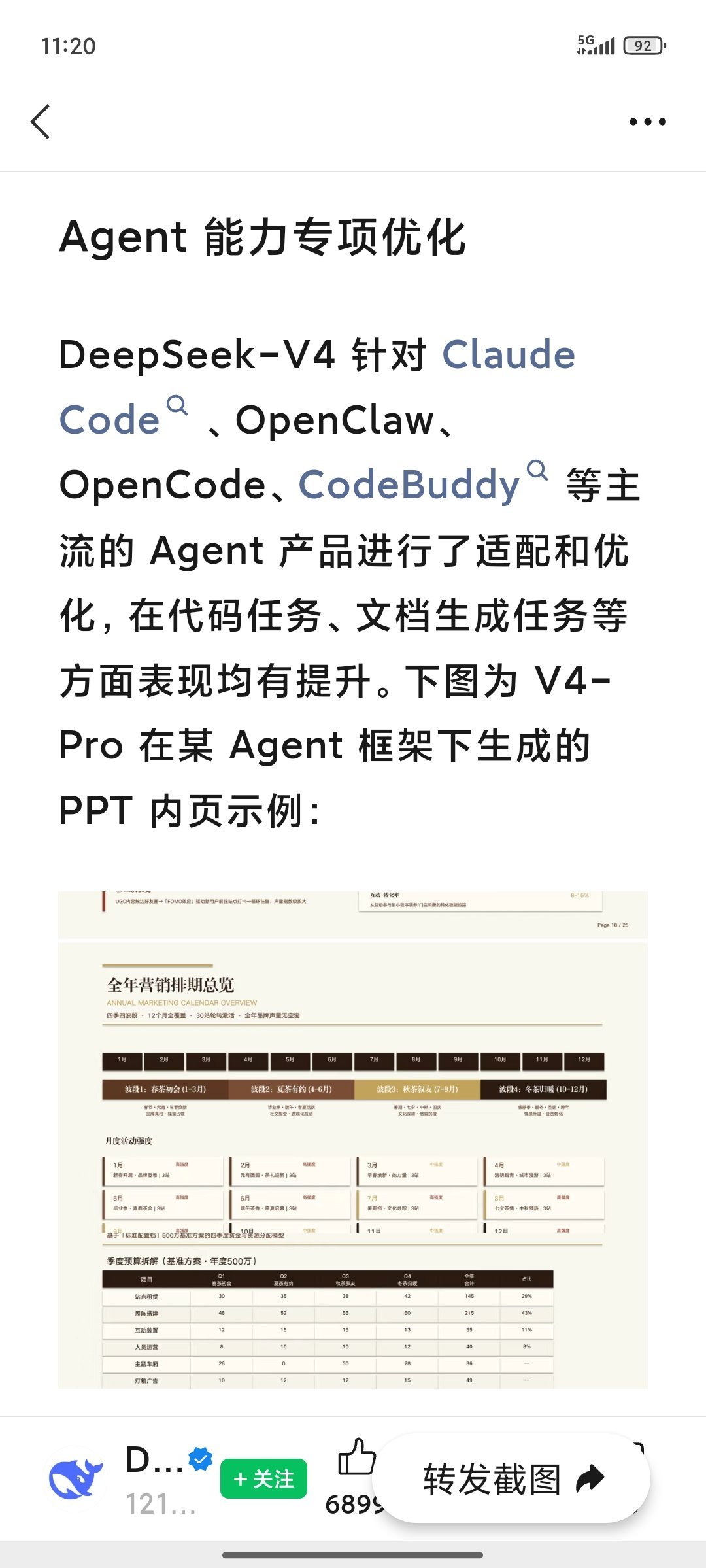

顺着这个逻辑看它的 Pro 和 Flash 双版本矩阵,打法就非常清晰了。Pro 版本负责在高强度逻辑推理、复杂 Agent 协调上去硬刚那些顶尖闭源大厂;而 Flash 版本就干一件事:用极其恐怖的性价比和速度,去抢占海量的轻量级应用端。

官方甚至直接下了通牒,今年 7 月 24 号强停旧版 API。这是一种极度自信的生态洗牌。

很多吃瓜群众还在执着于 DeepSeek V4 和 GPT-5.5 到底谁的智商高几分。但在真实的开发者眼里,当一个极其接近 GPT-5.5 智商的模型,带着免费的百万上下文和白菜价的 API 砸向市场时,胜负的天平其实已经倾斜了。开源与闭源的战争,正式进入了拼极限工程成本的深水区。