【DeepSeek V4今天开源了100万上下文】

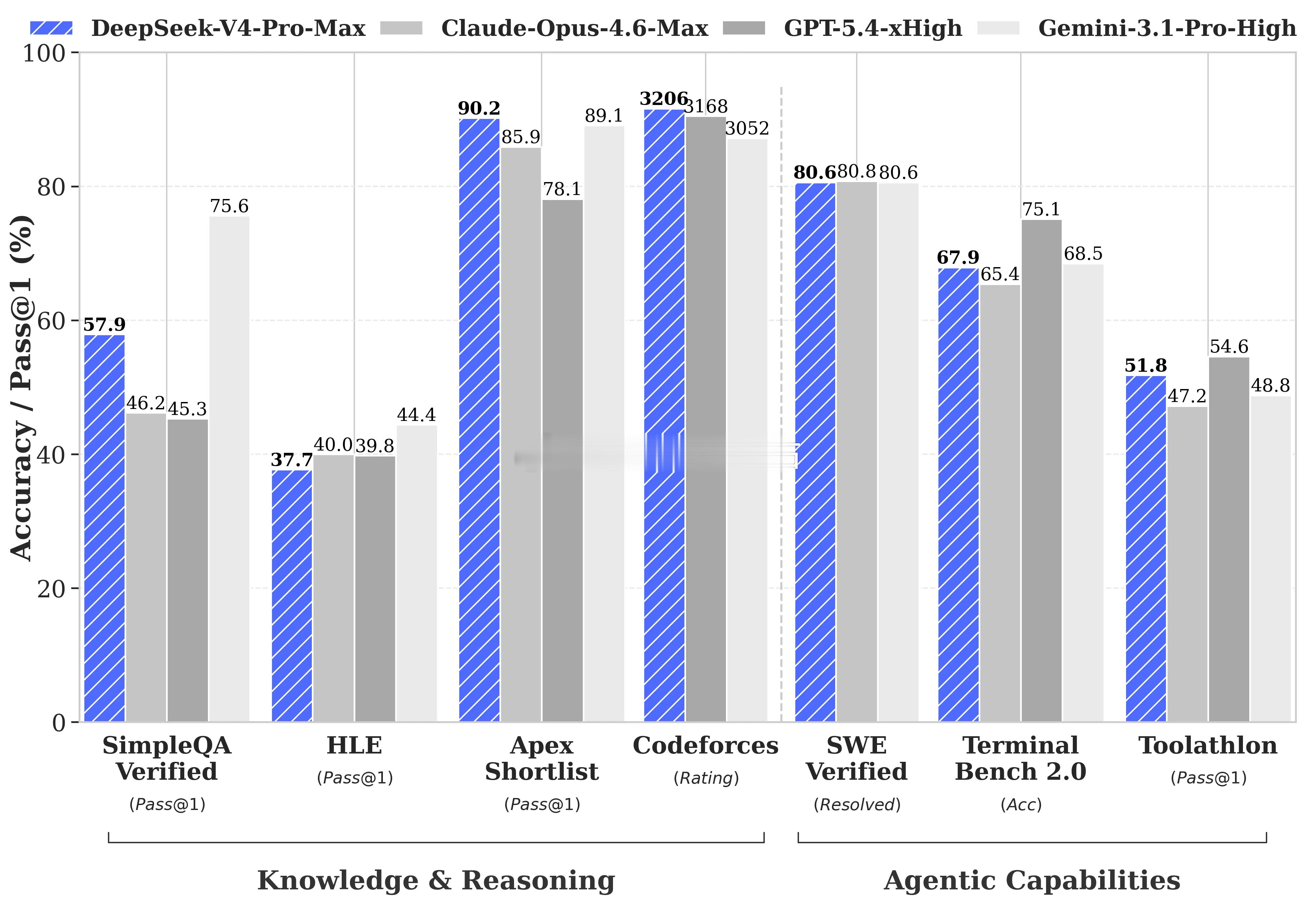

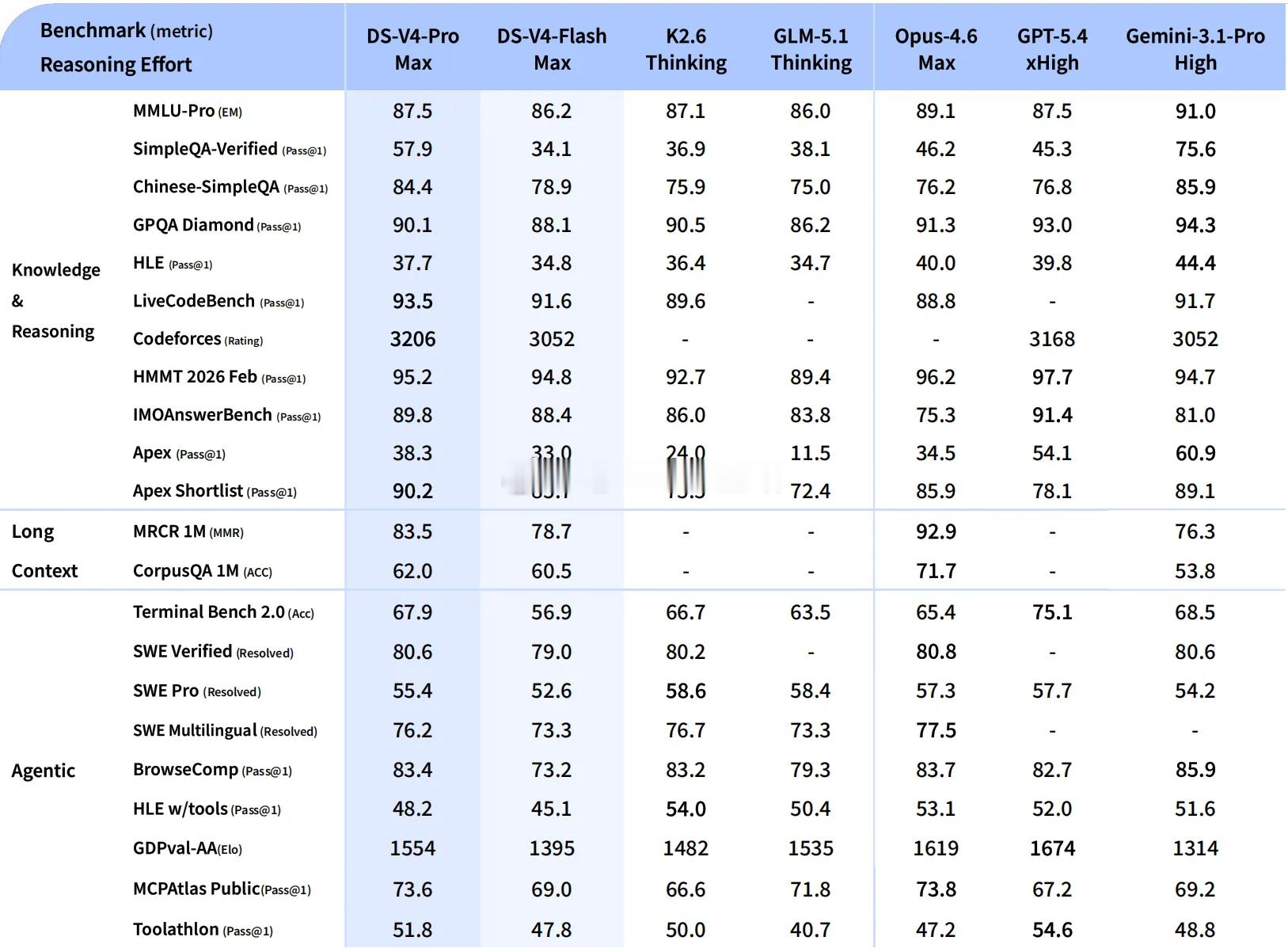

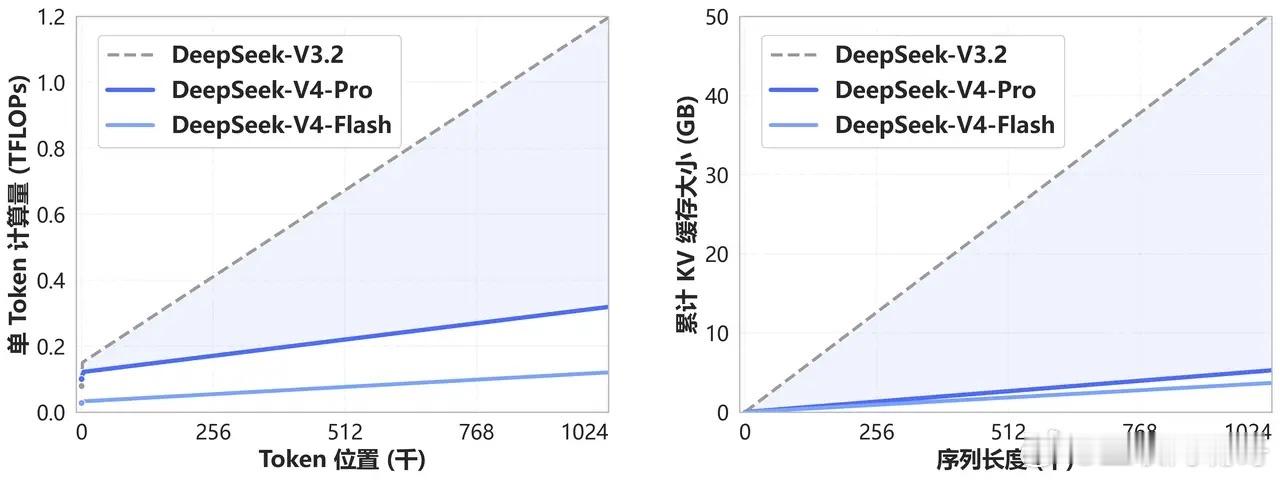

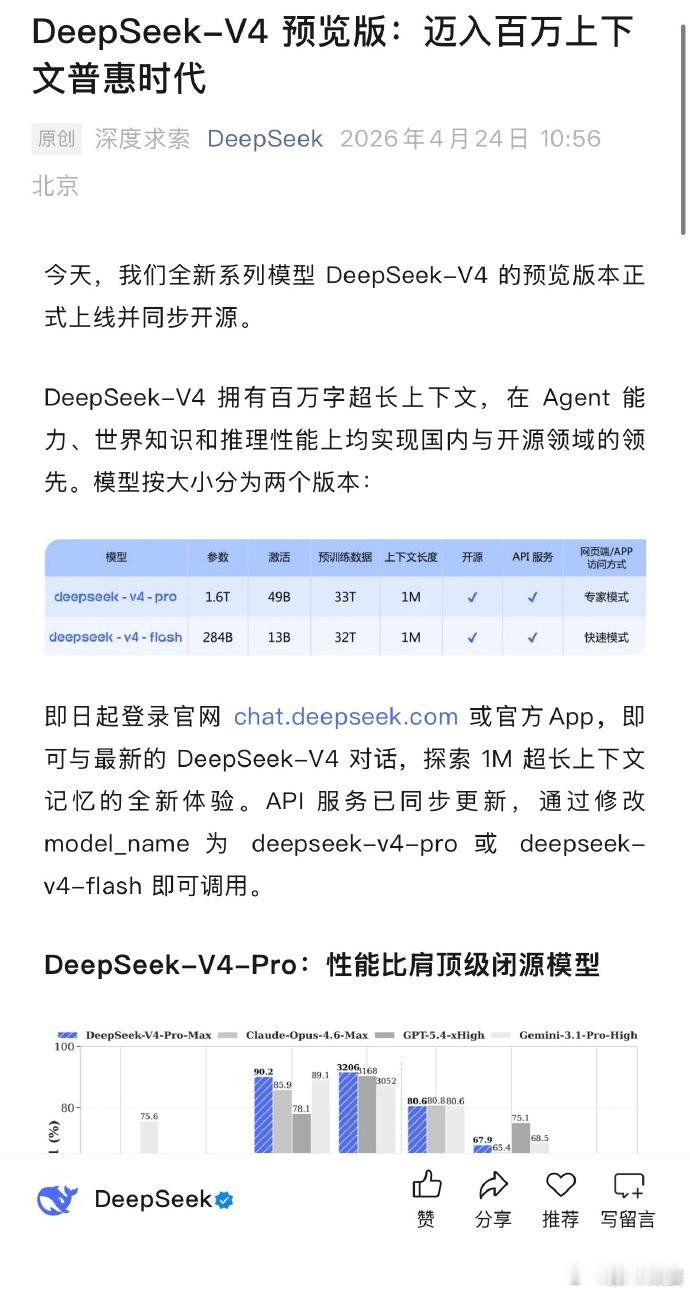

我身边做AI的朋友,今天都在刷同一个页面。DeepSeek V4正式发布,而且同步开源。两个版本:V4-Pro和V4-Flash。最炸的参数是上下文长度100万token。

先讲一个具体场景。

如果你在做金融分析,一份上市公司年报大概5-10万字。

要对比20家公司的年报,以前的大模型根本塞不进去,你得拆成好几段,让模型分批阅读,然后它经常读到后面忘了前面。

100万上下文意味着你可以直接把20份年报、加上行业研报、加上历史股价数据,一次性扔进去。模型能看到全貌,而不是管中窥豹。

DeepSeek这次的双版本设计也挺有意思。

V4-Pro是性能版,V4-Flash是轻量版。坦白讲,这和腾讯混元Hy3的快慢思考融合思路有点像,简单问题用Flash快速响应,复杂分析用Pro深度拆解。

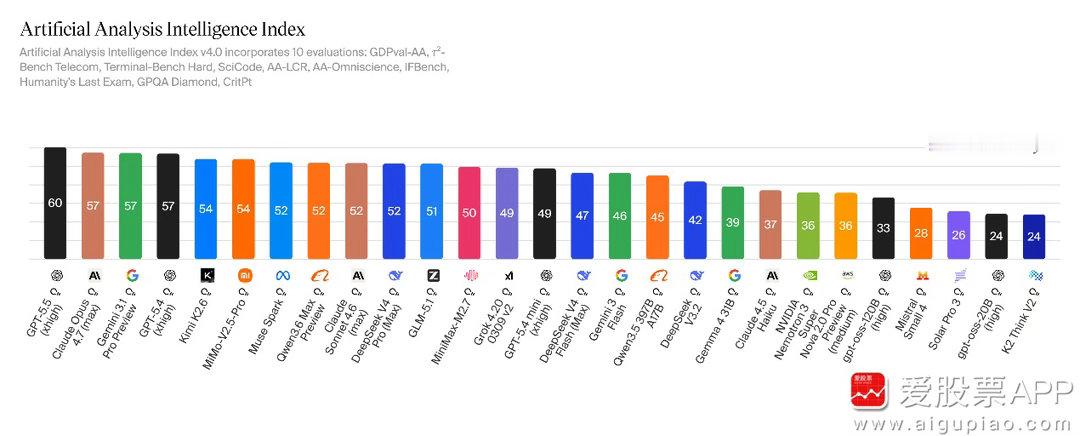

我觉得DeepSeek最大的差异化,从来不是参数有多大,而是开源。

GPT-5.5再强,你在国内调用API有各种限制。Claude再聪明,嗷嗷封号,一般人用不上。

但DeepSeek开源了,你可以自己部署,可以用在自己的产品里,可以二次开发。

100万上下文+开源,这对中国开发者来说,是真正能用起来的方案。

还有一个细节,V4上线当天,官网、App、API全部同步更新。这种落地速度,在国产大模型里其实不多见。

我觉得DeepSeek V4的真正意义,不在于它是不是最强模型,而是当OpenAI把价格翻倍、把迭代速度拉到6周一次的时候,中国企业有没有另一条路?

答案是有的。开源+超长上下文+双版本,就是另一条路。

DeepSeekV4发布how i aideepseek