朋友今天发我一条消息,说美团这次发布的模型好像很猛,处理量级等同于新发布的GPT-5.5。

美团这次发布的 LongCat-2.0-Preview,我搜了一下,参数规模直接上了万亿级。而且,全程靠国产算力训练,上下文窗口支持1M。

万亿参数意味着什么?

你可以把参数理解成模型的记忆容量和推理能力的总和,参数越多,模型能记住的东西越多,能处理的任务越复杂。而参数量,直接决定了模型的知识容量上限。

以前国内大多数模型停留在几百亿参数的量级,而 LongCat-2.0-Preview 直接把这个数字推到了万亿。

目前全球能站上万亿参数这个门槛的模型,屈指可数。

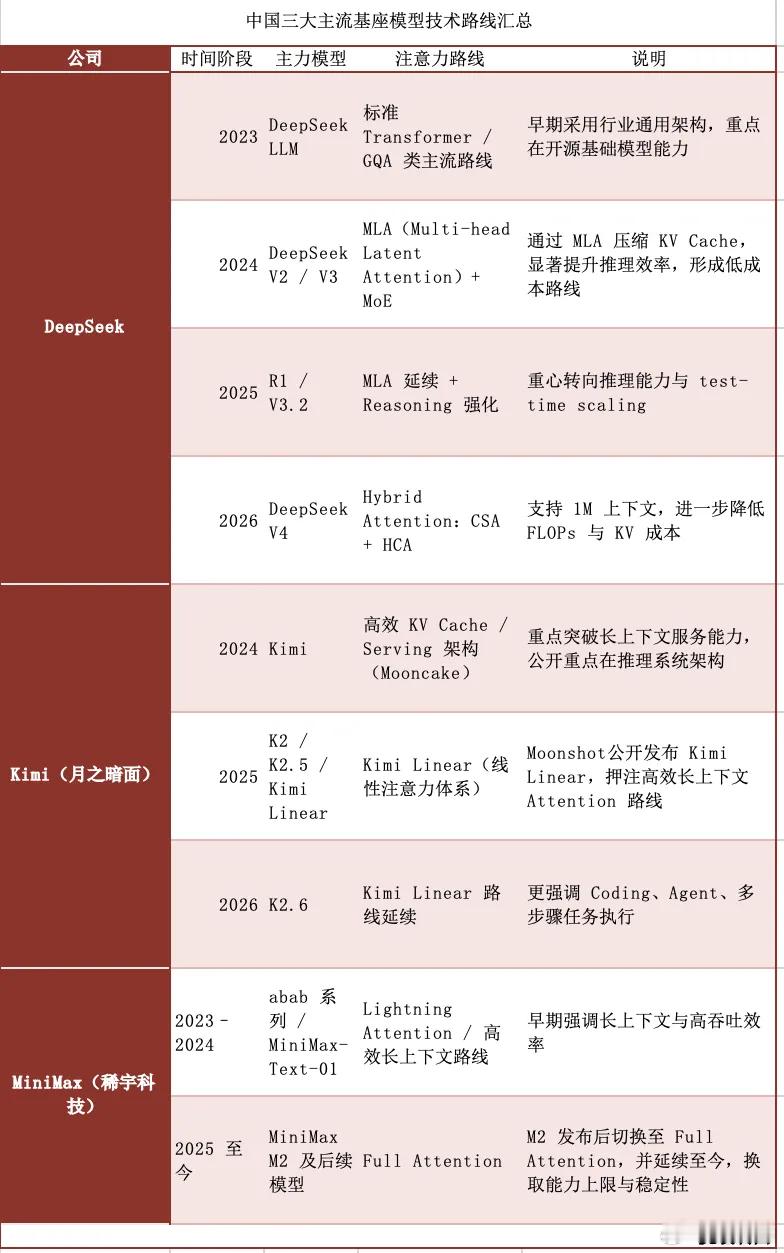

GPT-5.5 是其中之一,同期发布的 DeepSeek V4 也在这个量级。美团这次的量级,也是正式跻身全球顶尖大模型“俱乐部”

当然,我估计很多人的第一反应还是:美团做大模型,为什么?

美团的核心业务是本地生活,即时配送,餐饮SaaS,属于高频低毛利的撮合生意。这些业务的共同点是:对AI的需求极其真实,而且极其高频。

调度算法、需求预测、商家运营、用户推荐……每一个环节,都有海量的非结构化信息需要处理。

这么来看,美团做大模型,算是是国内少数真正把大模型用进自己核心业务的硬需求的公司。

自研,本质上是一种降本增效的手段。但规模到了万亿参数,我理解这件事就不是降本,而是在布局物理AI底座。

而且,美团选择在 DeepSeek V4 同期发布,并在参数规模上相当,不是巧合,而是国内大模型市场正在经历这样一个阶段,头部玩家开始从各自为战,走向直接正面竞争。

当两个万亿级模型同时出现,用户就有了比较的基础,市场格局就会加速分化。

对美团而言,这次发布也是一次身份的重新定义。美团做了多年的配送调度优化,本质上是在用算法处理海量实时数据。这种技术积累,和大模型的需求有不少重叠。

还有一个细节不得不提:LongCat-2.0-Preview,是目前公开已知的、首个完全依托国产算力集群完成训练和推理的万亿级大模型,动用了5万到6万张算力卡。

这在当下的地缘背景里,其实是一句非常重的话。

高端GPU禁售已经不是新闻,但用国产算力能不能训出万亿级模型,一直是个没有被正面验证的问题。

美团的这次发布,算是给出了一个有说服力的回答,不依赖英伟达,同样可以在顶尖量级上做事。这背后,是相当复杂的分布式训练工程能力。

而且,这个模型目前提供每天1000万Token的免费额度,申请流程也不复杂,官网填表就能申请测试资格。毕竟GPT-5.5 的 API 调用成本不低,作为开发者或者想体验长上下文能力的用户,现在就有一个零成本的选项可以去试。

国产大模型内卷,有人觉得是坏事,觉得大家都在烧钱比参数,没有意义。但我觉得这件事更接近一个正常市场应有的状态,竞争加速了技术迭代,也迫使各家把成本压低,把门槛降低。

DeepSeek 把开源和低价这张牌打出去,逼着其他人在性价比上重新定价。美团把万亿参数和国产算力这张牌打出去,证明了一条新的技术路径可行。

这些牌互相叠加,把整个行业的基准线往上抬。用户在这个过程里,也得到了更强的模型,更低的价格,更多的选择。

美团这次,又给这个市场加了一点重量。